압축 가능한 동역학을 활용한 과잉파라미터화 딥 저랭크 학습

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

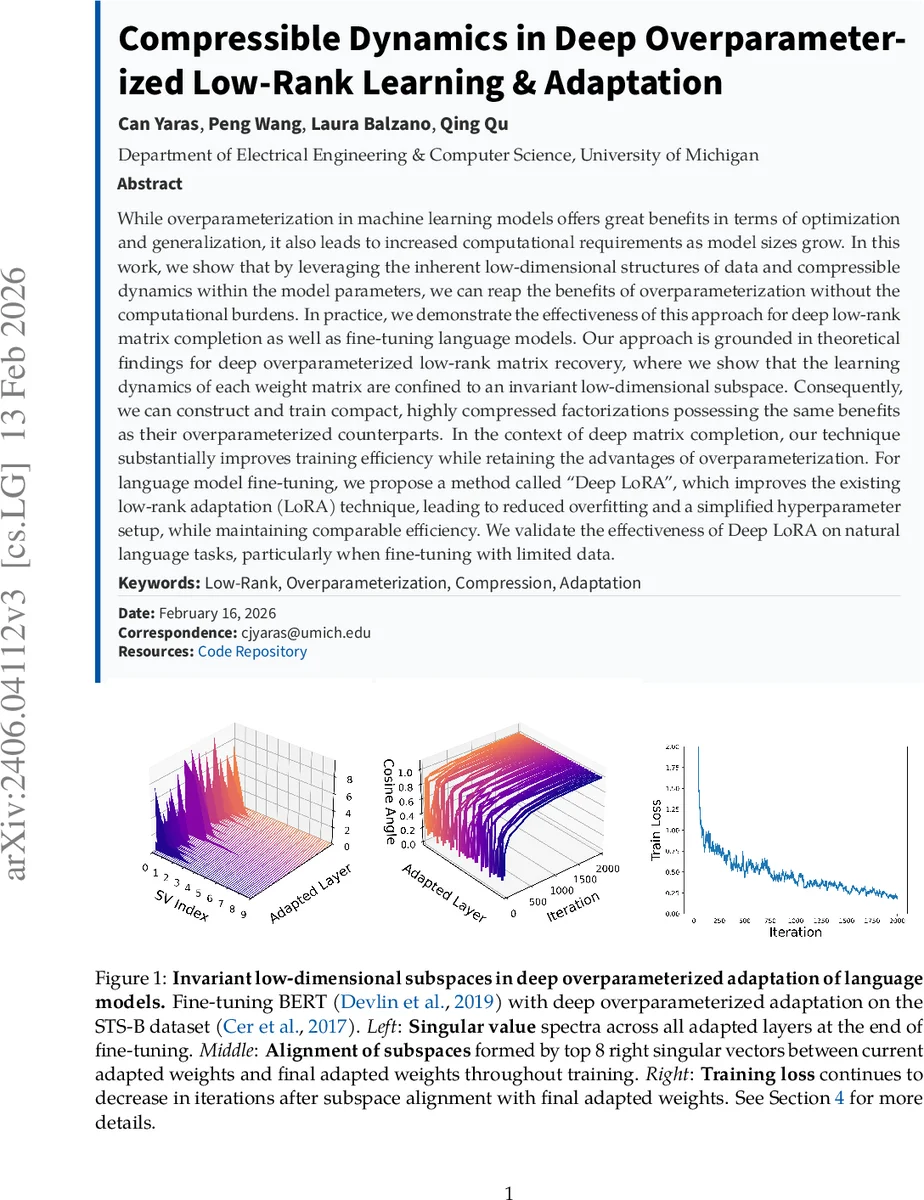

본 논문은 과잉파라미터화된 딥 모델에서 학습이 저차원 불변 서브스페이스 안에서 진행된다는 이론적 사실을 이용해, 동일한 일반화 성능을 유지하면서 파라미터 수와 연산량을 크게 줄이는 압축 기법을 제안한다. 이를 딥 매트릭스 완성과 대규모 언어 모델 파인튜닝(Deep LoRA) 두 분야에 적용해 효율성을 입증한다.

상세 분석

논문은 먼저 저차원 구조를 가진 데이터(예: 저랭크 행렬)와 과잉파라미터화된 딥 팩터화 모델을 가정한다. 핵심 이론은 Theorem 2.1으로, 각 층의 가중치 행렬 Wₗ(t) 가 초기화 시점에 존재하는 직교 행렬 Uₗ, Vₗ 에 의해

Wₗ(t)=Uₗ

댓글 및 학술 토론

Loading comments...

의견 남기기