SAM3 경량 텍스트 인코더, 효율적인 비전‑언어 분할을 위한 해부학적 분석

초록

**

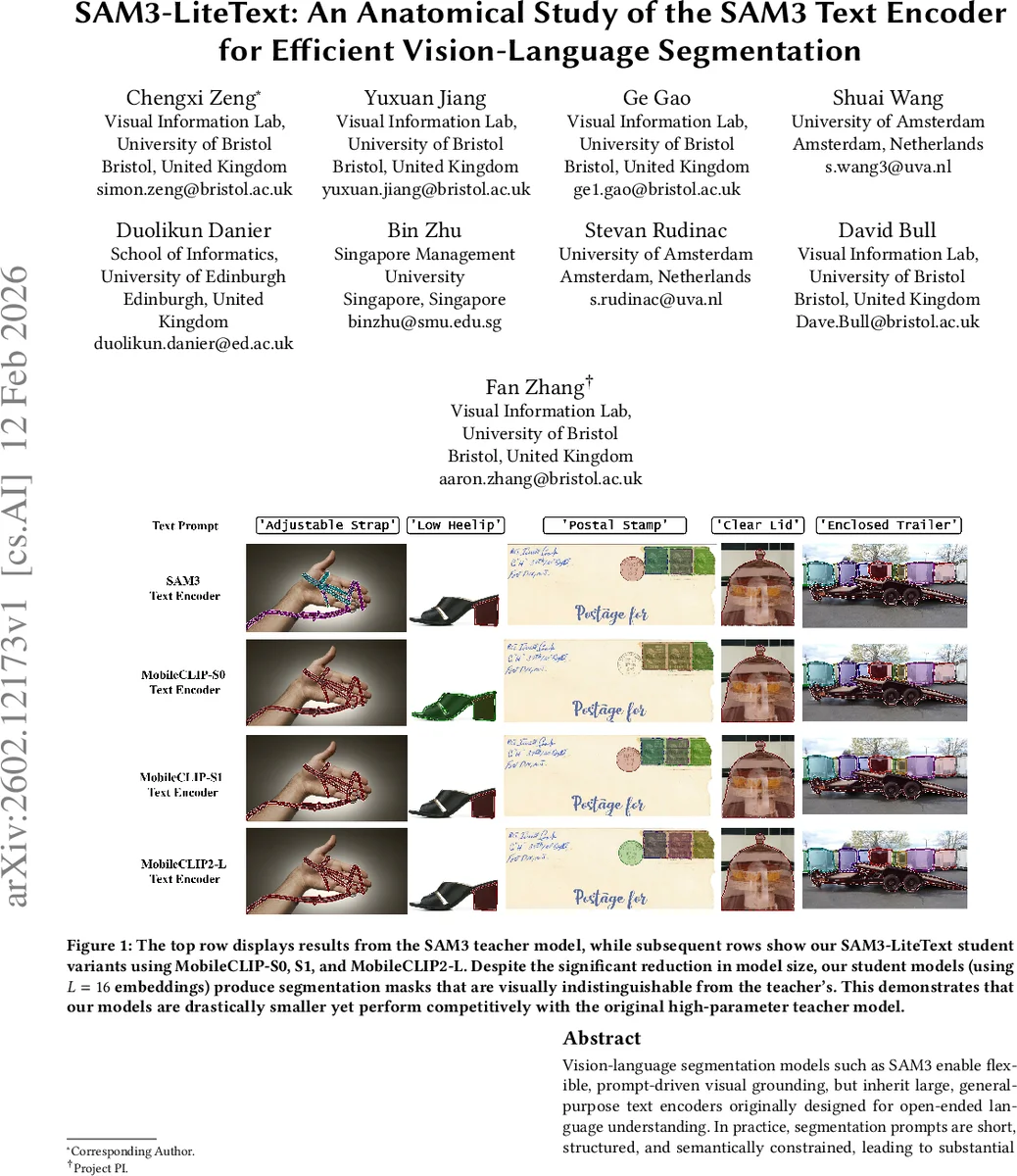

본 논문은 40만 개 이상의 실제 프롬프트를 분석해 SAM3 텍스트 인코더가 과도한 용량을 가지고 있음을 밝혀낸다. 컨텍스트 길이·어휘·임베딩 차원 모두에서 75 % 이상의 낭비가 존재함을 확인하고, 이를 기반으로 MobileCLIP 기반 경량 학생 모델(SAM3‑LiteText)을 설계·지식 증류한다. 실험 결과, 파라미터 88 % 감소, 메모리 350 MB 이상 절감하면서도 원본 성능의 98.1 % 수준을 유지한다.

**

상세 분석

**

논문은 먼저 SAM3가 사용하고 있는 CLIP‑style 텍스트 인코더가 일반적인 자연어 처리용 대형 트랜스포머 구조임을 지적한다. 그러나 비전‑언어 분할에서 요구되는 프롬프트는 대부분 짧은 명사구(평균 7.9 토큰)이며, 49 408개의 BPE 어휘 중 35 %만 실제로 사용된다. 토큰 길이 분포를 6개 데이터셋에 걸쳐 분석한 결과, L=32 컨텍스트 윈도우에서는 75.5 %가 패딩으로 채워져 연산·메모리 낭비가 심각함을 확인했다. L=16으로 축소하면 정보 밀도가 0.48로 상승하고, 대부분의 데이터셋에서 트렁케이션이 0.1 % 이하로 최소화된다.

어휘 커버리지는 상위 100개 토큰이 전체 등장 횟수의 58.5 %를 차지하는 극단적인 롱테일 형태이며, 토큰 임베딩 자체는 고차원(1024)에서 90 % 분산을 설명하기 위해 834 차원이 필요할 정도로 고랭크를 유지한다. 따라서 토큰 임베딩을 저랭크 압축하기보다는 사용되지 않는 어휘를 제거하거나 경량화된 임베딩 구조를 설계하는 것이 효율적이다.

반면 위치 임베딩은 32 위치 중 831번째가 거의 학습되지 않아 서로 높은 코사인 유사도를 보이며, 실제 프롬프트가 07 위치에 집중한다는 점을 이용해 위치 임베딩 차원을 축소하거나 공유할 수 있다. 이러한 해부학적 발견을 바탕으로 저자들은 두 가지 핵심 설계 원칙을 제시한다. 첫째, 컨텍스트 길이를 16으로 고정하고, 프롬프트를 “개념의 bag”으로 취급해 순서에 강인한 일관성 손실(permutation‑invariant consistency loss)을 도입한다. 둘째, MobileCLIP‑S0/S1 및 MobileCLIP2‑L 같은 경량 학생 모델을 사용해 지식 증류를 수행한다. 증류 과정에서는 텍스트 임베딩의 L2 거리와 시멘틱 일관성을 동시에 최적화함으로써, 원본 SAM3와 거의 동일한 시멘틱 표현을 유지한다.

실험에서는 COCO‑Ref, LVIS, RF100‑VL 등 이미지와 YouTube‑VOS, DAVIS 등 비디오 분할 벤치마크에서 평가하였다. 파라미터 42 M(원본 350 M 대비 88 % 감소)와 메모리 사용량 45 MB(원본 대비 87 % 절감)에도 불구하고, 평균 IoU는 0.981 수준으로 원본과 거의 차이가 없었다. 특히 복잡한 참조 표현이 포함된 Ref‑COCO에서는 L=16 truncation이 8 %에 불과했음에도 성능 저하가 거의 없었으며, 이는 모델이 짧은 컨텍스트에서도 충분히 강건함을 증명한다.

결과적으로, 본 연구는 비전‑언어 분할에서 텍스트 인코더가 과도하게 설계된 사례를 최초로 정량화하고, 도메인‑특화 압축 전략을 통해 실시간·엣지 환경에서도 고성능을 유지할 수 있음을 보여준다. 향후 연구는 더 작은 어휘 집합 기반의 토큰화, 동적 컨텍스트 길이 조절, 그리고 멀티‑모달 증류를 결합해 더욱 경량화된 통합 모델을 탐색할 여지를 남긴다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기