과학적 추론 LLM을 위한 공동 진화 프레임워크 SciCoE

초록

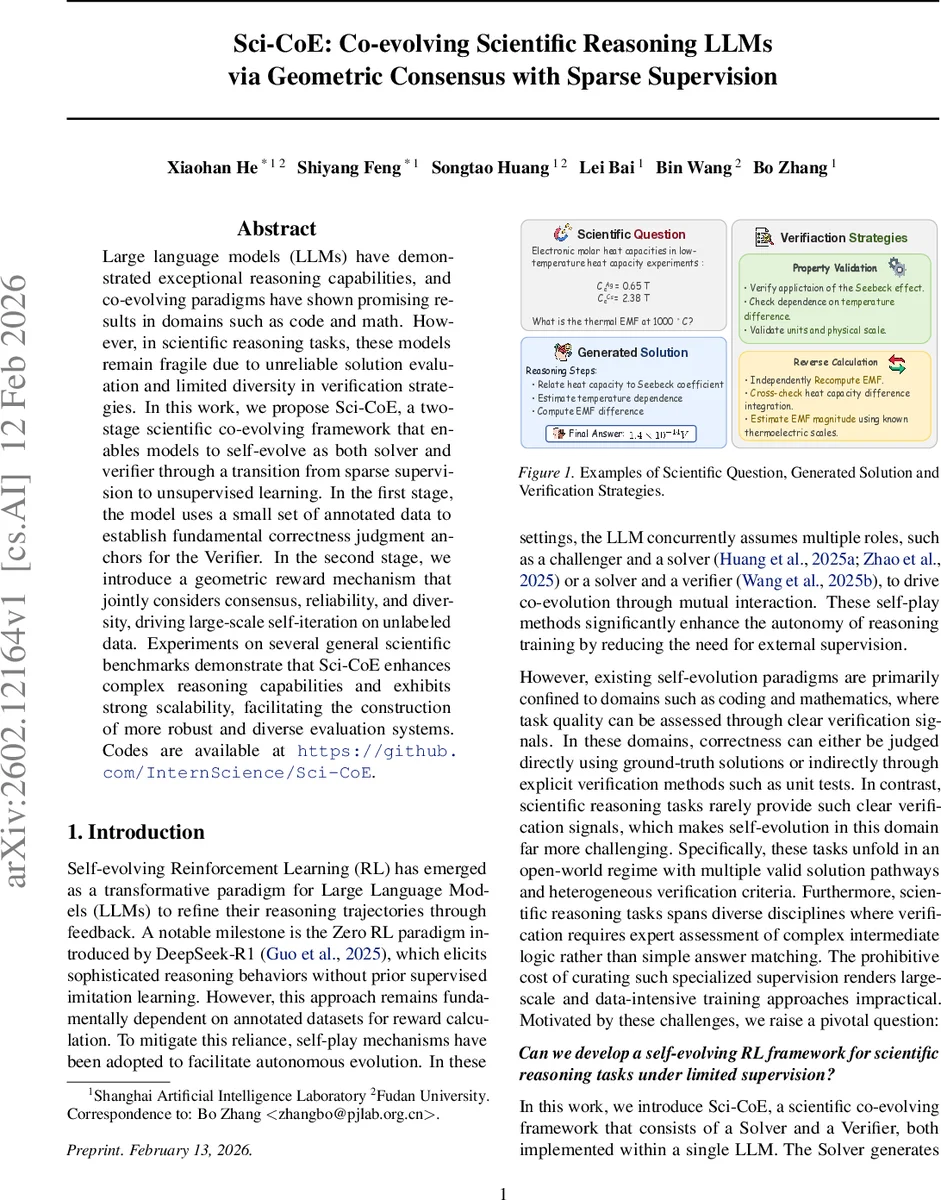

SciCoE는 제한된 라벨 데이터만으로 과학적 질문에 대한 해결책과 검증 전략을 동시에 학습하는 두 단계 공동 진화 시스템이다. 첫 단계에서는 소량의 정답을 이용해 솔버와 베리파이어의 기본 판단 기준을 잡아두고, 두 번째 단계에서는 라벨이 없는 대규모 데이터에서 솔루션‑검증 일치도와 전략의 신뢰·다양성을 고려한 기하학적 보상으로 자체적으로 성능을 향상시킨다. 실험 결과, 기존 모델 대비 복합 과학 추론 정확도가 크게 상승하고 검증 전략의 다양성도 확보되었다.

상세 분석

SciCoE는 과학적 추론이라는 특수한 도메인에서 LLM이 직면하는 “정답 신호의 부재”와 “검증 기준의 다중성” 문제를 해결하기 위해 설계된 프레임워크이다. 핵심 아이디어는 하나의 LLM이 Solver와 Verifier 두 역할을 동시에 수행하도록 하여, 두 역할이 서로의 출력을 피드백으로 활용하는 폐쇄형 강화학습 루프를 만든다는 점이다.

첫 번째 단계인 Anchored Learning에서는 전체 데이터의 1~10% 정도만 라벨링된 과학 질문을 사용한다. Solver는 정답과 일치하면 1, 그렇지 않으면 0의 이진 보상을 받으며, 이는 모델이 기본적인 과학적 논리 흐름을 잡아주는 최소한의 정렬 신호 역할을 한다. Verifier는 “모든 정답 솔루션을 통과하고, 가능한 한 많은 오답을 차단”하는 전략을 학습한다. 여기서 전략의 정답 여부는 외부 Judge 모델이 전략에 따라 솔루션을 평가한 결과(Eval)로 정의되며, 전략이 올바른 경우 +1, 그렇지 않으면 -1의 부호를 부여한다. Solver와 Verifier가 동일 파라미터를 공유하기 때문에, 두 목표를 순차적으로 PPO 업데이트(솔루션 → 전략)함으로써 파라미터가 급격히 흔들리는 현상을 방지한다.

두 번째 단계인 Unsupervised Co‑evolution에서는 라벨이 전혀 없는 대규모 과학 질문 집합을 이용한다. 이때 절대적인 정답 신호가 없으므로, 솔루션 보상은 “다수의 검증 전략에 의해 얼마나 일관되게 통과되는가”로 정의한다. 구체적으로 r_sol_i = (1/M) Σ_j Eval(s_i, v_j) 로 계산하고, 통과율이 사전 정의된 임계값 τ(예: 0.8) 이상인 솔루션을 고신뢰 집합 S⁺(q) 로 선정한다.

Verifier의 보상은 세 축—일관성(consistency), 신뢰성(reliability), 다양성(diversity)—을 동시에 고려한다. 일관성은 앞서 정의한 S⁺(q)와의 매칭으로 얻으며, 신뢰성과 다양성은 전략을 고차원 의미 공간에 임베딩한 뒤 클러스터링(K‑means)하여 평가한다. 클러스터 중심에 가까운 전략은 일반적인 과학적 검증 패턴에 부합한다고 보고 높은 신뢰 보상을, 서로 다른 클러스터에 속하는 전략들 간의 거리(또는 평균 내적)를 이용해 다양성 보상을 부여한다. 이렇게 하면 Verifier가 “모든 전략을 동일하게 만들” 위험을 방지하고, 서로 보완적인 검증 관점을 유지하도록 유도한다.

전체 학습은 PPO 기반 정책 최적화로 진행되며, Solver와 Verifier가 공유 파라미터를 통해 교차 업데이트된다. 실험에서는 일반 과학 QA 벤치마크(예: PhysicsQA, ChemistryQA, BiologyQA 등)에서 기존 코딩·수학 전용 공동 진화 모델 대비 5~12%p의 정확도 향상을 기록했으며, 특히 복합 다단계 추론이 요구되는 질문에서 큰 폭의 개선을 보였다. 또한, Verifier가 생성한 검증 전략의 클러스터 분포를 분석한 결과, 단계별로 전략의 다양성이 유지되면서도 고신뢰 클러스터가 점진적으로 형성되는 것을 확인했다. 이는 SciCoE가 라벨이 부족한 과학적 환경에서도 자체적인 평가 체계를 구축하고, 지속 가능한 성능 향상을 가능하게 함을 의미한다.

댓글 및 학술 토론

Loading comments...

의견 남기기