3D 가우시안 스플래팅으로 VLM 기반 객체 탐색 혁신

초록

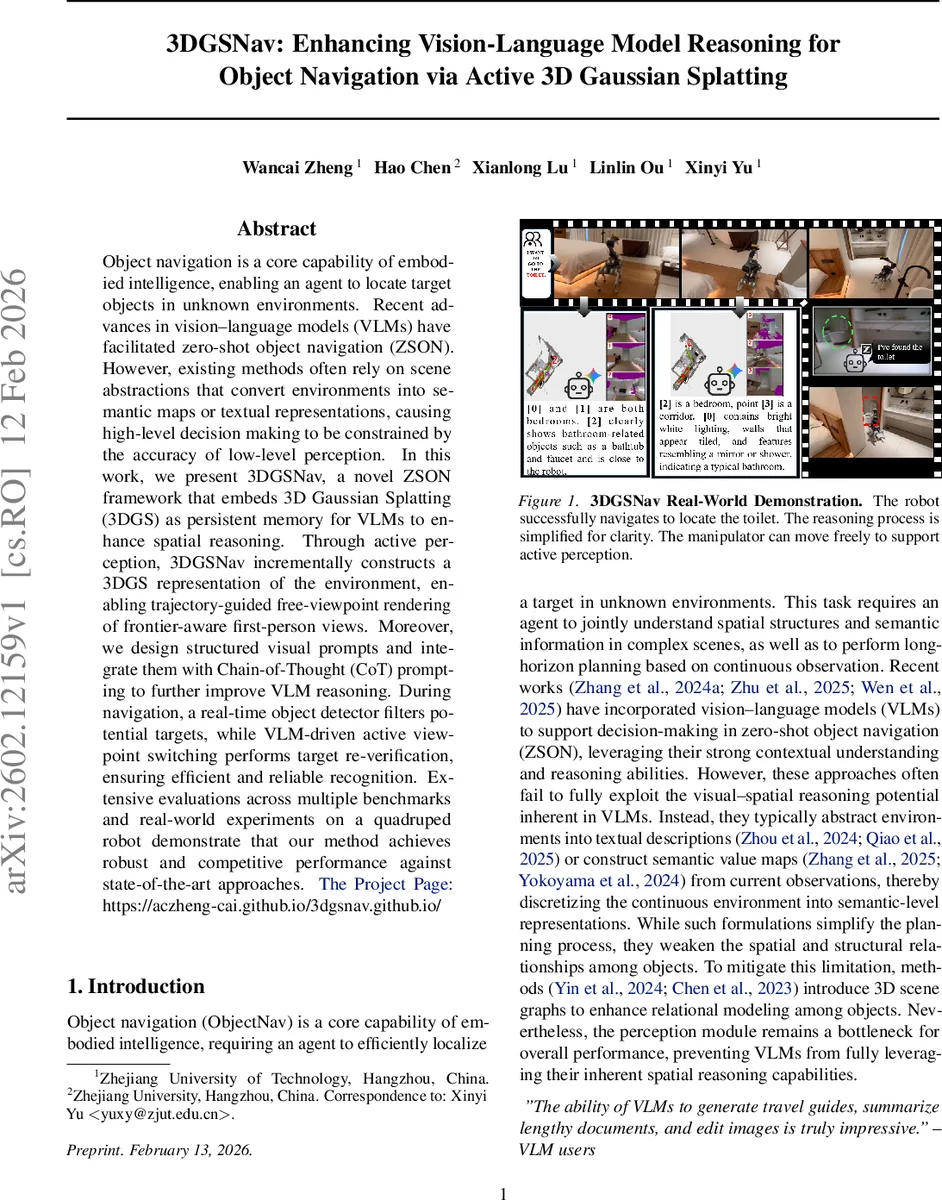

3DGSNav은 3D Gaussian Splatting을 지속적인 메모리로 활용해 비전‑언어 모델(VLM)의 공간 추론 능력을 강화한다. 활성 인식과 자유‑시점 렌더링, 구조화된 시각 프롬프트·CoT 결합을 통해 제로샷 객체 내비게이션을 효율적으로 수행한다.

상세 분석

본 논문은 기존 제로샷 객체 내비게이션(ZSON) 연구가 환경을 텍스트 혹은 의미 지도 형태로 추상화하면서 발생하는 공간 정보 손실 문제를 근본적으로 해결하고자 한다. 핵심 아이디어는 3D Gaussian Splatting(3DGS)을 ‘지속 가능한 메모리’로 도입해 연속적인 RGB‑D 관측을 고밀도 3차원 가우시안 클라우드로 축적하고, 이를 VLM이 직접 접근하도록 설계한 점이다. 3DGS는 가우시안 프리미티브(위치, 불투명도, 색상, 공분산)로 구성되며, 투영 과정에서 Jacobian을 이용해 이미지 평면으로 효율적으로 렌더링한다. 손실 함수는 색상·깊이 재구성 오류와 SSIM을 결합해 시각적 일관성을 유지한다.

활성 인식 단계에서는 현재 카메라 시점에서 불투명도 맵을 생성하고, 저불투명도 영역을 DBSCAN으로 군집화해 ‘관찰이 부족한’ 시점들을 자동으로 탐색한다. 이렇게 선정된 시점(피치·요)으로 로봇 카메라를 회전시켜 물리적 스캔 없이도 누락된 영역을 보완한다는 점이 메카니컬 회전에 비해 탐색 효율을 크게 높인다.

전방점(Frontier) 추출은 3DGS 기반 탐색 지도와 에이전트 높이 정보를 융합해 수행한다. 단순히 개별 전방점을 렌더링하는 대신, 거리 필드와 워터셰드 분할을 이용해 중복 전방점을 클러스터링하고, 각 클러스터의 중심을 대표 전방점으로 선택한다. 이는 렌더링 비용을 절감하면서도 환경 전체의 구조적 맥락을 보존한다.

전방점에 대한 자유‑시점 최적화는 두 단계로 이루어진다. 첫째, 가이드 트래젝터리를 Dijkstra 기반 비용 함수(거리·장애물 근접 패널티)로 계산해 최단 경로를 확보한다. 둘째, 초기 가상 시점을 경로 곡률·거리 가중 점수로 선정한 뒤, 불투명도 손실, 시야 손실, 코사인 유사도, 트래젝터리 정합성을 모두 포함한 복합 손실을 최소화하도록 회전·이동을 반복 최적화한다. 결과적으로 전방점이 가시화된 FPV(First‑Person View)는 관찰된 영역과 미관측 영역을 균형 있게 포함하고, VLM이 공간적 관계를 정확히 파악하도록 돕는다.

프롬프트 설계에서는 FPV와 상단‑시점(BEV) 이미지를 구조화된 시각 프롬프트로 변환하고, 온라인 주석(예: 객체 바운딩 박스, 거리 라벨)을 삽입한다. 이러한 시각 프롬프트와 체인‑오브‑생각(CoT) 텍스트 프롬프트를 결합해 VLM에게 “전방점 중 어느 위치가 목표 객체와 가장 높은 의미적·공간적 유사성을 갖는가”를 단계별로 사고하도록 유도한다.

실행 단계에서는 경량 실시간 객체 탐지기가 잠재 목표를 필터링하고, 탐지 불확실도가 높을 경우 VLM이 활성 시점 전환을 명령해 추가 관찰을 확보한다. 이렇게 얻은 재검증된 시점은 3DGS 메모리에 다시 투영돼 탐색 지도에 반영된다. 전체 파이프라인은 GPU 기반 3DGS 렌더링과 대형 VLM(예: GPT‑4V) 추론을 실시간에 가깝게 수행하도록 설계돼, 실제 사족보행 로봇 실험에서도 안정적인 동작을 입증한다.

본 연구는 (1) 3DGS를 지속 메모리로 활용해 연속적인 공간 정보를 보존, (2) 활성 인식·전방점 클러스터링·다중 제약 최적화를 통해 효율적인 시점 선택, (3) 구조화된 시각·텍스트 프롬프트와 CoT 결합으로 VLM의 공간 추론을 극대화한다는 세 가지 핵심 기여를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기