오서브: 공간·시간 이질성을 활용한 대규모 언어 모델 서빙 최적화

초록

오서브는 LLM 서빙 시 발생하는 공간적(연산·메모리 요구 차이)·시간적(워크로드 변동) 이질성을 고려해, 이질적인 모델 복제와 동적 스케줄링을 결합한 시스템이다. 두 단계 흐름망 기반 최적화와 예측 기반 모델 전환 기법으로 기존 vLLM·Llumnix·Dynamo 대비 평균 1.5배, 최고 2배의 처리량 향상과 P99 지연 감소를 달성한다.

상세 분석

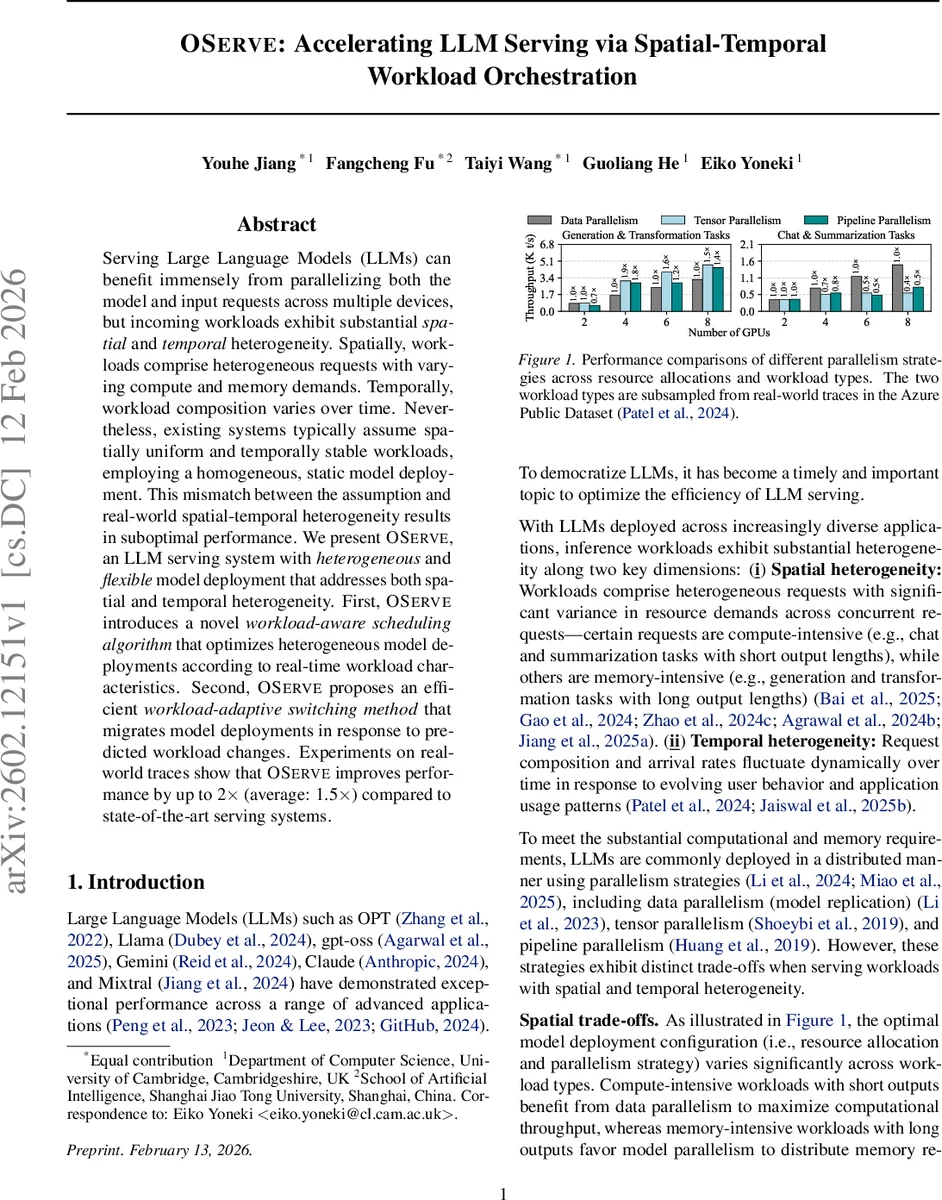

오서브는 LLM 서빙 환경에서 “공간적 이질성”과 “시간적 이질성”이라는 두 축의 변동성을 동시에 해결하려는 최초의 시도라 할 수 있다. 공간적 이질성은 요청마다 연산량과 메모리 요구가 크게 달라지는 점을 의미한다. 예컨대, 짧은 출력 길이의 채팅·요약 작업은 GPU 연산 집약도가 높고, 긴 출력 길이의 코드·텍스트 변환 작업은 메모리 대역폭을 많이 소모한다. 기존 서빙 시스템은 모든 복제에 동일한 병렬화 전략(주로 데이터 병렬)과 동일한 GPU 할당을 적용해 이러한 차이를 무시한다. 결과적으로 일부 복제는 과부하, 일부 복제는 자원 미활용이라는 비효율이 발생한다.

시간적 이질성은 워크로드 구성이 시간에 따라 급격히 변한다는 점이다. 업무 시간대에는 짧은 출력 요청이 폭주하고, 야간에는 긴 출력 요청이 비중을 차지한다는 실측 데이터(Azure Public Dataset)를 기반으로 한다. 정적인 배치 전략은 이러한 변동을 반영하지 못해 전반적인 처리량과 지연에 악영향을 미친다.

오서브는 이를 해결하기 위해 두 단계의 흐름망 기반 최적화를 제안한다. 하위 단계에서는 주어진 모델 배치(복제 수, 텐서·파이프라인 병렬화 조합)마다 각 복제‑워크로드 쌍의 최대 처리량을 사전 프로파일링하고, 이를 기반으로 흐름망을 구성한다. 소스→워크로드 노드→중간 노드→복제 입력→복제 출력→싱크의 네트워크에서 최대 흐름(max‑flow) 알고리즘을 적용해 워크로드 할당을 최적화한다. 여기서 각 복제의 용량을 LCM(최소공배수) 방식으로 정규화해 서로 다른 워크로드가 동일 복제에 동시에 할당될 때도 자원 충돌을 방지한다.

상위 단계는 흐름망 결과를 피드백으로 활용해 모델 배치를 탐색한다. 초기에는 균등 GPU 할당과 순수 텐서 병렬화를 적용하고, 흐름망에서 포화된(병목) 복제와 저활용 복제를 식별한다. 이후 저활용 복제에서 GPU를 회수해 병목 복제에 재할당하고, 가능한 텐서·파이프라인 조합을 재검토한다. 이 과정을 흐름망 가이드드 생성(flow‑network‑guided generation)이라 부르며, 반복마다 전체 처리량 Φ를 재계산해 수렴할 때까지 진행한다.

시간적 변동에 대응하기 위해 오서브는 워크로드‑적응 전환 메커니즘을 도입한다. 미세 시간 간격의 시계열 예측 모델을 통해 다음 시간 구간의 워크로드 구성을 예측하고, 필요 시 현재 배치를 새로운 최적 배치로 전환한다. 전통적인 모델 재로드는 수십 초가 소요되지만, 오서브는 GPU‑GPU 직접 파라미터 전송을 활용해 전환 시간을 크게 단축한다.

실험에서는 70B 파라미터 모델을 대상으로 Azure 실사용 트레이스를 사용해 vLLM, Llumnix, Dynamo와 비교했다. 결과는 평균 1.5배, 최고 2배의 처리량 향상과 P99 지연 감소를 보여준다. 특히, 메모리‑집약 워크로드가 급증하는 구간에서는 텐서·파이프라인 혼합 병렬화가 데이터 병렬만을 사용하는 기존 시스템 대비 2.3배 이상의 효율을 기록했다.

오서브의 핵심 기여는 (1) 공간·시간 이질성을 동시에 모델링한 두 단계 흐름망 최적화, (2) 예측 기반 빠른 모델 전환, (3) 실제 대규모 트레이스를 통한 실증적 검증이다. 이 접근은 향후 멀티‑테넌시 클라우드 환경에서 다양한 LLM 서비스가 동시 운영될 때 자원 효율성을 크게 높일 수 있는 실용적인 로드맵을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기