AssetFormer 텍스트 기반 모듈형 3D 자산 자동 생성 트랜스포머

초록

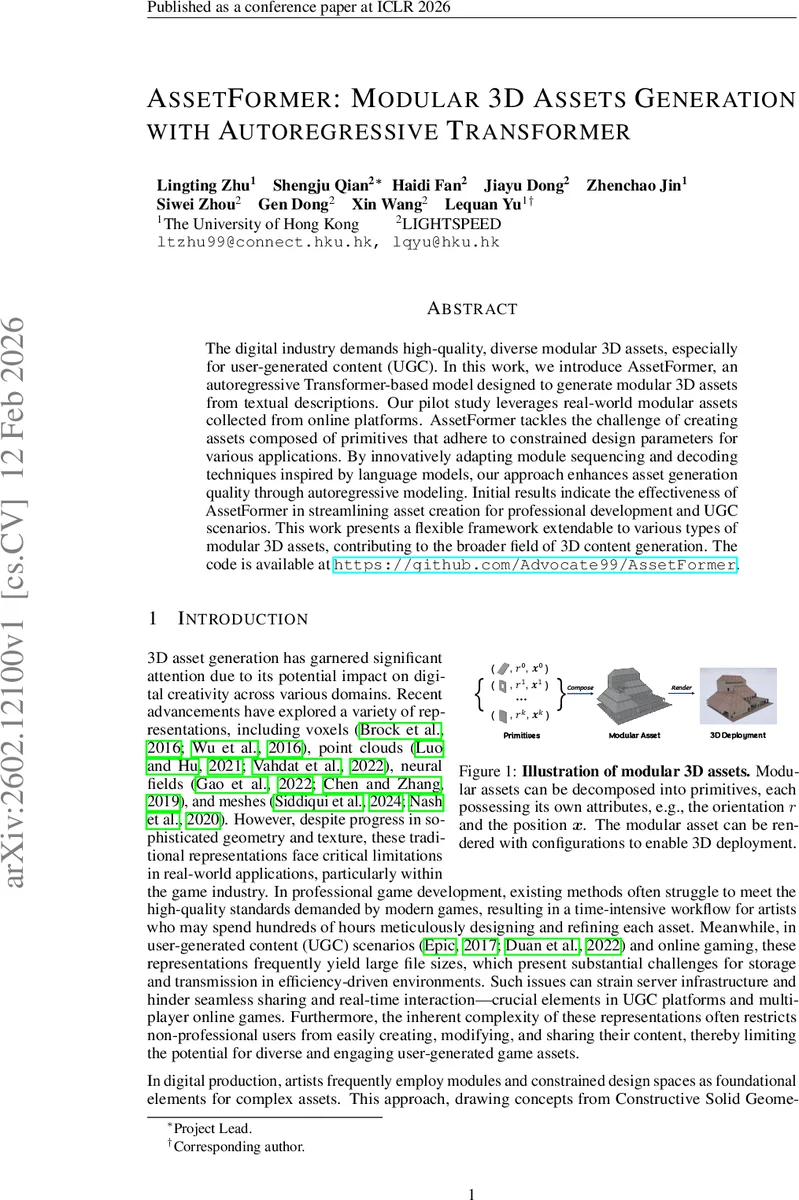

AssetFormer는 텍스트 설명을 입력으로 받아 모듈식 3D 자산을 자동으로 생성하는 디코더‑전용 트랜스포머 모델이다. 저자들은 온라인 게임 UGC 플랫폼에서 수집한 실제 모듈형 건축 자산을 토큰화하고, 프리오더링(DFS 기반)과 클래스‑프리 가이던스를 적용해 순차적 토큰 예측을 수행한다. 실험 결과, 기존 voxel·포인트클라우드·메시 기반 방법에 비해 높은 품질과 다양성을 보이며, 프로시저 기반 데이터와 실제 데이터 모두에서 유효성을 입증한다.

상세 분석

본 논문은 3D 콘텐츠 생성 분야에서 ‘모듈형 자산’이라는 특수한 도메인을 정의하고, 이를 텍스트‑조건부 자동 회귀 모델로 학습시키는 새로운 파이프라인을 제시한다. 주요 기여는 네 가지로 요약된다. 첫째, 저자들은 실제 게임 유저가 만든 건축 모듈을 수집·정제해 10만 개 이상의 고품질 데이터셋을 구축했으며, 이는 공개된 3D 데이터셋이 부족한 현 상황에서 의미 있는 자산이다. 둘째, 각 프리미티브를 클래스, 회전, 3차원 위치(x, y, z)라는 5개의 이산 토큰으로 표현하고, 이들을 하나의 시퀀스로 결합한다. 토큰화는 손실이 없으며, 기존의 그래프 인코더나 VQ‑GAN 기반 압축 방식보다 메모리 효율이 높다. 셋째, 토큰 순서가 모델 성능에 미치는 영향을 체계적으로 조사하였다. 저자들은 깊이 우선 탐색(DFS)과 너비 우선 탐색(BFS) 두 가지 그래프 순회 방식을 비교했으며, 실험적으로 DFS가 로컬 연결성을 더 잘 보존하고 학습 안정성을 높이는 것으로 나타났다. 또한, 토큰 재배열을 통해 ‘프리오더링’ 단계에서 공간적 계층 구조를 명시적으로 반영함으로써, 트랜스포머가 복잡한 공간 관계를 더 쉽게 학습하도록 설계했다. 넷째, 텍스트‑조건부 생성에서 클래스‑프리 가이던스(CFG)를 차용해 조건부와 무조건부 로그잇을 혼합함으로써 텍스트와의 정합성을 강화하고, 토큰 샘플링 시 발생할 수 있는 불합리한 토큰(예: 회전 토큰 뒤에 클래스 토큰이 오는 경우)를 필터링하는 ‘유효 토큰 디코딩’ 전략을 도입했다. 학습 손실은 표준 교차 엔트로피이며, Llama 기반 디코더에 1D 로터리 포지셔널 임베딩을 적용해 순서 정보를 보강한다. 실험에서는 실제 UGC 데이터와 프로시저 생성 데이터 두 가지 소스에 대해 FID, Diversity, 그리고 인간 평가를 통해 기존 메쉬·포인트클라우드·Voxel 기반 모델 대비 우수한 성능을 보고한다. 한계점으로는 현재 프리미티브가 제한된 클래스와 이산 회전·위치만을 지원한다는 점, 그리고 복잡한 곡면이나 텍스처 정보를 다루지 못한다는 점을 들 수 있다. 향후 연구에서는 연속형 파라미터와 고해상도 텍스처를 포함한 하이브리드 토큰화, 그리고 대규모 멀티모달 사전학습을 통해 범용 3D 생성 모델로 확장할 가능성을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기