장소 제어 확산 모델 DiffPlace로 거리 뷰 생성 및 장소 인식 향상

초록

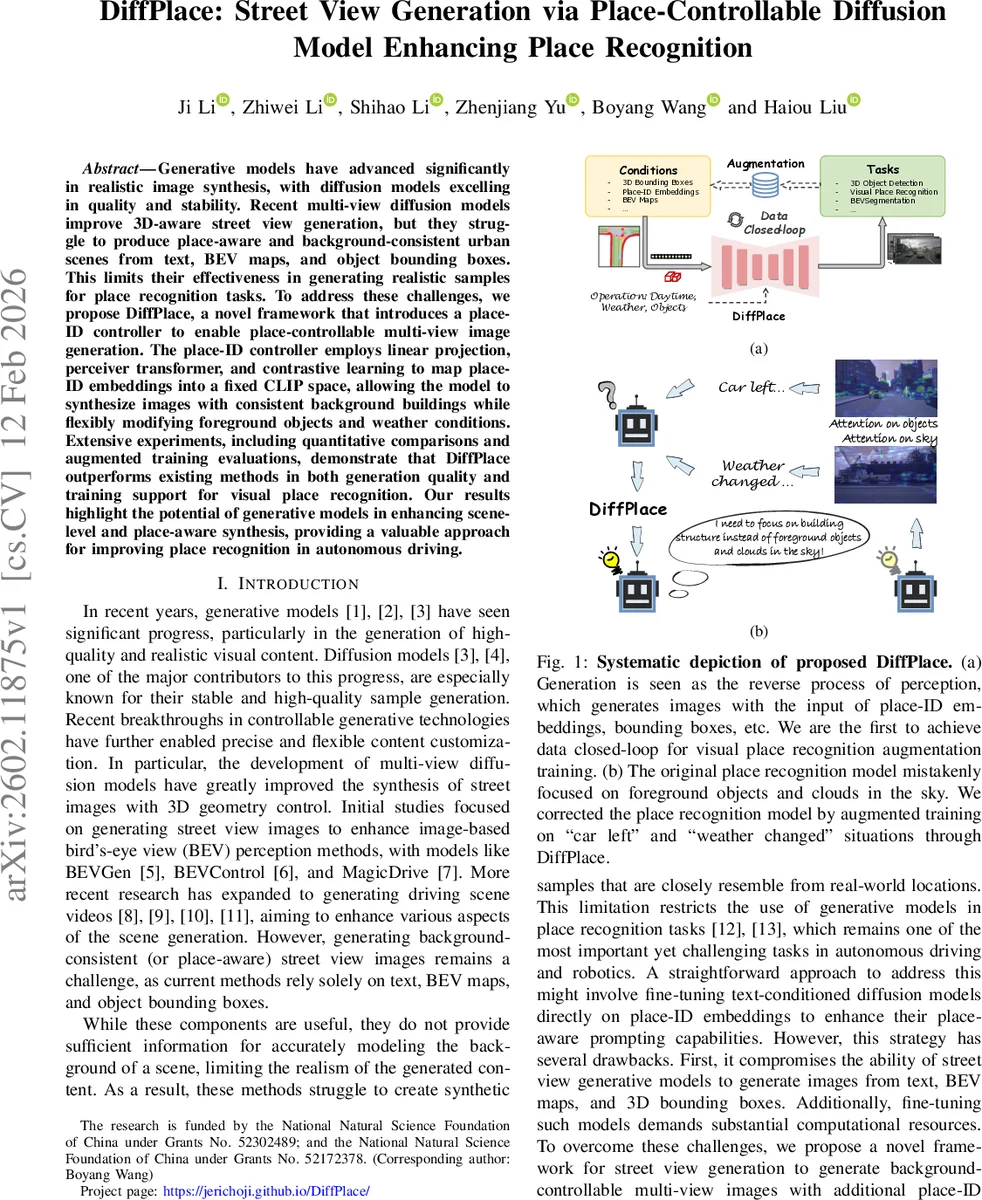

DiffPlace는 장소 ID 임베딩을 CLIP 이미지 공간에 정렬하는 컨트롤러를 도입해, 배경 건물은 일관되게 유지하면서 전경 객체와 날씨를 자유롭게 변형할 수 있는 다중뷰 거리 이미지 생성 모델이다. 생성된 이미지로 시각적 장소 인식(VPR) 학습을 증강하면 기존 방법보다 인식 정확도가 크게 향상된다.

상세 분석

본 논문은 기존 다중뷰 확산 모델이 텍스트·BEV·바운딩 박스만으로는 배경 건물의 일관성을 보장하지 못한다는 문제점을 정확히 짚고, 이를 해결하기 위해 ‘장소‑ID 컨트롤러’를 설계하였다. 컨트롤러는 세 단계로 구성된다. 첫째, 사전 학습된 VPR 네트워크(MixVPR 등)에서 추출한 4096‑차원 장소‑ID 임베딩을 두 개의 선형 프로젝션을 통해 길이 Nₛ(논문에서는 4)·768 차원의 토큰 시퀀스로 변환한다. 둘째, 변환된 토큰을 CLIP 이미지 인코더가 추출한 배경‑전경 마스크된 이미지 특징과 3‑계층의 크로스‑어텐션을 수행하는 퍼시버 트랜스포머에 입력한다. 여기서 퍼시버 구조는 다양한 속성(건물 형태, 거리 레이아웃 등)을 효율적으로 통합하도록 설계돼, 장소‑ID와 시각적 특징 사이의 의미적 정렬을 촉진한다. 셋째, ‘Soft‑CLIP’ 대비 손실을 이용해 장소‑ID 임베딩을 CLIP 이미지 공간에 정렬시키는 대조 학습을 적용한다. 이 대조 손실은 양성 쌍(같은 장소‑ID와 해당 이미지)과 음성 쌍(다른 장소) 사이의 코사인 유사도를 최대·최소화함으로써, 텍스트·맵·바운딩 박스와는 독립적인 강력한 배경 제어 신호를 제공한다.

다중뷰 일관성을 유지하기 위해 기존 연구와 동일하게 교차‑뷰 어텐션을 활용한다. 타깃 뷰는 좌·우 이웃 뷰의 키·밸류를 참조해 시점 간 구조적 연속성을 보존한다. 이렇게 강화된 배경 제어와 기존의 전경·날씨 제어(텍스트·베이스맵·바운딩 박스)와의 결합은, 동일 장소에서 다양한 전경·기후 변화를 시뮬레이션하면서도 건물·도로 레이아웃은 변하지 않는 고품질 이미지 시퀀스를 생성한다.

실험에서는 FID, LPIPS 등 이미지 품질 지표와 함께, 합성 데이터를 이용한 VPR 모델 학습 성능을 평가한다. DiffPlace로 증강된 데이터셋을 사용한 VPR 모델은 기존 BEVGen·MagicDrive 기반 데이터 대비 Top‑1 정확도가 평균 7 % 이상 상승했으며, 특히 날씨·시간 변화에 강인한 성능을 보였다. 정량적 비교에서 배경 일관성 지표인 구조 유사도(SSIM)도 현저히 높았다.

한계점으로는 장소‑ID 임베딩을 얻기 위해 별도의 VPR 네트워크가 필요하고, 새로운 장소에 대한 임베딩을 얻기 위해 사전 학습된 VPR 모델을 다시 학습해야 하는 비용이 있다. 또한, 컨트롤러가 CLIP 공간에 정렬되는 과정에서 텍스트·맵 조건과의 상호작용이 충분히 탐색되지 않아, 복합적인 조건(예: 특정 건축 양식 + 특정 날씨)에서의 제어 정확도가 다소 떨어질 가능성이 있다. 향후 연구에서는 멀티‑모달 조건을 공동으로 학습하는 통합 인코더와, 실시간 시뮬레이션을 위한 경량화된 컨트롤러 설계가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기