Talk2DM 대화형 자연어 질의와 상식 추론을 위한 차량 도로 클라우드 통합 동적 지도

초록

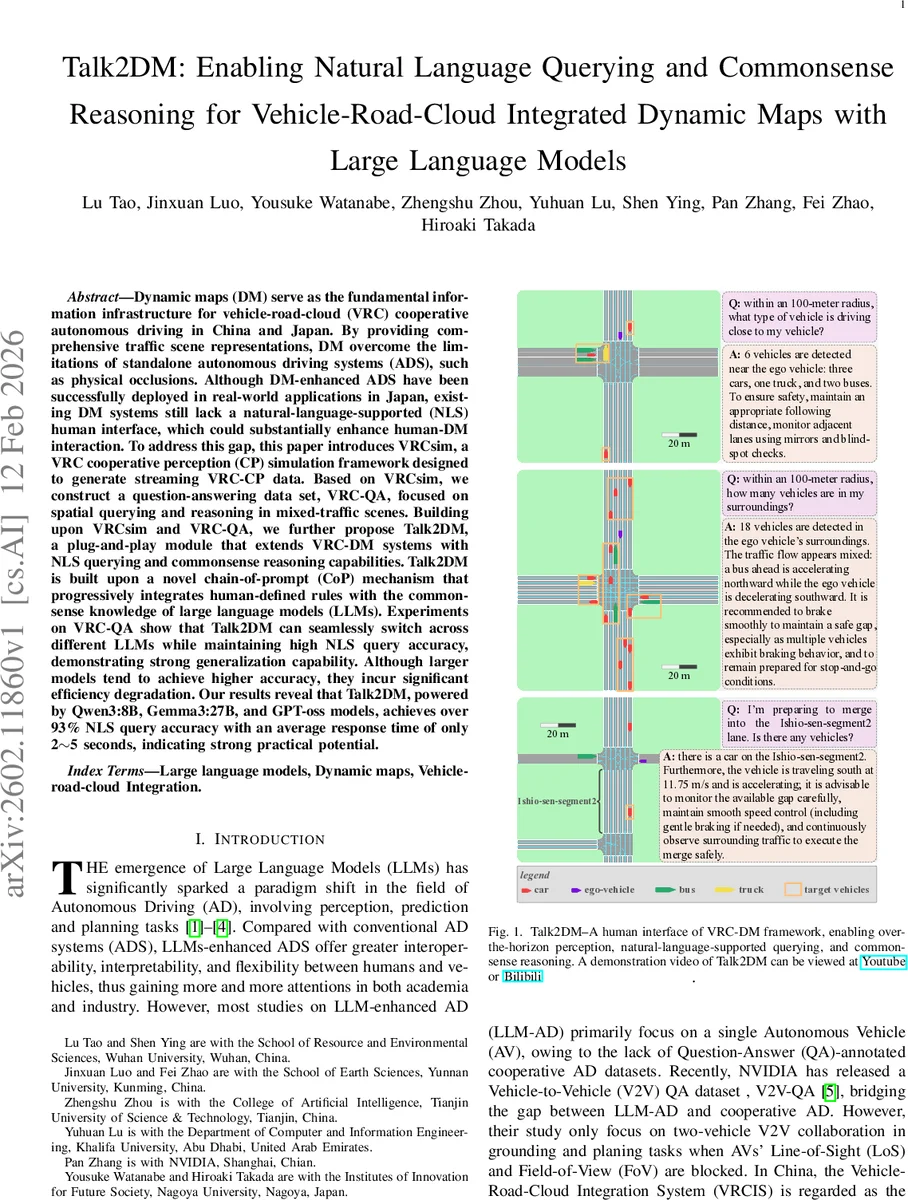

본 논문은 차량‑로드‑클라우드(VRC) 협업 환경에서 동적 지도(DM)를 자연어로 질의하고, 대형 언어 모델(LLM)의 상식 추론 능력을 활용할 수 있는 플러그인 모듈 Talk2DM을 제안한다. 이를 위해 VRCsim이라는 시뮬레이션 프레임워크와 10 K 이상의 교통 장면·100 K QA 쌍을 포함한 VRC‑QA 데이터셋을 구축하였다. Talk2DM은 인간 정의 규칙과 LLM의 내재 지식을 단계적으로 결합하는 체인‑오브‑프롬프트(CoP) 메커니즘을 채택해, 다양한 LLM에 손쉽게 적용하면서 93 % 이상의 정확도와 2~5초의 응답 시간을 달성한다.

상세 분석

Talk2DM의 핵심 혁신은 기존 동적 지도 시스템이 제공하는 SQL‑유사 정형 질의 인터페이스를 자연어 기반 인터페이스로 전환한다는 점이다. 이를 위해 저자들은 먼저 VRCsim을 설계했는데, SUMO, ROS2, Qt6을 결합해 차량·RSU·클라우드 간의 협업 인식(CP) 데이터를 실시간 스트리밍 형태로 생성한다. VRCsim은 차량과 도로 인프라의 감지 모델을 수식(1)(2)로 단순화하여, 객체 위치와 센서 범위 정보를 OI(Object Information) 토픽으로 클라우드 DM 노드에 전송한다. 이렇게 수집된 구조화 데이터는 디지털 벡터 씬으로 재구성되고, 텍스트 형태로 변환돼 LLM 입력으로 사용된다.

데이터셋 VRC‑QA는 “공간 질의”, “교통 흐름 추론”, “위험 상황 판단” 등 3가지 카테고리로 나뉘며, 각 장면에 대해 10개 이상의 질문‑답변 쌍을 제공한다. 질문은 인간 운전자가 흔히 묻는 “10 m 반경 내에 어떤 차량이 있나요?”와 같은 구체적 질의부터, “혼합 교통에서 차선 변경 시 위험 요소는?”과 같은 추론형 질문까지 다양하다.

Talk2DM의 체인‑오브‑프롬프트(CoP) 메커니즘은 (1) 규칙 기반 프리프로세싱 단계, (2) LLM에게 전달되는 자연어 질의, (3) LLM이 생성한 답변에 대한 후처리·검증 단계로 구성된다. 첫 단계에서는 도메인 전문가가 정의한 규칙(예: “시야가 차단된 경우 가장 가까운 객체를 우선 반환”)을 프롬프트에 삽입해 LLM이 기본적인 도메인 지식을 놓치지 않도록 한다. 두 번째 단계에서는 사용자의 자연어 질의를 그대로 전달하고, LLM은 내부 상식과 VRC‑QA에서 학습한 교통 도메인 지식을 활용해 답을 생성한다. 마지막 단계에서는 정형화된 검증 로직을 적용해 답변의 형식·범위 오류를 교정한다.

실험에서는 Qwen‑3:8B, Gemma‑3:27B, GPT‑oss 등 6가지 LLM을 동일한 CoP 파이프라인에 적용해 모델 교체가 손쉽게 이루어짐을 보였다. 정확도는 모델 규모에 비례해 상승했으며, 가장 큰 Gemma‑3:27B는 96.2 %의 정확도를 기록했다. 그러나 응답 시간은 2 s에서 5 s 사이로, 실시간 운전 지원 수준에 충분히 근접했다. 특히, 동일 데이터셋에 대해 기존 SQL‑기반 DM 질의는 78 % 수준에 머물렀던 반면, Talk2DM은 93 % 이상을 달성해 인간 친화적 인터페이스의 효과를 입증했다.

한계점으로는 현재 CoP가 규칙·프롬프트 설계에 인간 전문가 의존도가 높아, 새로운 교통 시나리오(예: 자율주행 트램, 드론 교통) 도입 시 재설계 비용이 발생한다는 점이다. 또한, 대형 LLM을 클라우드에 배치할 경우 네트워크 지연이 누적될 가능성이 있어, 엣지 컴퓨팅 기반 경량 LLM에 대한 최적화 연구가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기