객체에 집중하는 마스크: 멀티모달 LLM의 객체 환각 억제

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

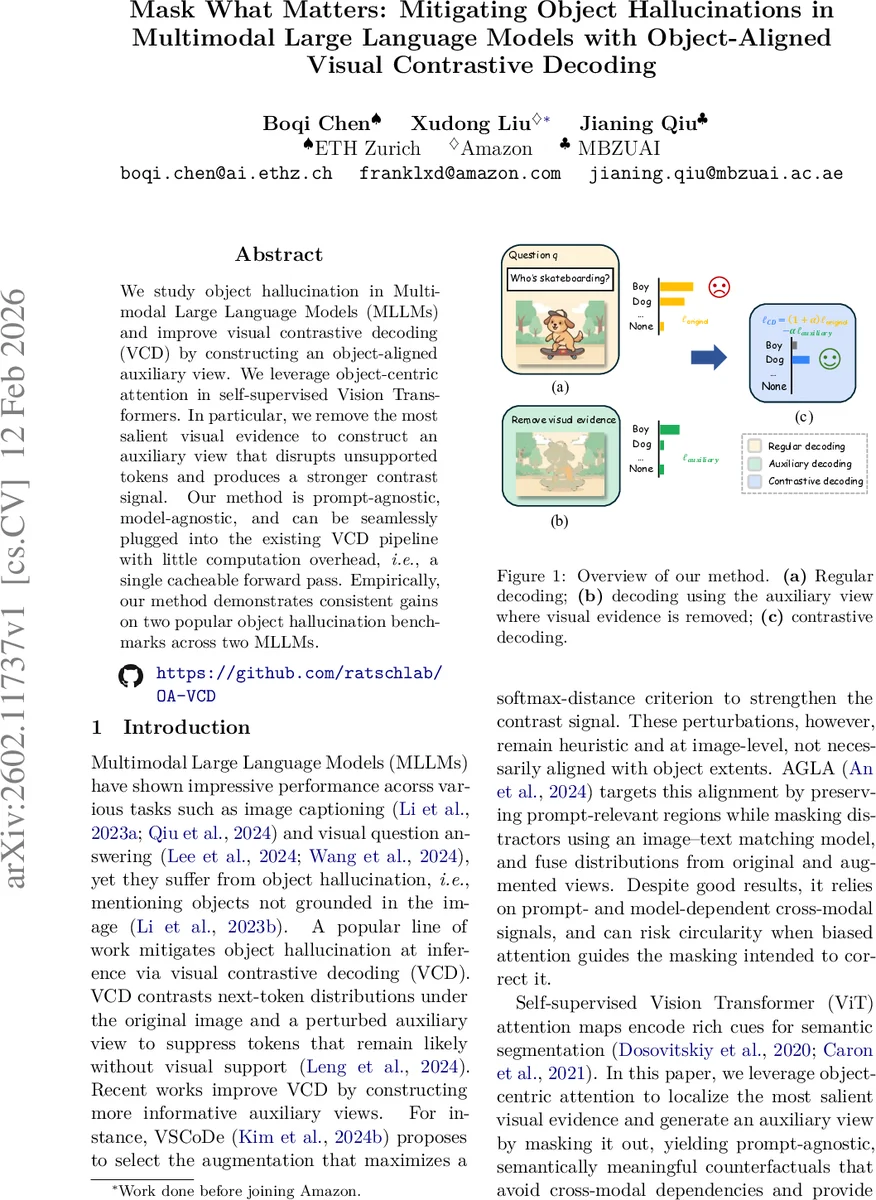

본 논문은 멀티모달 대형 언어 모델(MLLM)에서 발생하는 객체 환각을 완화하기 위해, 사전학습된 비전 트랜스포머(ViT)의 객체‑중심 어텐션을 활용해 가장 눈에 띄는 시각 증거를 마스크한 보조 이미지를 생성한다. 이 보조 뷰는 기존 VCD(Vision Contrastive Decoding) 파이프라인에 단일 캐시 가능한 포워드 패스로 쉽게 삽입될 수 있으며, 프롬프트·모델에 독립적이다. 실험 결과 POPE와 MME 두 벤치마크에서 두 종류의 MLLM(LLaVA‑v1.5, Qwen‑VL) 모두 일관된 성능 향상을 보였다.

상세 분석

이 논문은 멀티모달 LLM이 이미지와 텍스트를 결합해 응답을 생성할 때, 이미지에 존재하지 않는 객체를 언급하는 ‘객체 환각’ 문제에 초점을 맞춘다. 기존 해결책인 Visual Contrastive Decoding(VCD)은 원본 이미지와 변형된 보조 이미지를 동시에 디코딩해 토큰 확률 차이를 이용해 시각적 근거가 없는 토큰을 억제한다. 그러나 기존 보조 이미지 생성 방식은 블러, 크롭, 색상 변형 등 이미지‑레벨의 휴리스틱 변형에 불과해 객체 경계와 정렬되지 않아 대비 신호가 약하다.

본 연구는 self‑supervised ViT(DINO)에서 추출한

댓글 및 학술 토론

Loading comments...

의견 남기기