분산 인식 모델 병합을 위한 희소 보완 융합과 역 KL

초록

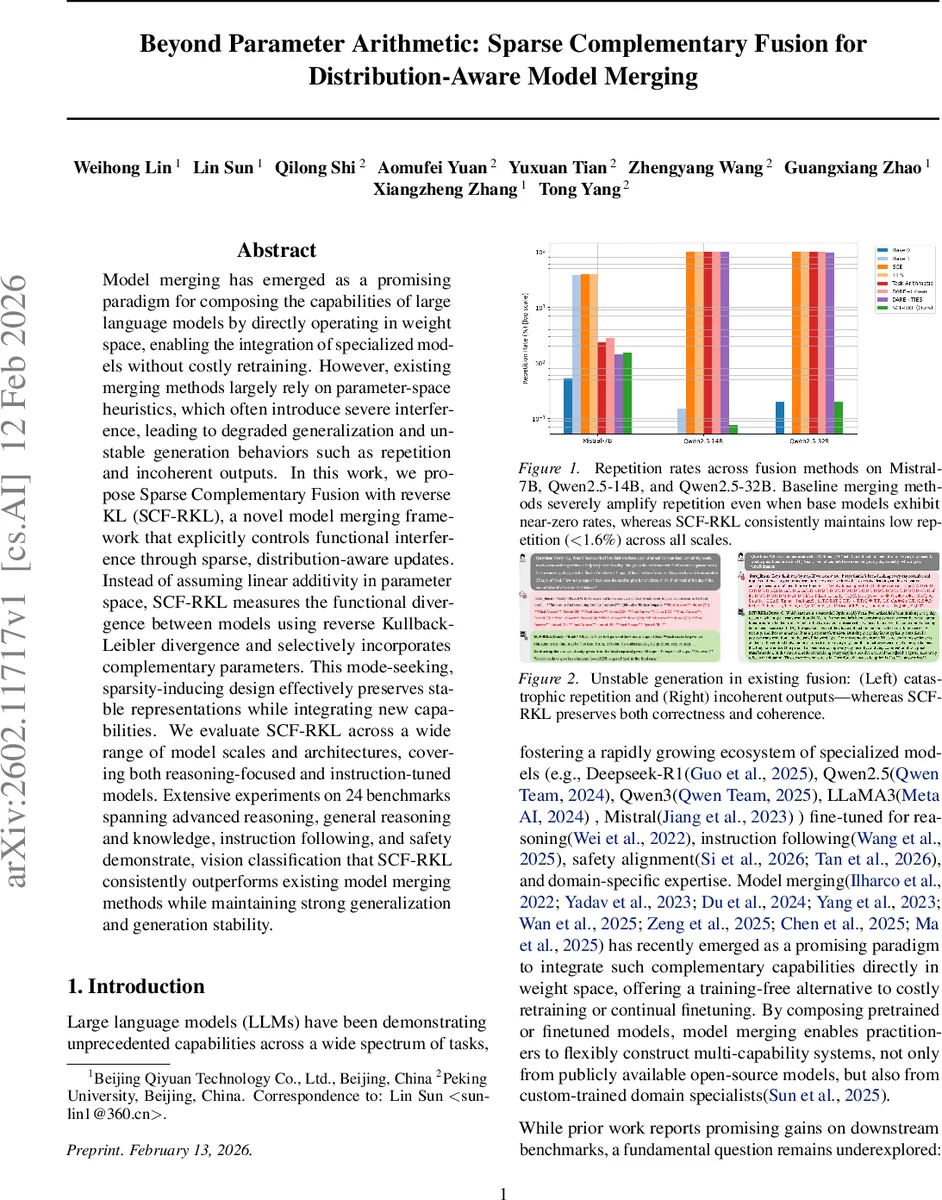

SCF‑RKL은 역 Kullback‑Leibler(KL) 발산을 이용해 모델 간 기능 차이를 정량화하고, 정보‑중요도가 높은 파라미터만을 선택적으로 교체하는 희소 병합 기법이다. 기존의 전역 파라미터 평균 방식이 초래하는 반복·불안정 현상을 억제하고, 7B‑32B 규모의 다양한 LLM 및 비전 모델에서 24개 벤치마크 전반에 걸쳐 성능·생성 안정성을 동시에 향상시킨다.

상세 분석

본 논문은 대규모 언어 모델(LLM) 병합 시 발생하는 “파라미터 간 간섭” 문제를 근본적으로 재정의한다. 기존 방법들은 파라미터 공간에서 선형 가중 평균을 수행하거나, 전체 파라미터를 일괄 업데이트함으로써 베이스 모델의 출력 분포를 크게 왜곡한다. 그 결과 토큰 확률이 고정된 소수의 고확률 토큰에 집중돼 반복 생성과 의미 불일치가 빈번히 발생한다. SCF‑RKL은 이러한 현상을 두 단계로 차단한다. 첫째, 베이스 모델 θ₀와 보조 모델 θ₁을 각각 softmax를 적용해 확률 분포 q, p 로 변환하고, 역 KL RKL(q‖p)=∑qᵢ log(qᵢ/pᵢ) 를 계산한다. 역 KL은 베이스 모델의 고확률 영역을 보존하도록 패널티를 부여하므로, 베이스 모델의 주요 모드를 유지하면서 보조 모델이 제공하는 새로운 지식만을 선택적으로 받아들일 수 있다. 둘째, 파라미터 차이 |θ₁‑θ₀|와 역 KL 값을 곱해 정보‑중요도 I를 정의하고, I의 중앙값·IQR 기반 동적 임계값 τ를 설정한다. I≥τ 인 파라미터만을 1‑mask M에 표시해 희소하게 업데이트한다. 이 과정은 “디스크리트 컴포지션”을 보장한다(각 파라미터는 θ₀ 혹은 θ₁ 중 하나에 완전히 복사됨).

이론적 분석에서는 (1) Semantic Stability 정리를 통해 RKL‑가중 마스크가 적용된 후의 출력 분포 q_f 가 원본 베이스 분포 q와의 KL 발산이 보조 모델 p와의 KL 발산보다 작거나 같음을 증명한다. 이는 역 KL의 볼록성에 기반한 결과이며, 병합 후 베이스 모델의 의미적 일관성을 보장한다. (2) Entropy Preservation 정리는 Lipschitz 연속성을 가정해, 희소 업데이트가 전체 파라미터 변화 ‖M⊙(θ₁‑θ₀)‖₂ 를 크게 감소시키므로 엔트로피 감소가 미미함을 보인다. 따라서 토큰 다양성이 유지돼 반복 생성이 억제된다. (3) Subspace Rotation Bound 정리는 행렬 교란 이론을 이용해, 희소 업데이트가 특잇값 스펙트럼 갭 δ에 비례한 상한 sinΘ_max ≤ ‖M⊙Δθ‖₂/δ 를 만족함을 보여준다. 실험 결과는 SCF‑RKL이 기존 방법에 비해 최대 주축 회전각을 40° 이하로 제한하고, Normalized Spectral Shift(NSS)를 10⁻³ 수준으로 낮춰 스펙트럼 구조를 거의 그대로 유지함을 시각적으로 확인한다.

실험에서는 Qwen2.5, LLaMA3, Mistral 등 7B‑32B 규모의 모델을 대상으로 24개의 베ン치마크(고급 추론, 일반 추론·지식, 명령 수행, 안전성, 비전 분류)를 평가하였다. SCF‑RKL은 모든 베이스‑보조 조합에서 (i) 평균 성능이 기존 병합 기법보다 1‑3%p 상승, (ii) 반복률을 0.5% 이하로 억제, (iii) 비대칭 병합(베이스가 약한 경우)에서도 베이스 모델을 거의 손상시키지 않으며, (iv) 안전성 테스트에서 위험 토큰 생성 비율을 현저히 낮추는 등 전반적인 우수성을 입증한다. 특히 비전 태스크에서는 텍스트‑이미지 멀티모달 모델에 적용했을 때, 이미지 분류 정확도가 기존 방법 대비 2‑3%p 향상되었으며, 스펙트럼 분석에서도 동일한 안정성을 보였다.

결과적으로 SCF‑RKL은 “희소 + 역 KL”라는 두 축을 결합해, 파라미터 공간의 무차별 평균을 지양하고, 기능적 차이를 정량화해 고정보조 파라미터만을 선택함으로써 모델 병합의 핵심 문제인 모드 붕괴와 반복 생성, 불안정성을 근본적으로 해결한다.

댓글 및 학술 토론

Loading comments...

의견 남기기