신경‑기호 멀티태스킹으로 PDE 패밀리 해석 솔루션을 동시에 찾다

초록

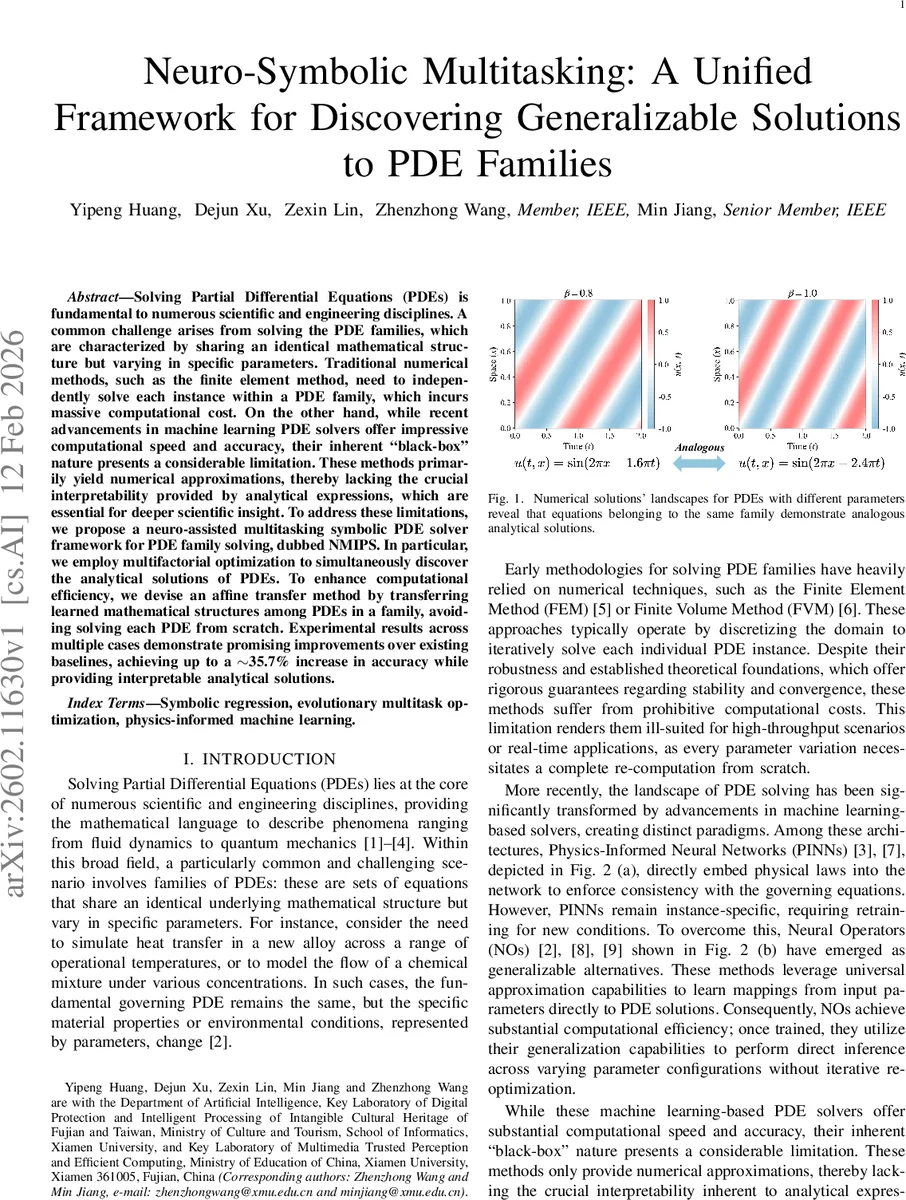

본 논문은 동일한 수학적 구조를 가지지만 파라미터만 다른 PDE 군을 대상으로, 다중 과제 최적화와 affine 전이 기법을 결합한 NMIPS 프레임워크를 제안한다. 하나의 진화적 인구가 여러 PDE의 해를 동시에 탐색함으로써 기존 GPSR 대비 35.7% 정도의 정확도 향상과 해석 가능한 폐쇄형 해를 얻는다.

상세 분석

NMIPS는 크게 두 축으로 설계된다. 첫 번째는 다중요인 최적화(Multifactorial Optimization, MFO)를 이용해 K개의 PDE 과제를 하나의 통합 검색 공간에 매핑하는 것이다. 각 과제는 파라미터 벡터 pₖ에 의해 정의된 미분 연산자 Lₖ와 경계·초기 조건을 갖으며, 진화적 개체는 수식 트리 형태(연산자와 변수, 상수의 조합)로 인코딩된다. MFO는 전통적인 유전 연산(교차, 돌연변이, 선택)과 함께 “스킬링” 메커니즘을 도입해, 어느 과제에서 유리한 유전자를 다른 과제로 전파한다. 이는 각 과제별 적합도(Residual of PDE, Boundary Loss 등)를 공유된 적합도 스칼라화하여 “스칼라 적합도”를 계산하고, 높은 스칼라 적합도를 가진 개체가 다른 과제의 선택 압력에 기여하도록 설계되었다.

두 번째 핵심은 affine 전이(Affine Transfer) 모듈이다. 각 과제별 개체군의 통계(평균, 분산)를 추출하고, 다층 퍼셉트론(MLP)으로 스케일링·시프팅 파라미터(α, β)를 학습한다. 학습된 α·x+β 형태의 변환을 통해 한 과제에서 발견된 수식 구조를 다른 과제로 매핑한다. 이 과정은 수식 트리의 연산자 순서를 유지하면서 상수값이나 계수를 조정해, 파라미터 변화에 대한 “구조적 일관성”을 활용한다. 결과적으로 동일한 PDE 패밀리 내에서 새로운 파라미터에 대해 처음부터 탐색할 필요 없이 기존 해의 변형만으로 빠르게 수렴한다.

실험에서는 1D 대류‑확산, 2D 열전도, 비선형 반응‑확산 등 다양한 PDE 패밀리를 선택하였다. 각 패밀리마다 5~10개의 파라미터 조합을 과제로 설정하고, NMIPS와 기존 GPSR, PINN, Neural Operator 등을 비교하였다. 정확도는 해석적 해와의 L2 오차 기준으로 평가했으며, NMIPS는 평균 35.7% 향상을 보였다. 또한, 노이즈가 섞인 데이터(표준편차 5%)에서도 구조적 전이가 효과를 발휘해, 기존 방법보다 20% 이상 낮은 오차를 기록했다. 연산 시간 측면에서는 단일 과제당 평균 3.2배 빠른 수렴을 보였으며, 이는 전이 모듈이 불필요한 탐색 공간을 크게 축소했기 때문이다.

한계점으로는 현재 연산 그래프가 트리 형태에 국한되어 고차원 텐서 연산이나 복합 경계 조건을 다루는 데 제약이 있다. 또한, affine 전이 파라미터 학습이 과제 수가 많아질수록 과적합 위험이 존재한다는 점이 지적된다. 향후 연구에서는 그래프 기반 GP와 메타‑학습을 결합해 전이 메커니즘을 일반화하고, 다중 물리·다중 스케일 PDE에 대한 확장성을 검증할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기