멀티모달 강화학습을 위한 모달리티 인식 포스트 트레이닝 생태계

초록

MAPLE은 텍스트·음성·영상 3가지 입력을 활용하는 멀티모달 언어 모델의 포스트‑트레이닝을 위해, 각 과제에 실제로 필요한 최소 신호 조합을 명시한 벤치마크(MAPLE‑bench)와, 신호 조합별로 배치를 구분해 정책 그래디언트 분산을 감소시키는 모달리티‑인식 정책 최적화 프레임워크(MAPO), 그리고 난이도 기반 가중치와 커리큘럼 스케줄링을 결합한 학습 전략을 제안한다. 실험 결과, 유니·멀티모달 정확도 격차를 30 % 이상 줄이고, 수렴 속도를 3배 가량 가속화했으며, 신호가 누락되거나 재가중될 때도 안정적인 성능을 유지한다.

상세 분석

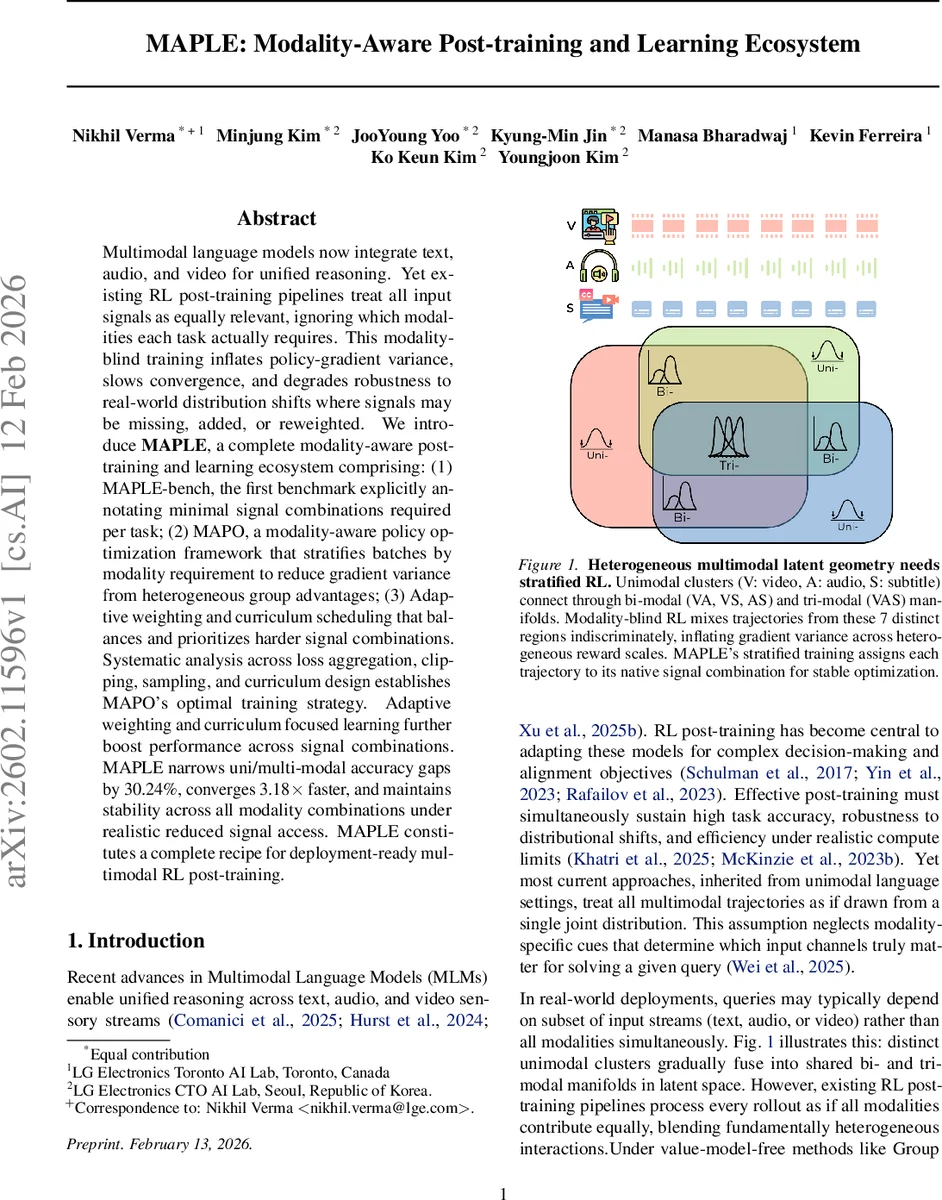

본 논문은 멀티모달 언어 모델(MLM)의 포스트‑트레이닝 단계에서 발생하는 핵심 문제를 두 가지 관점에서 재조명한다. 첫째, 기존 RL 기반 포스트‑트레이닝 파이프라인은 모든 입력 신호를 동일하게 취급해, 실제 과제에 필요하지 않은 모달리티까지 학습에 포함시킨다. 이는 서로 다른 모달리티 조합이 갖는 보상 스케일과 노이즈 특성이 상이함에도 불구하고, 배치 내에서 평균·표준편차를 공동 정규화함으로써 정책 그래디언트의 분산을 크게 증가시킨다. 논문은 이를 수학적으로 var(g_MU)=var_intra+var_inter 형태로 분해하고, var_inter(모달리티 간 차이) 가 비제로일 경우 분산 감소 효과가 기대된다고 증명한다. 둘째, 실세계 서비스에서는 영상·음성·자막 중 일부가 누락되거나 품질이 저하되는 상황이 빈번히 발생한다. 모달리티‑블라인드 학습은 이러한 분포 이동에 취약해, 테스트 시 성능 급락을 초래한다.

MAPLE‑bench은 각 데이터 샘플에 “Required Modality Tag(RMT)”를 부여해, 최소 필요 신호 조합을 명시한다. 이를 통해 학습 단계에서 RMT별로 배치를 스트래티파이(stratify)하고, MAPO는 RMT별로 독립적인 어드밴티지 정규화와 손실 집계를 수행한다. 구체적으로, 배치 B_M은 동일 RMT를 가진 샘플만 포함하고, 어드밴티지 Â(M)j는 해당 배치 내 보상의 평균·표준편차로 정규화한다. 이렇게 하면 var_inter가 제거되어 그래디언트 분산이 크게 감소한다.

추가로 제안된 적응 가중치와 커리큘럼은 KL‑다이버전스를 이용해 현재 배치의 난이도를 추정하고, 난이도가 높은 RMT에 대해 가중치 w_M을 낮게, 쉬운 RMT에 대해 높게 조정한다. 가중치는 sigmoid( z_M ) 형태로 업데이트되며, z_M은 현재 보상 분포와 목표 베타 분포 간 KL‑값을 정규화한 결과이다. 또한 epoch마다 KL‑통계를 기반으로 배치 순서를 “쉬운 → 어려운” 순으로 재배열해, 그래디언트 스케일 차이에 의한 학습 편향을 완화한다.

실험에서는 GRPO, Dr‑GRPO, DAPO 등 기존 가치‑모델‑프리 RL 옵티마이저와 비교했을 때, MAPO는 동일한 연산량 대비 3.18배 빠르게 수렴하고, 유니·멀티모달 정확도 격차를 평균 30.24% 감소시켰다. 특히 신호가 50% 이상 누락된 상황에서도 성능 저하가 최소화돼, 실제 배포 환경에 적합한 견고성을 보였다.

전반적으로 MAPLE은 모달리티 정보를 명시적으로 활용함으로써, 멀티모달 RL 포스트‑트레이닝의 효율성, 안정성, 그리고 현실 적응성을 동시에 달성한 최초의 종합 솔루션이라 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기