차등프라이버시와 통신 효율을 동시에 잡은 LLM 분할 추론 프레임워크 DEL

초록

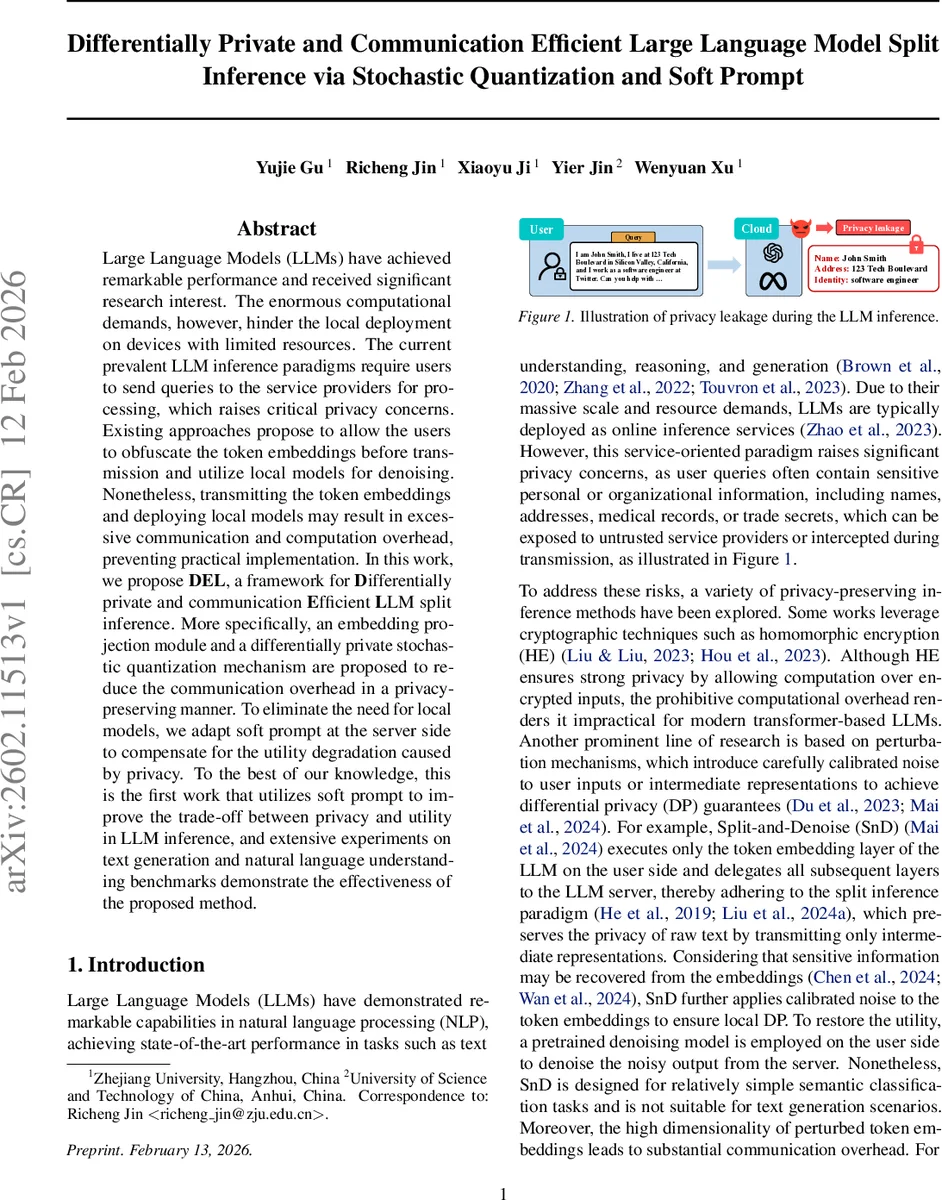

본 논문은 사용자 측에서 토큰 임베딩을 저차원으로 투사하고, 차등프라이버시를 보장하는 확률적 n‑비트 양자화 기법을 적용해 전송량을 크게 줄인다. 서버에서는 복원된 임베딩에 소프트 프롬프트를 추가 학습시켜 프라이버시로 인한 성능 저하를 보상한다. 이를 통해 로컬 디노이징 모델 없이도 텍스트 생성·이해 작업에서 기존 DP 기반 방법보다 우수한 프라이버시‑유틸리티 트레이드오프와 통신 효율성을 달성한다.

상세 분석

이 연구는 LLM 서비스 환경에서 사용자의 민감 정보를 보호하면서도 실용적인 추론을 가능하게 하는 두 가지 핵심 아이디어를 제시한다. 첫 번째는 임베딩 투사와 확률적 양자화이다. 기존 DP 메커니즘이 고차원 연속 벡터에 직접 적용될 경우, 노이즈 규모가 차원에 비례해 급증해 유틸리티가 크게 손상된다. 저자들은 사전 학습된 인코더‑디코더 쌍(g_e, g_d)을 이용해 토큰 임베딩을 d‑차원(latent space)으로 압축한다. 압축 단계에서 클리핑(C)과 가우시안 노이즈를 적용해 µ‑GDP를 만족시키고, 이후 stochastic n‑bit quantization을 통해 각 차원당 2^n 개의 균일 레벨로 양자화한다. 양자화 과정 자체가 확률적이므로, 동일한 레벨에 매핑될 확률이 존재해 추가적인 프라이버시 이득을 제공한다. A 파라미터를 크게 잡으면 양자화 레벨이 넓어져 노이즈와 양자화 오차가 결합된 효과가 강화된다. 이 설계는 통신량을 b·T 바이트(원본 임베딩)에서 (n·d·T)/8 바이트 수준으로 감소시켜, 1024 토큰 기준 16 MB → 수백 KB 수준으로 압축한다.

두 번째 핵심은 서버‑사이드 소프트 프롬프트 활용이다. 기존 Split‑and‑Denoise(SnD)와 InferDPT는 로컬에 디노이징 혹은 경량 LLM을 배치해 노이즈를 정제했지만, 이는 사용자 디바이스에 큰 연산·메모리 부담을 초래한다. DEL은 서버에서 복원된 임베딩에 학습 가능한 연속 프롬프트 벡터를 사전 삽입한다. 이 소프트 프롬프트는 전체 LLM 파라미터를 고정한 채, 프라이버시로 손상된 입력을 보정하도록 최적화된다. 실험 결과, 소프트 프롬프트만으로도 디노이징 모델이 제공하던 성능 회복 효과의 80 % 이상을 달성하면서, 추론 지연과 메모리 사용량을 크게 낮출 수 있었다.

프라이버시 분석 측면에서, 저자들은 양자화 단계까지 포함한 전체 파이프라인이 µ‑GDP를 만족함을 정리식(6)–(9)를 통해 증명한다. 특히, 양자화 스케일 A와 차원 d가 프라이버시 예산 ε에 직접적인 영향을 미치므로, 사용자는 통신 비용과 프라이버시 요구사항 사이에서 명시적인 트레이드오프 파라미터를 조정할 수 있다. 실험에서는 Llama‑3‑8B, Llama‑2‑13B 등 다양한 모델에 대해 ε∈

댓글 및 학술 토론

Loading comments...

의견 남기기