상상하는 에이전트, HOI 인식의 새로운 지평을 열다

초록

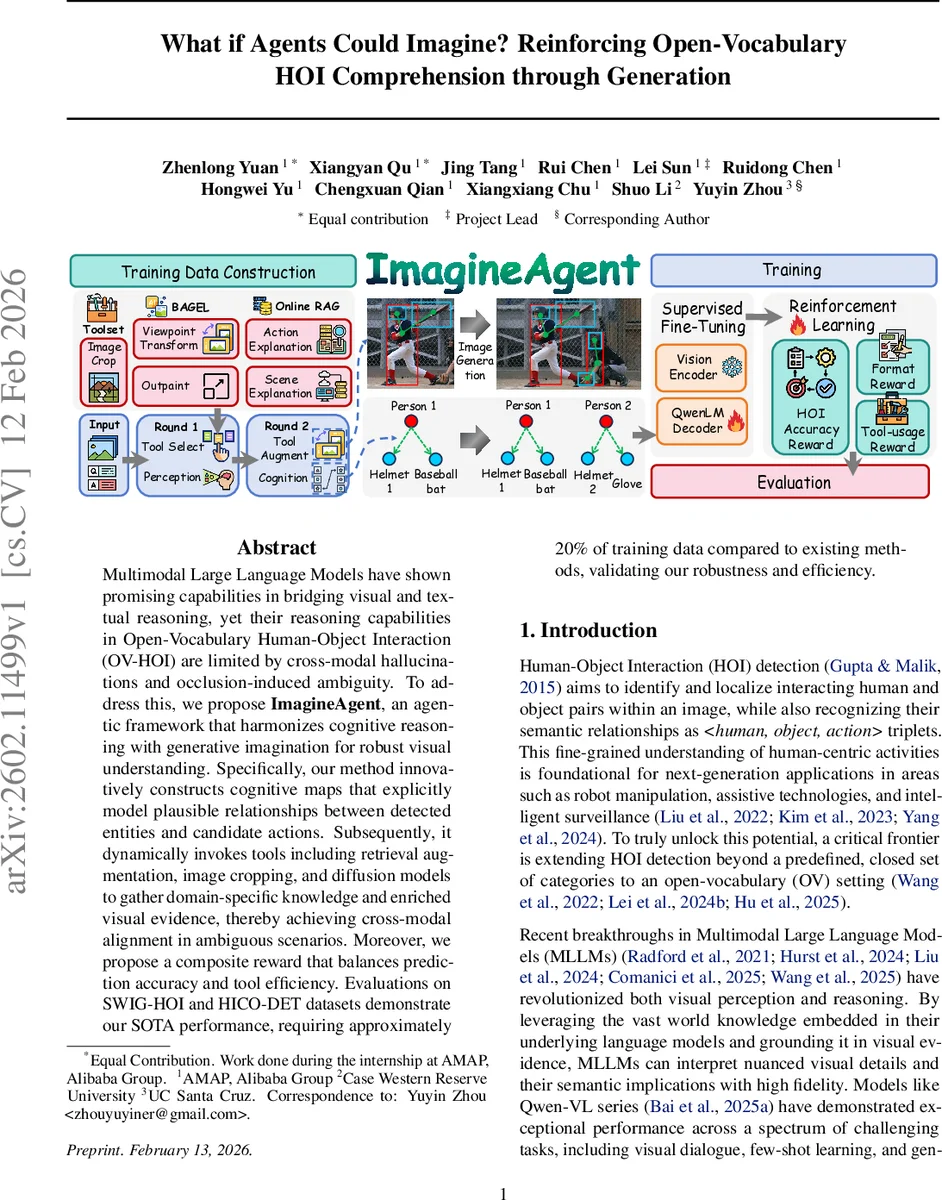

ImagineAgent는 인지 맵을 구축하고, 이미지 크롭·리트리벌·디퓨전 모델 등 도구를 동적으로 호출해 시각적 증거와 외부 지식을 보강한다. 강화학습 기반 복합 보상으로 정확도와 도구 효율성을 동시에 최적화해, 제한된 학습 데이터(20%만 사용)로도 SWIG‑HOI·HICO‑DET에서 최첨단 성능을 달성한다.

상세 분석

본 논문은 오픈‑보캘러리 인간‑객체 상호작용(OV‑HOI) 문제에서 기존 멀티모달 대형 언어 모델(MLLM)이 겪는 ‘지각‑인지 격차’, ‘교차‑모달 환각’, ‘폐색‑유발 모호성’ 세 가지 근본적 한계를 체계적으로 분석한다. 첫 번째는 객체와 인간을 각각 인식하더라도 물리적·의미적 연결을 형성하지 못한다는 점이며, 이는 구조화된 인지 맵이 부재하기 때문이다. 두 번째는 텍스트 사전지식에 과도히 의존해 시각적 근거가 부족한 상호작용을 생성하는 현상으로, 특히 개방형 어휘 환경에서 분포 이동이 심할 때 악화된다. 세 번째는 부분 폐색이나 시점 제한으로 핵심 시각 정보가 손실될 때, 모델이 텍스트 기반 추론에 의존해 오류를 범한다.

ImagineAgent는 이러한 문제를 해결하기 위해 세 가지 핵심 모듈을 제안한다. ① 인지 맵(Cognitive Map): 감지된 인간·객체 인스턴스를 그래프 형태로 정리하고, 가능한 동사 후보를 연결한다. 이 그래프는 물리적 접촉 가능성, 동작 전후 관계 등을 규칙 기반 혹은 학습된 프리즘으로 제한해, 비현실적 연결을 사전에 차단한다. ② 툴 증강(Tool Augmentation): 사전 정의된 툴 라이브러리(이미지 크롭, 장면·행동 설명을 위한 RAG, 뷰포인트 변환·아웃페인팅 디퓨전)를 정책 네트워크가 상황에 맞게 선택·호출한다. 예를 들어, 특정 인간‑객체 쌍에 대한 시각적 증거가 부족하면 크롭 툴로 고해상도 부분을 추출하고, RAG 툴로 해당 동작에 대한 외부 정의를 검색한다. ③ 생성적 세계 모델(Generative World Model): 디퓨전 기반 뷰포인트 변환·아웃페인팅을 통해 폐색된 영역을 ‘상상’한다. 이는 물리적으로 일관된 가상 이미지 I′를 생성해, 이후 인지 맵과 결합해 최종 HOI 트리플을 예측한다.

학습 단계는 두 단계로 구성된다. 첫 번째는 대규모 베이스 모델(Qwen2.5‑VL)을 이용해 다중 롤아웃을 수행하고, 성공적인 추론 경로를 수집해 구조화된 ‘추론 체인’ 데이터를 만든다. 이를 통해 **감독 미세조정(Supervised Fine‑Tuning)**을 수행해 정책 네트워크가 기본적인 인지‑툴 호출 흐름을 학습한다. 두 번째는 강화학습(RL) 단계로, GRPO(Generalized Reward‑Based Policy Optimization) 알고리즘을 적용한다. 보상 함수는 (1) HOI 정확도(precision·recall), (2) 인지 맵의 구조적 일관성, (3) 툴 사용 비용(호출 횟수·연산량) 세 요소를 가중합한 복합 보상이다. 이를 통해 에이전트는 최소한의 툴 호출로 최대 정확도를 달성하도록 정책을 최적화한다.

실험 결과, ImagineAgent는 SWIG‑HOI와 HICO‑DET 두 데이터셋에서 기존 최첨단 방법 대비 3~5% AP 상승을 기록했으며, 학습 데이터 양을 20% 수준으로 축소해도 성능 저하가 거의 없었다. 특히 폐색이 심한 이미지와 텍스트 사전지식과 불일치가 큰 케이스에서 기존 MLLM이 빈번히 발생시키던 환각을 크게 감소시켰다. Ablation study는(1) 인지 맵 없이 툴만 사용했을 때 성능이 2% 이하 감소, (2) 툴 없이 인지 맵만 사용했을 때도 1.8% 감소, (3) 생성적 뷰포인트 변환을 제외하면 폐색 상황에서 AP가 4% 급감함을 보여, 세 모듈이 상호보완적으로 작동함을 입증한다.

이 논문은 ‘상상’이라는 생성적 세계 모델을 도구 기반 강화학습과 결합함으로써, 비전‑언어 모델이 단순히 입력을 수동적으로 해석하는 수준을 넘어 능동적·다단계 추론 에이전트로 진화할 가능성을 제시한다. 향후 로봇 조작, 인간‑로봇 협업, 실시간 감시 등 인간 중심 인지 시스템에 적용될 여지가 크다.

댓글 및 학술 토론

Loading comments...

의견 남기기