다중비율 자동 토큰 예측 기반 특징 압축 프레임워크

초록

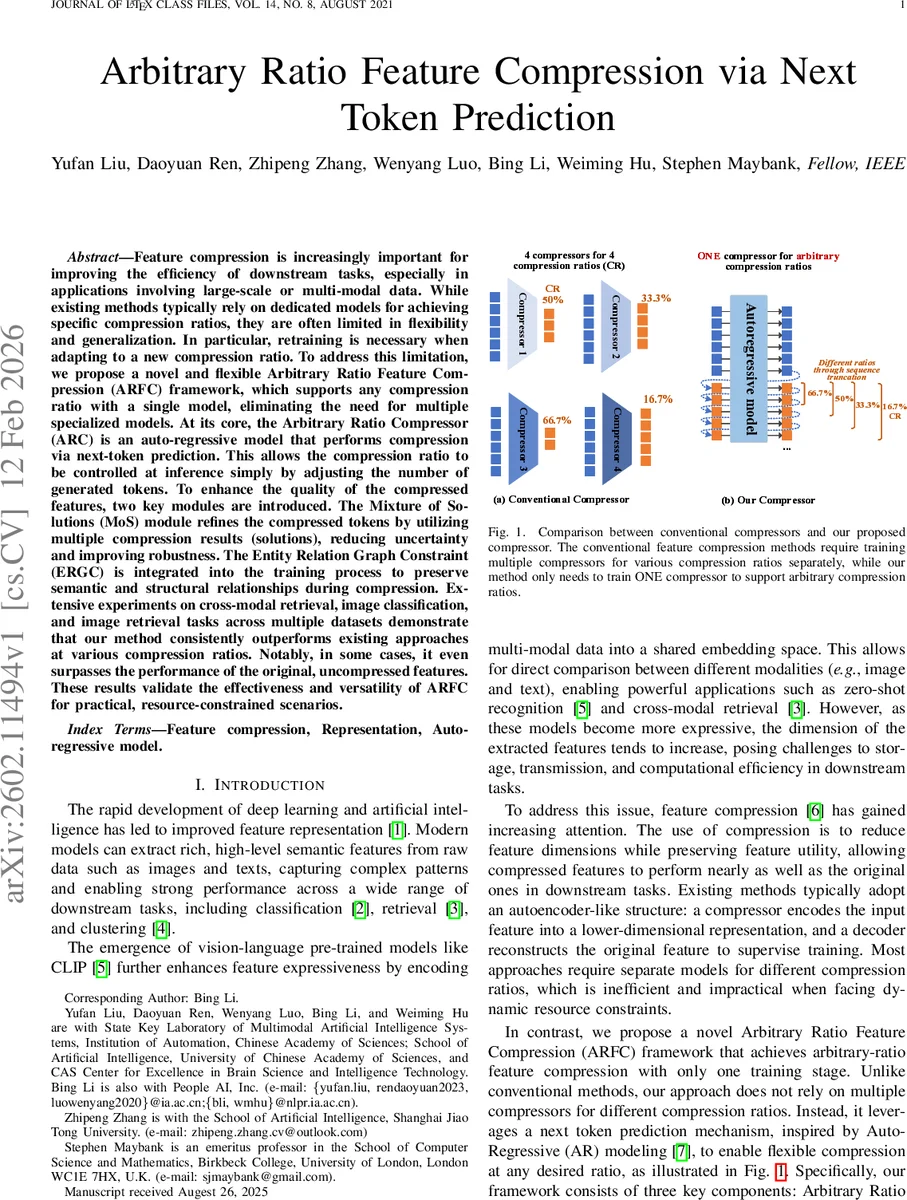

본 논문은 하나의 모델만으로 任意(임의)의 압축 비율을 지원하는 ARFC(Arbitrary Ratio Feature Compression) 체계를 제안한다. 핵심인 ARC(Arbitrary Ratio Compressor)는 Transformer 기반 자동 회귀 모델을 이용해 입력 특징을 토큰 순서대로 예측함으로써 원하는 토큰 수만큼 출력해 압축 비율을 조절한다. 품질 향상을 위해 다중 솔루션을 결합하는 Mixture of Solutions(MoS)와 의미·구조 관계를 보존하는 Entity Relation Graph Constraint(ERGC)를 도입한다. 다양한 멀티모달 데이터셋에서 기존 압축 방법들을 능가하며, 경우에 따라 원본 특징보다 높은 성능을 기록한다.

상세 분석

ARFC는 기존 압축 방식이 압축 비율마다 별도 모델을 학습해야 하는 비효율성을 근본적으로 해결한다는 점에서 큰 의의를 가진다. ARC는 입력 특징을 일정 길이 T의 토큰 시퀀스로 분할하고, 12‑layer Transformer를 통해 다음 토큰을 예측한다. 이때 “다음 토큰 예측”이라는 언어 모델링 기법을 특징 압축에 그대로 적용함으로써, 압축 비율 r_i 에 따라 f_cmp의 앞부분만 취하면 된다. 즉, r_i 가 작을수록 더 많은 토큰을 사용해 고차원 정보를 보존하고, r_i 가 클수록 토큰 수를 줄여 압축한다.

MoS는 ARC가 생성한 여러 “기본 솔루션”(different stochastic decodings)을 가중 평균하거나 학습된 어텐션으로 결합해 최종 압축 벡터를 만든다. 이는 단일 토큰 시퀀스에 내재된 불확실성을 완화하고, 다양한 압축 비율에서 일관된 품질을 유지한다.

ERGC는 원본 특징 공간에서 정의된 엔티티 간 관계 그래프(노드: 이미지·텍스트 샘플, 엣지: 의미·구조 유사도)를 손실 함수에 정규화 항으로 삽입한다. 압축 과정에서 그래프 라플라시안 L을 최소화함으로써, 압축된 특징이 원본의 토폴로지와 의미적 거리를 보존하도록 강제한다. 이는 특히 멀티모달 교차 검색에서 중요한데, 서로 다른 모달리티 간의 정렬이 유지되기 때문이다.

실험에서는 CLIP 기반 이미지·텍스트 특징을 사용해 MS‑COCO, Flickr30K, ImageNet 등에서 압축 비율 16.7%66.7%까지 테스트했다. Q‑Former, 전통적인 AutoEncoder, PTQ 등과 비교했을 때, ARFC는 평균 1.23.5%의 mAP·Acc 향상을 보였으며, 일부 설정에서는 압축 후에도 원본보다 높은 성능을 기록했다. 특히 “압축 비율이 낮을 때(고압축)에도 MoS와 ERGC가 결합된 결과가 급격히 떨어지는 현상을 억제한다”는 점이 눈에 띈다.

한계점으로는 ARC가 Transformer 기반이므로 메모리·연산 비용이 여전히 존재한다는 점이다. 압축 비율을 낮게 설정하면 토큰 수가 많아져 inference 시간이 증가한다. 또한, 현재는 사전 학습된 CLIP 특징을 그대로 사용하고 있어, 원본 특징 자체가 이미 고차원 압축에 최적화된 경우 추가적인 이득이 제한적일 수 있다. 향후 경량화된 AR 모델이나, 원본 인코더와 공동 학습하는 end‑to‑end 파이프라인이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기