통합 비전 언어 위조 탐지와 위치 추정을 위한 균형 강화학습 프레임워크 OmniVL Guard

초록

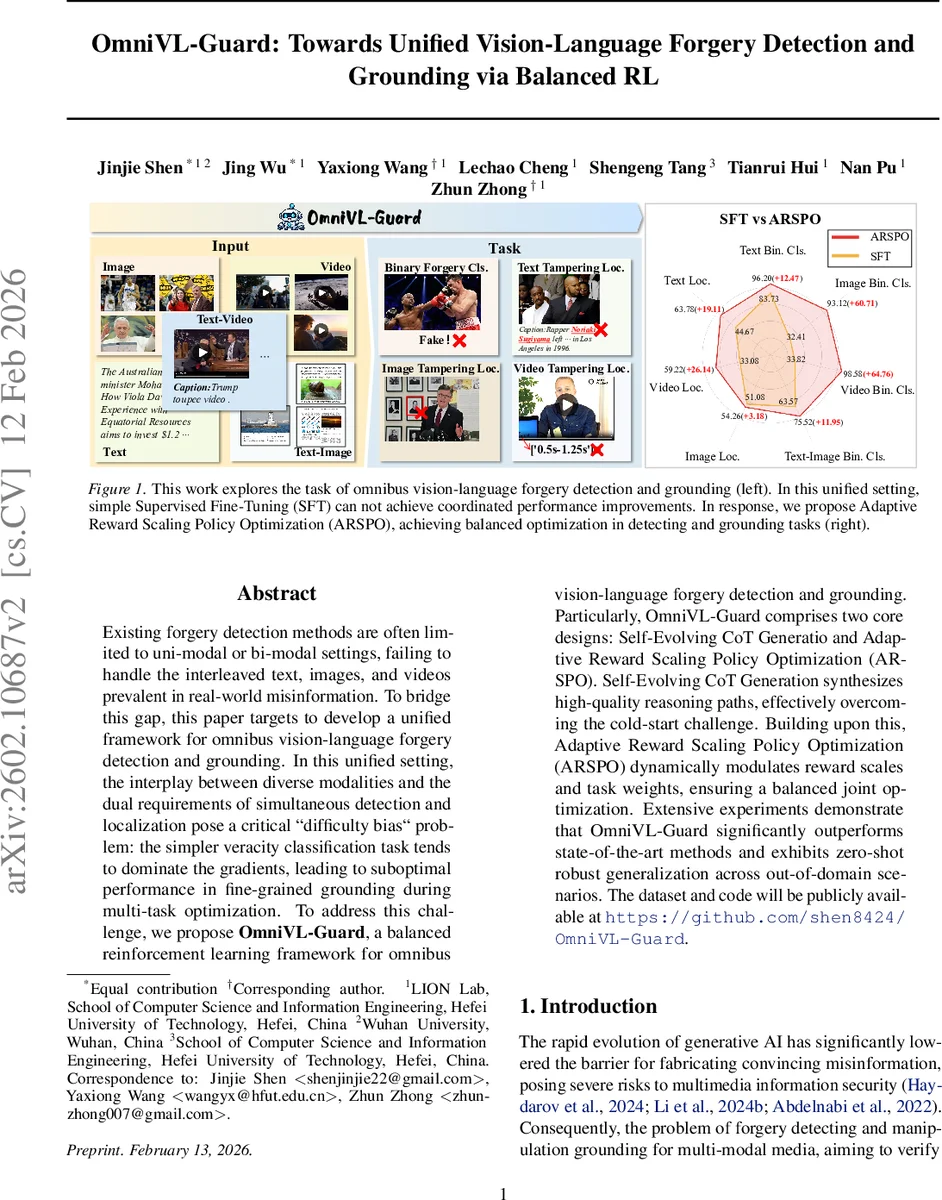

OmniVL‑Guard는 텍스트·이미지·비디오가 혼합된 실세계 허위정보에 대응하기 위해, 위조 여부 판별과 조작 영역 위치 추정을 동시에 수행하는 통합 비전‑언어 모델을 제안한다. 난이도 편향으로 인해 단순 분류 과제가 그래디언트를 장악하는 문제를 해결하고자, 자체 진화형 체인‑오브‑씽크(CoT) 생성과 적응형 보상 스케일링 정책 최적화(ARSPO)를 결합한 균형 강화학습 프레임워크를 설계하였다. 대규모 다중모달 FSFR 데이터셋을 구축하고, 실험을 통해 기존 최첨단 방법들을 크게 능가하며 도메인 외 일반화까지 입증하였다.

상세 분석

OmniVL‑Guard 논문은 현재 위조 탐지 연구가 이미지‑텍스트, 텍스트‑비디오 등 2‑모달에 국한되는 한계를 명확히 지적하고, 실제 SNS 환경에서 텍스트·이미지·비디오가 동시에 존재하는 ‘옴니모달’ 상황을 목표로 한다는 점에서 연구 동기가 설득력을 갖는다. 핵심 기술적 기여는 두 가지이다. 첫째, Self‑Evolving CoT Generation은 초기 CoT 데이터가 부족한 상황에서, 소수의 고품질 시드(CoT)와 다중 에이전트 협업을 통해 점진적으로 데이터 품질을 향상시킨다. 여기서는 Seed‑Priming, Self‑Evolution Loop, Hard‑CoT Synthesis라는 4단계 파이프라인을 제시하며, 각 단계에서 모델 자체와 별도 검증 모델을 활용해 일관성·정확성을 엄격히 필터링한다. 이 과정은 ‘효율성‑편향 딜레마’를 해결하고, RL 단계에서 필요한 풍부한 추론 경로를 제공한다는 점에서 의미가 크다. 둘째, ARSPO(Adaptive Reward Shaping Policy Optimization)는 다중 과제 RL에서 발생하는 난이도 편향을 수학적으로 분석한다. 논문은 기존 GRPO 등 정책 경사식에 보상 함수 fᵢ,ₜ가 어떻게 각 과제의 난이도에 따라 그래디언트 전달 효율을 좌우하는지를 공식화하고, 보상 스케일을 동적으로 조정하는 메커니즘을 도입한다. 구체적으로, 실시간 학습 상태(예: 평균 보상, 변동성)를 기반으로 과제별 가중치를 업데이트함으로써, 쉬운 이진 분류 과제가 복잡한 위치 추정 과제를 압도하지 않도록 균형을 맞춘다. 실험 결과 표 1b에서 보듯이, ARSPO 적용 시 이미지·텍스트·비디오 위치 추정 모두에서 10% 이상의 절대 성능 향상이 관찰되며, 특히 비디오 시간 영역 탐지에서 26%p 상승을 기록한다. 이는 보상 스케일링이 실제로 난이도 편향을 해소한다는 강력한 증거다. 또한, 논문은 FSFR(Full‑Spectrum Forensic Reasoning) 데이터셋을 구축하여, SFT 단계와 RL 단계에 각각 73k와 110k 샘플을 제공한다. 데이터는 텍스트, 이미지, 비디오, 이미지‑텍스트 4가지 모달을 모두 포함하고, 이진 위조 분류와 이미지·텍스트·비디오 각각의 조작 영역 라벨링을 포함한다. 이러한 포괄적 데이터는 모델이 멀티모달 상호작용을 학습하고, 제로샷 OOD 상황에서도 강인한 일반화를 보이게 한다. 전체적으로, 논문은 기존 단일·이중 모달 접근법과 달리 ‘옴니모달’ 위조 탐지를 위한 통합 파이프라인을 제시하고, 난이도 편향을 수학적으로 해소하는 새로운 RL 최적화 전략을 도입함으로써, 멀티모달 포렌식 분야에 중요한 전진을 이룬다.

댓글 및 학술 토론

Loading comments...

의견 남기기