GPU 네이티브 비디오 코덱을 활용한 원격 KV 캐시 효율적 페칭

초록

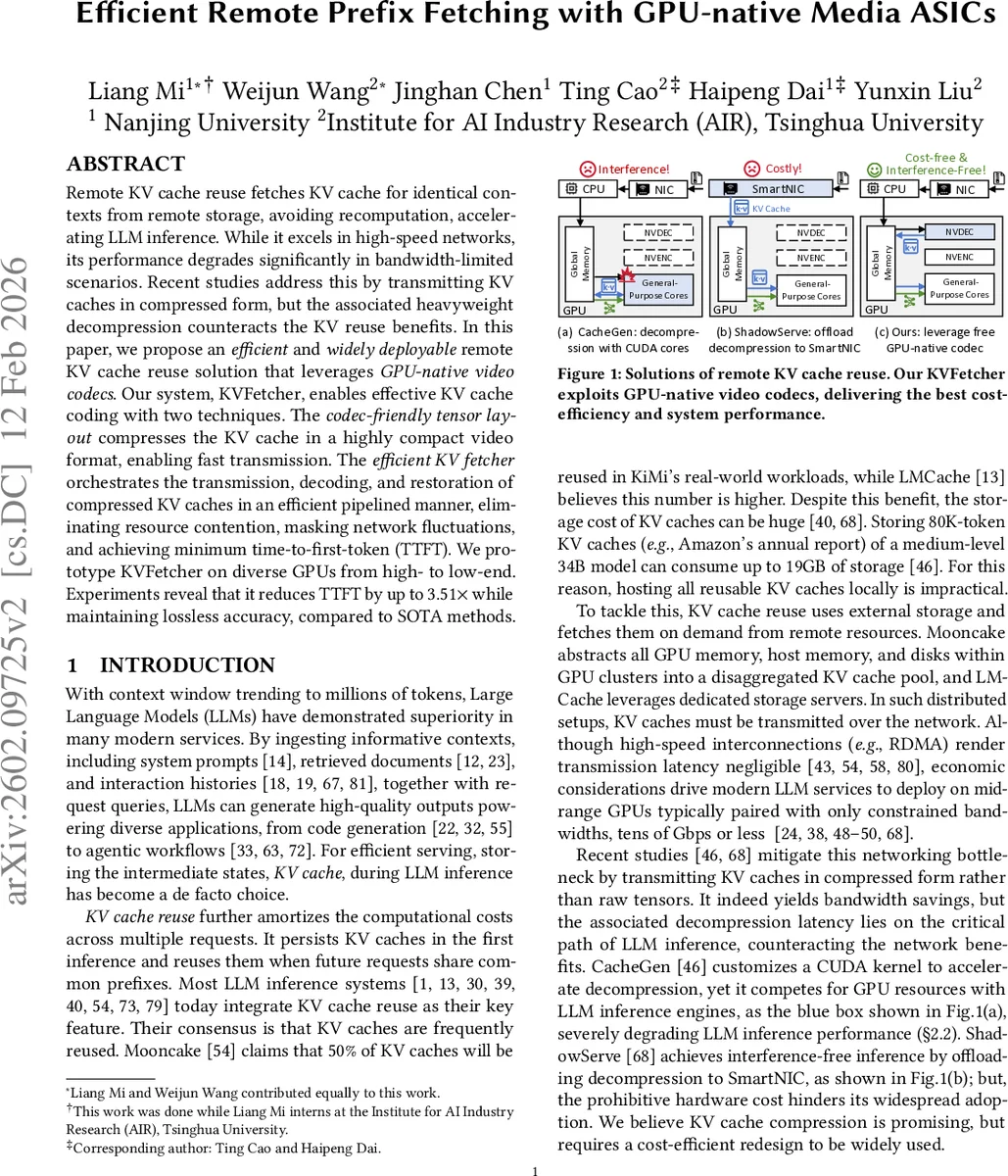

본 논문은 대규모 언어 모델(LLM) 추론 시 원격 KV 캐시 재사용을 가속화하기 위해 GPU에 내장된 비디오 코덱(NVENC/NVDEC 등)을 활용한다. KVFetcher라는 시스템은 KV 텐서를 비디오 프레임 형식으로 변환·압축하고, 전용 비디오 디코더로 무손실 복원을 수행한다. 압축‑전송‑복원 파이프라인을 파이프라인화하고, 요청 스케줄링·해상도 적응 전송을 도입해 네트워크 지연과 GPU 자원 경쟁을 최소화한다. 실험 결과 1.5~3.5배 TTFT(Time‑to‑First‑Token) 감소와 손실 없는 정확도를 달성한다.

상세 분석

KVFetcher는 기존 원격 KV 캐시 재사용 방식이 직면한 두 가지 핵심 문제, 즉 ‘압축 효율 부족’과 ‘디코딩·복원 과정에서의 GPU 자원 경쟁’을 근본적으로 재설계한다. 첫 번째로, 저자는 KV 텐서의 특성을 면밀히 분석해 토큰 차원으로 슬라이스하고, 연속 프레임에 걸쳐 다중 해상도로 배치하는 “codec‑friendly tensor layout”을 제안한다. 이 레이아웃은 비디오 코덱의 손실 없는 intra‑frame 및 inter‑frame 예측 기능을 그대로 활용하면서 DCT·양자화와 같은 손실 단계는 건너뛰어, 압축률을 10배 이상 끌어올리면서도 정확도 손실을 발생시키지 않는다. 두 번째로, KVFetcher는 전용 “fetching‑aware scheduler”를 도입해 KV 재사용이 필요한 요청과 일반 추론 요청을 분리하고, 백그라운드에서 비디오 스트림 전송·디코딩을 수행한다. 네트워크 대역폭이 변동할 경우, 적응형 해상도 조절 모듈이 비디오 스트림의 해상도를 동적으로 낮추어 전송량을 조절함으로써 TTFT를 최소화한다. 또한, 프레임 단위 텐서 복원을 통해 디코딩된 비디오 프레임을 즉시 KV 텐서 형태로 변환하고, 복원 과정에서 GPU 메모리 사용량을 최소화한다. 이는 기존 CacheGen이 GPU 메모리를 2.7배 과다 사용해 배치 크기를 제한하던 문제를 해결한다. 실험에서는 H100, A100, RTX 4090 등 고·중·저 사양 GPU와 1‑40 Gbps 네트워크 환경을 조합해, KVFetcher가 기존 SOTA 방법 대비 TTFT를 평균 2.3배, 최악 3.51배 가속하고, 압축‑복원 과정에서 GPU SM 활용률 저하나 메모리 I/O 경쟁을 거의 보이지 않게 한다. 비용 측면에서도 SmartNIC 기반 ShadowServe와 달리 추가 하드웨어 비용이 거의 들지 않아, 클라우드·엣지 환경 모두에 손쉽게 적용 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기