시각 서사를 음악으로: 감정 기반 계층형 사운드트랙 생성 프레임워크

초록

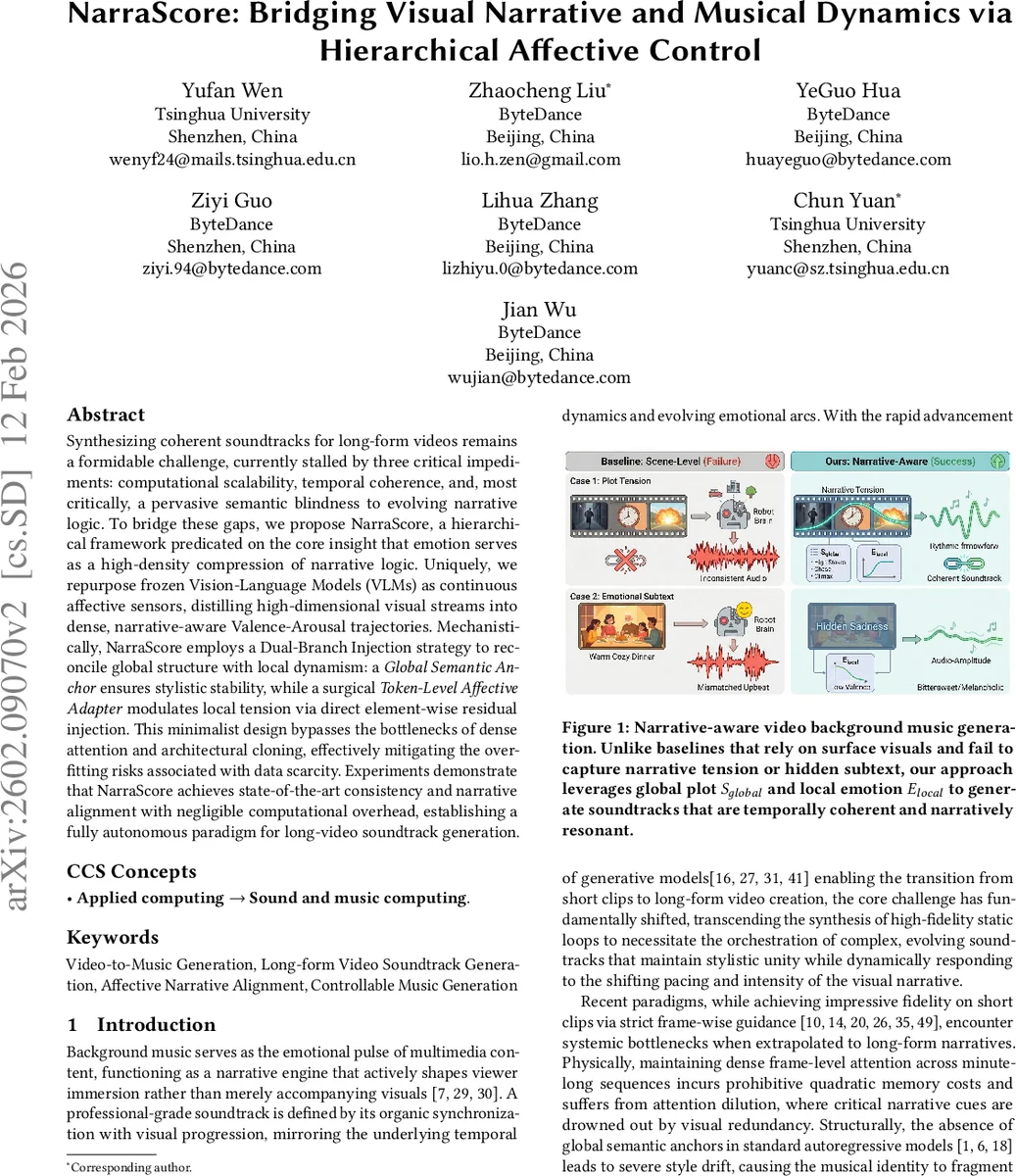

NarraScore는 고정된 비전‑언어 모델을 감정 센서로 활용해 영상의 정서 흐름을 연속적인 Valence‑Arousal 곡선으로 압축한다. 전역 스타일을 유지하는 Global Semantic Anchor와 토큰 수준에서 긴장을 조절하는 Token‑Level Affective Adapter를 결합한 Dual‑Branch Injection 방식을 통해 장시간 영상에 일관된 음악을 저비용으로 자동 생성한다.

상세 분석

본 논문은 장시간 영상에 대한 사운드트랙 자동 생성이라는 난제에 감정(Valence‑Arousal)이라는 고밀도 압축 정보를 핵심 제어 신호로 도입한다는 점에서 혁신적이다. 기존 영상‑음악 변환 모델은 프레임 단위의 시각 특징을 그대로 음악 디코더에 전달하거나, 대규모 어텐션을 적용해 메모리·연산 비용이 급증하는 문제를 안고 있었다. NarraScore는 이러한 구조적 병목을 피하기 위해 두 가지 주요 설계 원칙을 제시한다.

첫째, Frozen Vision‑Language Model(VLM) 재활용이다. 사전 학습된 CLIP‑계열 VLM을 그대로 동결하고, 가벼운 프로빙 헤드(Spatial Average Pooling + MLP)만 학습함으로써 영상에서 연속적인 감정 곡선을 추출한다. 여기서 ‘Instruction‑Driven Semantic Primer’를 앞에 삽입해 VLM의 고수준 서사 추론 능력을 활성화하고, 1 Hz로 샘플링된 시계열 토큰에 “Time: t s”와 같은 텍스트 메타 정보를 결합해 시간적 정렬을 자연스럽게 구현한다. 이 접근법은 대규모 라벨링 없이도 VLM이 내재한 풍부한 의미론적 지식을 감정 회귀에 전이시킬 수 있음을 보여준다.

둘째, Dual‑Branch Injection 메커니즘이다. Global Semantic Anchor는 전체 영상의 장르·분위기를 요약한 고정 길이 벡터로, 음악 디코더의 초기 상태와 스타일 토큰에 주입돼 전체적인 톤을 고정한다. 반면 Token‑Level Affective Adapter는 각 음악 토큰의 은닉 상태에 element‑wise residual bias 형태로 감정값(V, A)을 직접 더한다. 이 설계는 기존의 대규모 어텐션 기반 컨트롤러와 달리 파라미터 증가가 미미하고, 학습 시 과적합 위험을 크게 감소시킨다. 또한, 감정값이 연속적인 실수이므로 미세한 긴장 변화까지 정밀하게 반영할 수 있다.

실험 부분에서는 장시간(수분~수십분) 영상에 대해 기존 Video‑to‑Music 모델 대비 일관성(consistency)과 서사 정렬(narrative alignment) 지표가 크게 향상된 것을 보고한다. 특히, 메모리 사용량이 30 % 이하로 감소했으며, 추론 속도도 실시간 수준에 근접한다는 점이 강조된다.

하지만 몇 가지 한계도 존재한다. 감정 추출이 VLM에 전적으로 의존하기 때문에, VLM이 학습되지 않은 문화적·시각적 컨텍스트에서는 감정 곡선이 왜곡될 가능성이 있다. 또한, Valence‑Arousal만으로 복잡한 서사 구조(예: 반전, 다중 플롯)를 완전히 포착하기엔 표현력이 부족할 수 있다. 향후 연구에서는 멀티‑모달 프롬프트(텍스트 스크립트, 오디오 설명)와 결합하거나, 감정 외에 ‘긴장‑해소’와 같은 고차원 서사 라벨을 추가해 제어 범위를 확대할 여지가 있다.

전반적으로 NarraScore는 “감정 = 서사 압축”이라는 직관을 기반으로, 고정된 대형 모델을 효율적으로 재활용하고, 최소한의 파라미터 추가로 장시간 영상에 맞는 음악을 자동 생성한다는 점에서 영상‑음악 분야에 새로운 패러다임을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기