시각적 영감 씨앗: 텍스트 없이 이미지 간 비유적 결합을 학습하는 새로운 생성 프레임워크

초록

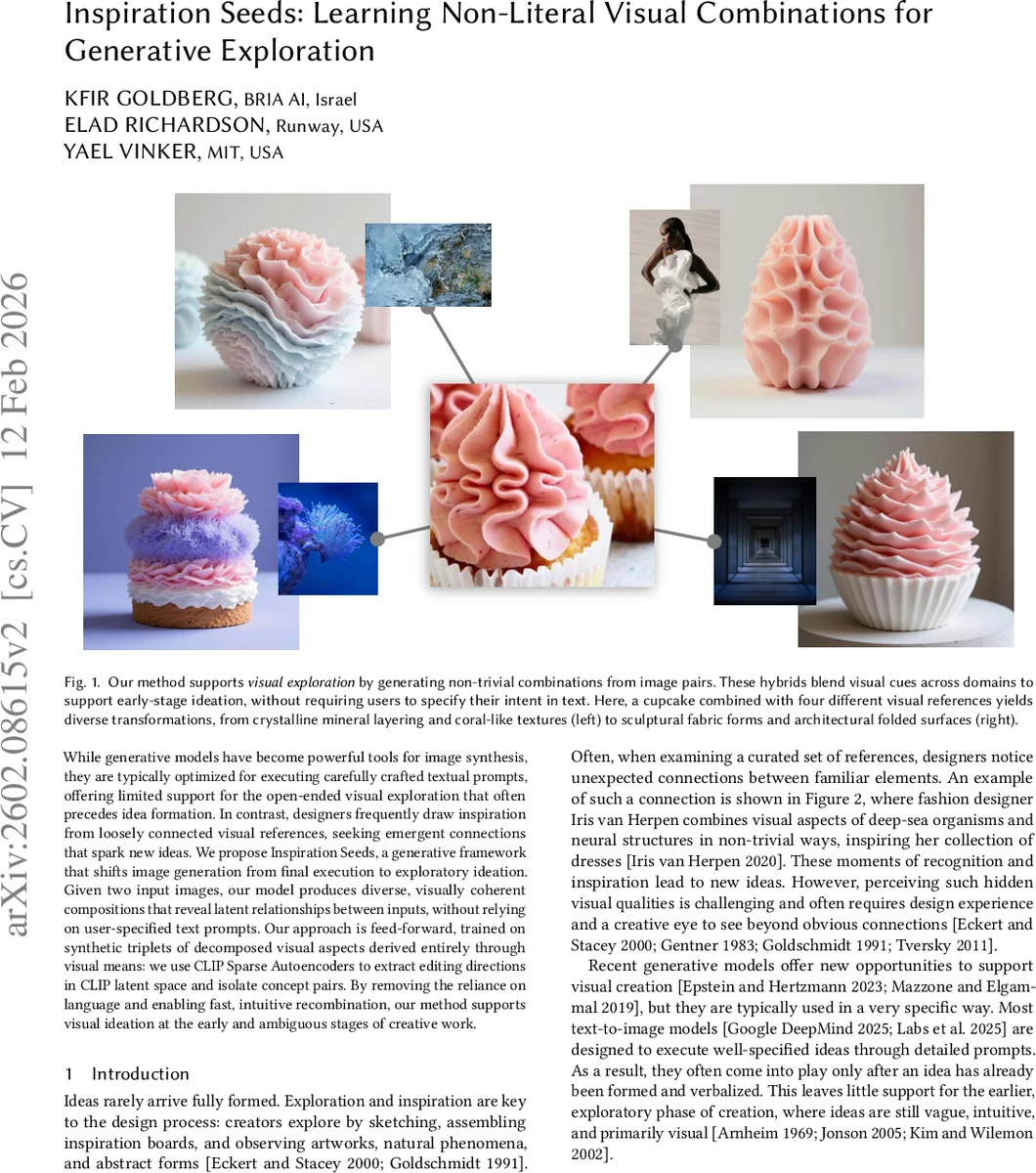

본 논문은 두 장의 입력 이미지를 받아 텍스트 프롬프트 없이도 다양한 비문자적(비직관적) 시각적 조합을 자동으로 생성하는 “Inspiration Seeds” 모델을 제안한다. CLIP Sparse Autoencoder을 활용해 이미지 내부의 시각적 요소를 자동 분해하고, 이를 기반으로 합성 이미지 쌍을 만들기 위한 대규모 합성 데이터셋을 구축한다. 학습된 Flux.1 Kontext 기반 이미지‑투‑이미지 변환기는 무작위 시드에 따라 서로 다른 창의적 연결을 제시함으로써 초기 아이디어 발상 단계에서 디자이너의 시각적 탐색을 지원한다.

상세 분석

Inspiration Seeds는 기존 텍스트‑투‑이미지 모델이 “명확히 정의된 프롬프트”에 의존하는 한계를 극복하고, 순수 시각적 입력만으로 비문자적 연관성을 탐색하도록 설계되었다. 핵심 기술은 CLIP Sparse Autoencoder(SAE)를 이용한 시각적 요소 추출 및 클러스터링이다. 이미지 I₍com₎를 CLIP 인코더에 통과시킨 뒤, SAE 인코더 W_enc를 통해 고차원 활성화 a를 희소 표현 h로 변환한다. 상위 k(보통 2) 활성값을 원‑핫 형태로 선택하고, 이를 W_dec으로 복원해 CLIP 공간의 벡터 집합을 얻는다. 이 벡터들을 k‑means( k=2 )로 두 그룹으로 나누어 각 군집의 중심을 C_A, C_B 로 정의하고, 편집 방향 v_{A→B}=C_B−C_A 를 계산한다. 원본 CLIP 임베딩 e_com을 v_{A→B} 방향으로 양·음으로 이동시켜 두 개의 변형 임베딩을 만든 뒤, Flux.1 Kontext 디퓨전 모델에 입력하면 두 개의 시각적 측면 강조 이미지 I_A, I_B 가 생성된다. 이렇게 얻어진 (I_A, I_B, I_com) 삼중항은 “입력 이미지 → 비문자적 조합” 학습을 위한 자연스러운 라벨 역할을 한다.

데이터 구축 단계에서는 두 가지 전략을 사용한다. 첫째, 다중 속성 프롬프트(예: “금속 질감의 파란 구체가 흐르는 물 위에 떠 있다”)를 통해 복합 시각 정보를 가진 이미지를 대량 생성한다. 둘째, 모호한 프롬프트를 LLM이 다중 구체화하도록 하여 다양한 해석을 얻고, 이를 이미지 생성 모델에 전달해 풍부한 시각적 변형을 만든다. 이렇게 확보한 이미지 풀은 SAE 기반 분해 파이프라인에 투입되어 수백만 개의 학습 삼중항을 자동 생성한다.

학습은 Flux.1 Kontext를 이미지‑투‑이미지 변환기로 미세조정하는 방식이다. 입력 (I_A, I_B) 를 결합한 프롬프트 토큰 시퀀스로 변환하고, 목표 출력은 원본 I_com이다. 손실 함수는 L2 재구성 손실과 CLIP 임베딩 정합성을 동시에 최소화하도록 설계돼, 생성된 이미지가 원본과 시각적 의미에서 일관성을 유지하면서도 비문자적 연결을 드러내도록 한다.

실험에서는 (1) 시각적 다양성(다양한 랜덤 시드에 따른 출력 차이), (2) 비문자적 연관성(인간 평가를 통한 “숨겨진 관계 발견” 점수), (3) 텍스트 기반 모델 대비 비트리비얼성(Nano Banana 등과 비교) 등을 측정했다. 제안 모델은 기존 텍스트‑기반 편집 모델이 주로 “객체 교체”와 같은 직관적 변형에 머무는 반면, 텍스처, 색조, 형태·구조적 패턴을 교차 전이시켜 새로운 시각적 메타포를 생성한다는 점에서 우수성을 보였다. 또한, Description‑Complexity Metric을 도입해 생성 결과의 서술적 복잡성을 정량화했으며, 이는 인간이 느끼는 “놀라움”과 높은 상관관계를 나타냈다.

한계점으로는 (a) SAE가 추출하는 특징이 완전히 의미론적으로 독립적이지 않을 수 있어, 일부 경우 과도한 혼합이 발생한다; (b) 현재는 두 이미지만을 입력으로 제한해 다중‑이미지 조합 확장에 추가 연구가 필요하다; (c) 생성된 이미지의 품질은 기본 Flux.1 Kontext의 해상도·디테일에 의존한다는 점이다. 향후 연구에서는 다중 단계 클러스터링, 멀티‑모달 피드백 루프, 그리고 사용자‑인-루프를 통한 인터랙티브 탐색을 도입해 보다 정교한 영감 도구로 발전시킬 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기