지역과 전역 정보를 결합한 오픈보카블리 이미지 분할

초록

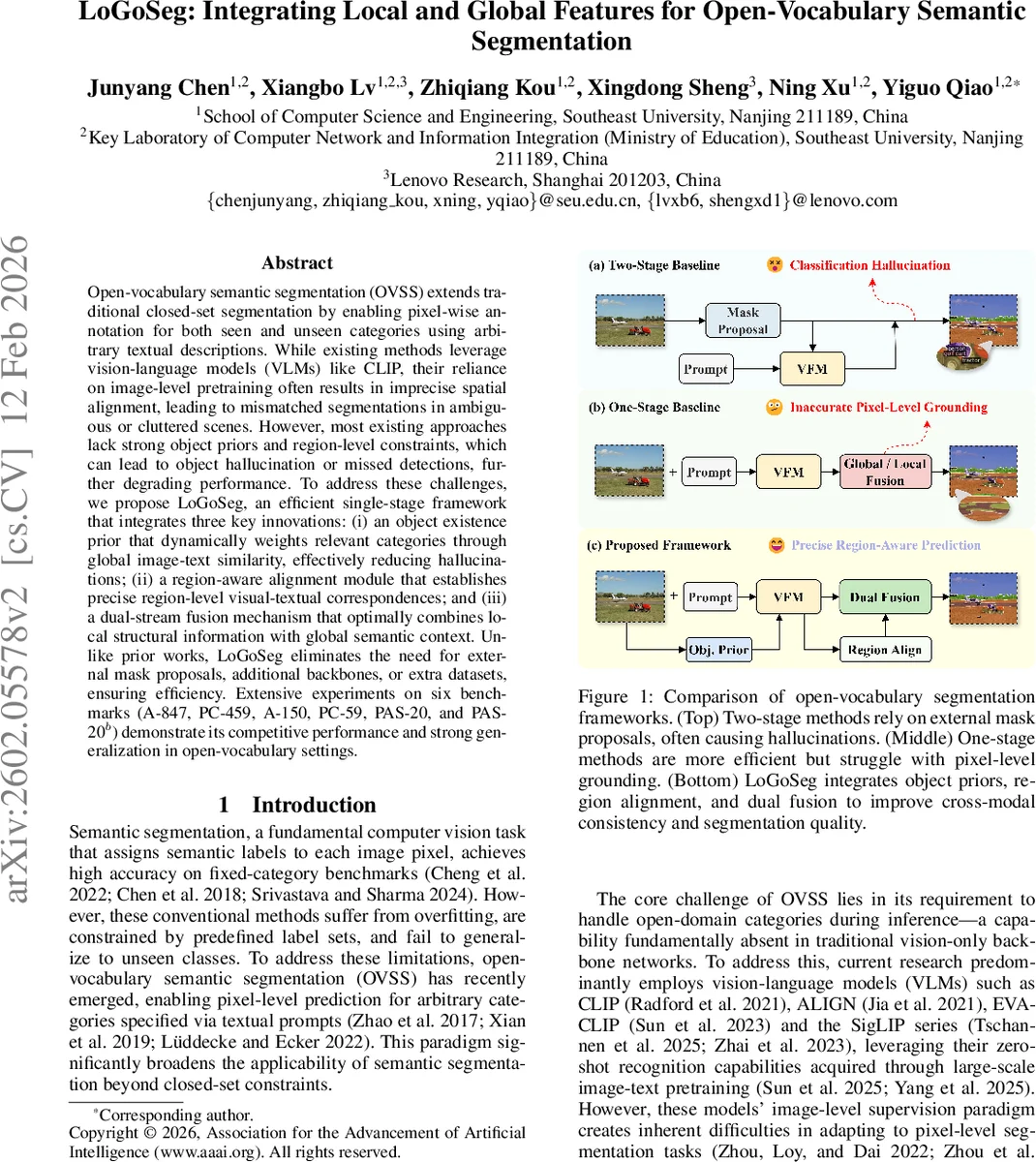

LoGoSeg은 이미지‑텍스트 사전학습 모델인 CLIP을 기반으로, 전역 이미지‑텍스트 유사도로 객체 존재 가능성을 추정하고, 영역 수준의 시각‑언어 정렬을 수행한다. 지역‑전역 이중 스트림 융합을 통해 로컬 구조와 글로벌 의미를 동시에 활용함으로써, 기존 단일 단계 방법들의 공간 정밀도 부족과 클래스 환각 문제를 크게 완화한다. 외부 마스크 제안기나 추가 백본 없이도 6개 벤치마크에서 최신 성능을 달성한다.

상세 분석

LoGoSeg은 오픈보카블리 세그멘테이션(OVSS)에서 가장 흔히 발생하는 두 가지 문제, 즉 이미지‑텍스트 사전학습 모델의 이미지‑레벨 정합성 부족으로 인한 픽셀‑레벨 정렬 오류와 객체 존재 여부에 대한 사전 정보 부재로 인한 클래스 환각을 동시에 해결한다. 첫 번째 핵심은 **객체 존재 사전(object existence prior)**이다. CLIP 이미지 피처와 텍스트 프롬프트의 평균 임베딩 사이의 코사인 유사도를 전역 스코어로 계산하고, 이를 λ 스케일링하여 각 클래스에 대한 존재 확률을 추정한다. 이 확률은 텍스트 임베딩을 가중 평균하는 데 사용되어, 실제 이미지에 존재하지 않는 클래스의 텍스트 표현을 억제한다. 결과적으로 불필요한 클래스가 활성화되는 현상을 크게 감소시킨다.

두 번째 핵심은 지역‑인식 정렬(region‑aware alignment) 모듈이다. 이미지 피처 맵을 K개의 비중첩 영역으로 나누고, 각 영역의 평균 피처(v_k)를 구한다. 가중 텍스트 중심 ˆ T_n과의 코사인 유사도 A_{k,n}을 기반으로 온도 파라미터 τ를 적용한 softmax를 통해 영역‑클래스 가중치 w_{k,n}을 얻는다. 이를 통해 각 클래스별 시각적 프로토타입 m_n을 영역 가중합으로 생성하고, 시각‑텍스트 결합 가이드 g_region

댓글 및 학술 토론

Loading comments...

의견 남기기