메모리 기반 강화학습으로 스스로 진화하는 에이전트 MemRL

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

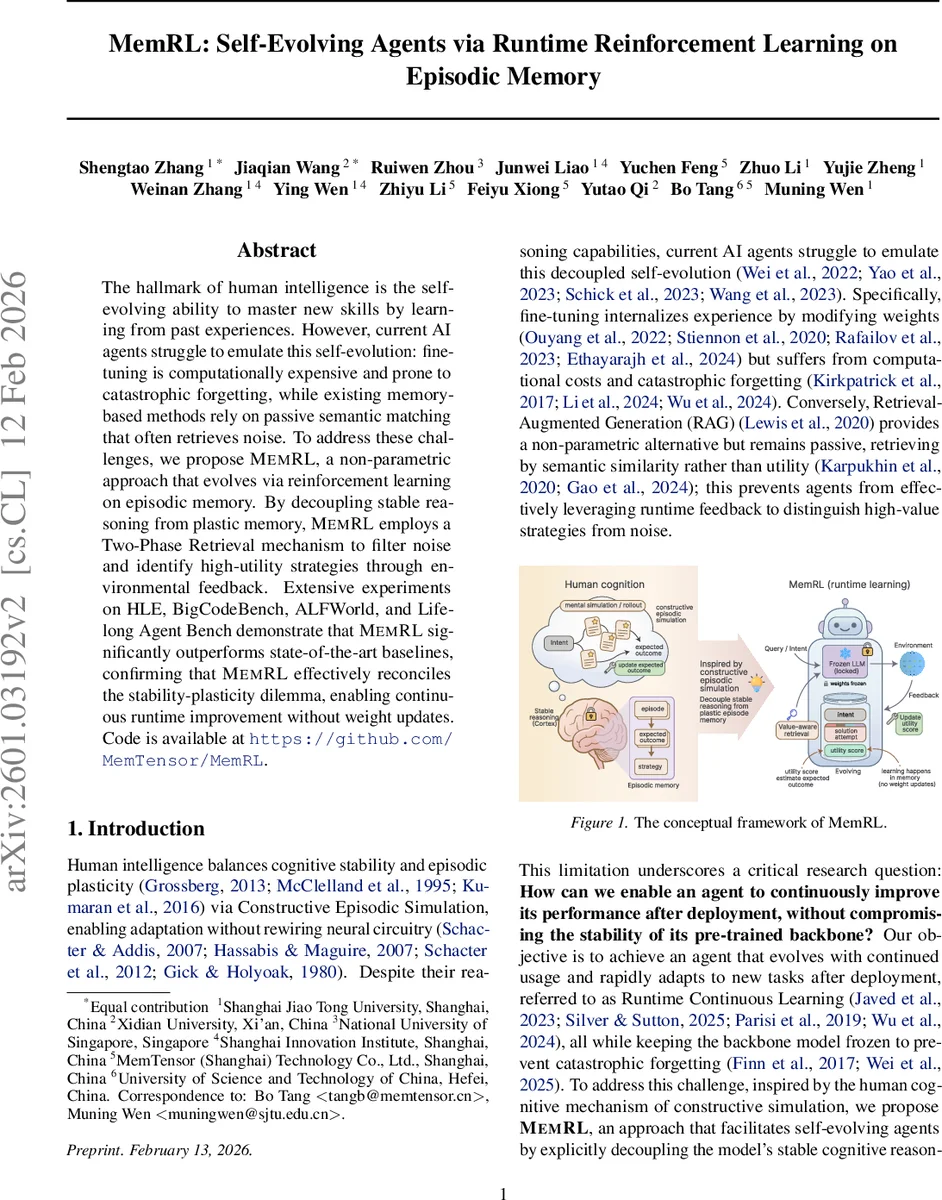

MemRL은 사전 학습된 대형 언어 모델(LLM)을 고정한 채, 에피소드 메모리를 비파라미터 방식으로 강화학습(Q‑learning)하여 검색 정책을 지속적으로 개선한다. 두 단계(유사도 기반 후보 추출 → 유틸리티 기반 재선택)로 노이즈를 걸러내고, 환경 보상으로 Q값을 업데이트함으로써 파라미터 업데이트 없이도 런타임에서 성능이 향상된다. HLE, BigCodeBench, ALFWorld, Lifelong Agent Bench 등 네 가지 벤치마크에서 기존 RAG·파라미터 기반 방법보다 유의미하게 앞선다.

상세 분석

MemRL은 “안정성‑가소성 딜레마”를 해결하기 위해 모델‑메모리 분리라는 설계 철학을 채택한다. 핵심 아이디어는 LLM 자체는 변하지 않게 두고, 외부 메모리를 Intent‑Experience‑Utility(I‑E‑U) 삼중항 형태로 구조화한다는 점이다. 여기서 Intent는 현재 사용자 질의(또는 목표)와 매핑되는 임베딩, Experience는 과거 성공·실패 사례(텍스트·행동 트레이스), Utility는 해당 경험이 현재 Intent에 기여할 기대 보상을 나타내는 Q‑value이다.

-

두 단계 검색(Two‑Phase Retrieval)

- Phase A에서는 임베딩 유사도 기반으로 상위 k₁개의 후보를 빠르게 추출한다. 이는 기존 RAG와 동일하게 고속 검색을 보장한다.

- Phase B에서는 후보 각각에 대해 현재 학습된 Q값을 결합한 복합 점수 ( (1‑λ)·\hat{sim}+λ·\hat{Q} ) 로 재정렬한다. λ는 탐색‑활용 균형을 조절하는 하이퍼파라미터이며, 정규화된 Q값이 높은 경험을 우선 선택함으로써 “의미가 비슷하지만 쓸모 없는” 노이즈를 효과적으로 배제한다.

-

비파라미터 강화학습

- 메모리 내 Q값은 TD 오차 혹은 Monte‑Carlo 방식으로 환경 보상 r을 받아 업데이트된다.

- 업데이트 식 ( Q←Q+α

댓글 및 학술 토론

Loading comments...

의견 남기기