스마트 안경용 음성 라이브니스 검증 및 인증 벤치마크

초록

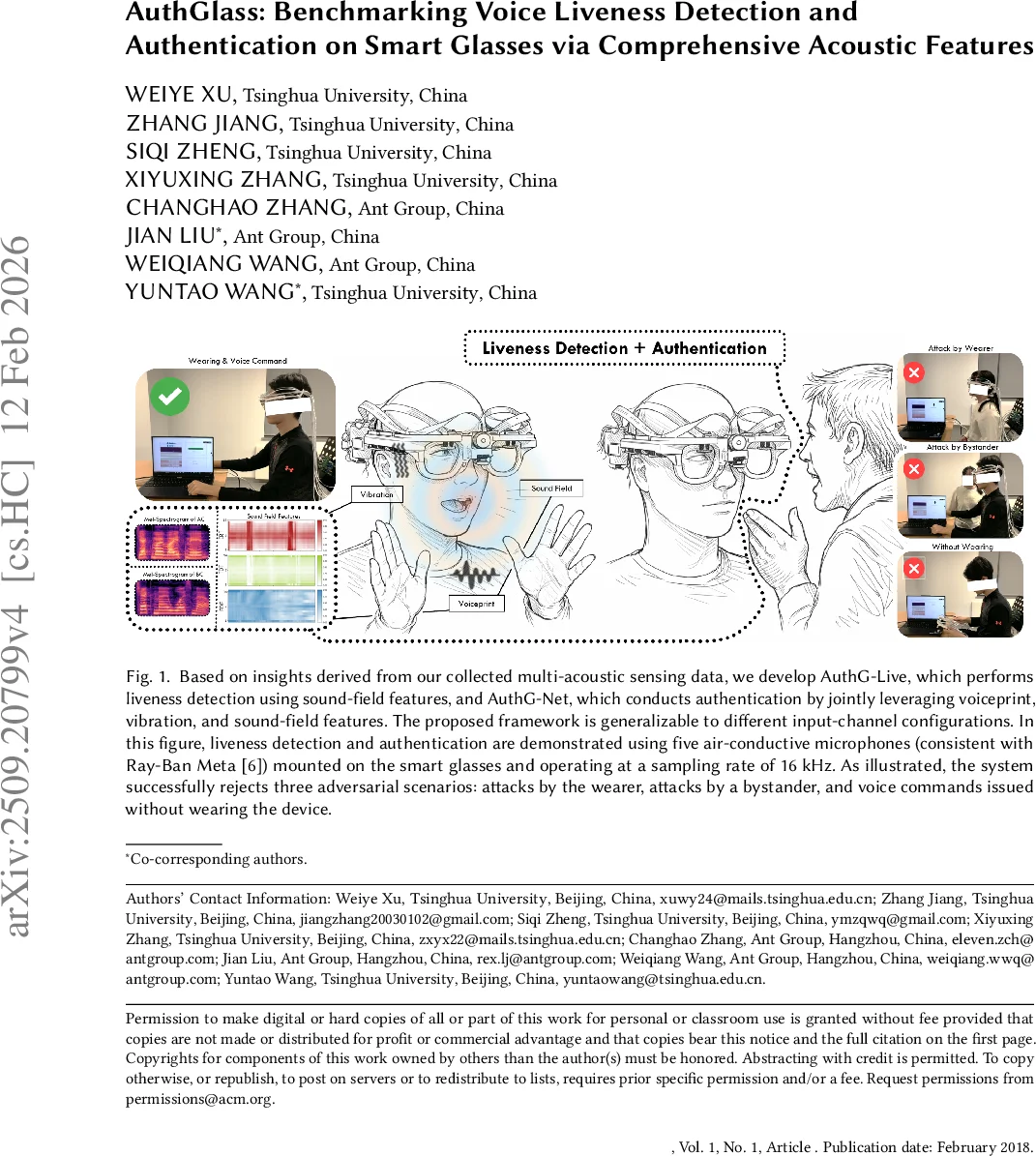

본 논문은 스마트 안경에 탑재된 16채널 마이크 어레이를 활용해 음성 라이브니스 검증과 사용자 인증을 위한 공개 데이터셋(AuthGlass)을 구축하고, 사운드 필드 기반 라이브니스 검증 모델(AuthG‑Live)과 다중 음향 모달리티를 결합한 인증 모델(AuthG‑Net)을 제안한다. 7개의 라이브니스 검증 기법과 4개의 인증 기법을 다양한 채널 조합에서 벤치마크한 결과, 제안 모델이 96% 이상의 라이브니스 정확도와 97% 이상의 인증 정확도를 달성함을 보인다. 데이터와 하드웨어 설계는 모두 오픈소스로 제공되어 스마트 안경 보안 연구의 기반을 마련한다.

상세 분석

AuthGlass 프로젝트는 스마트 안경이라는 특수 폼팩터에서 발생하는 음향 특성을 정량화하고, 이를 보안 서비스에 직접 적용하려는 최초 시도라 할 수 있다. 16채널(공기 전도 8채널 + 골전도 8채널) 마이크 어레이를 96 kHz로 동기화 수집함으로써, 기존 스마트폰·이어폰 데이터셋이 제공하지 못하는 공간적 위상 차이와 채널별 에너지 분포를 확보한다. 42명의 피험자에게 6가지 볼륨 레벨로 15개 명령어를 녹음하고, 두 종류(재생 공격, 합성 공격)의 스푸핑 데이터를 포함해 총 12,600개 이상의 샘플을 구축하였다.

제안된 AuthG‑Live는 사운드 필드(feature) 즉, 각 마이크 간의 시간‑지연(TDOA)과 공간적 스펙트럼을 추출해 딥러닝 기반 이진 분류기에 입력한다. 이 접근법은 기존 음성 기반 라이브니스 검증이 주로 음성 내용 자체(스펙트로그램, MFCC)만을 이용하는 것과 달리, 사용자가 안경을 착용했는지 여부를 물리적 음향 전파 패턴으로 판단한다는 점에서 차별화된다. 실험 결과, 5채널(상업용 안경과 동일한 배치) 구성에서도 94% 이상의 정확도를 유지했으며, 채널 수가 감소해도 성능 저하가 완만했다.

AuthG‑Net은 음성 프린트(공기 전도 스펙트로그램), 골전도 신호, 그리고 사운드 필드 정보를 각각 별도의 서브네트워크로 처리한 뒤, 고차원 임베딩을 결합해 최종 인증 점수를 산출한다. 특히 골전도 채널은 사용자의 턱·입 움직임을 직접 포착해 재생 공격에 대한 강인성을 크게 향상시킨다. 4가지 인증 시나리오(동일 발화, 다른 발화, 다른 볼륨, 다른 환경)에서 평균 97.3%의 정확도를 기록했으며, 기존 ASVspoof 기반 모델 대비 EER이 1.2%p 낮았다.

벤치마크에서는 기존 공개된 ASV·VoxCeleb·RedDots 데이터셋을 그대로 적용했을 때 발생하는 채널 불일치 문제를 지적하고, AuthGlass가 제공하는 멀티모달·멀티채널 환경이 실제 스마트 안경에 최적화된 평가를 가능하게 함을 입증한다. 또한, 제한된 채널(예: 2~4채널)에서도 성능이 크게 저하되지 않도록 설계된 점은 상업용 제품에 바로 적용 가능함을 시사한다.

마지막으로, 데이터와 하드웨어 설계가 모두 오픈소스로 제공됨에 따라, 연구자들은 동일한 캡처 파이프라인을 재현하거나, 추가적인 공격 시나리오(예: 초음파 주입, 전자기 방해)를 손쉽게 확장할 수 있다. 이는 스마트 안경 보안 분야의 표준화와 지속적인 발전을 촉진할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기