MoE LLM 행동 제어: 전문가 활성화와 비활성화로 안전·신뢰성 향상

초록

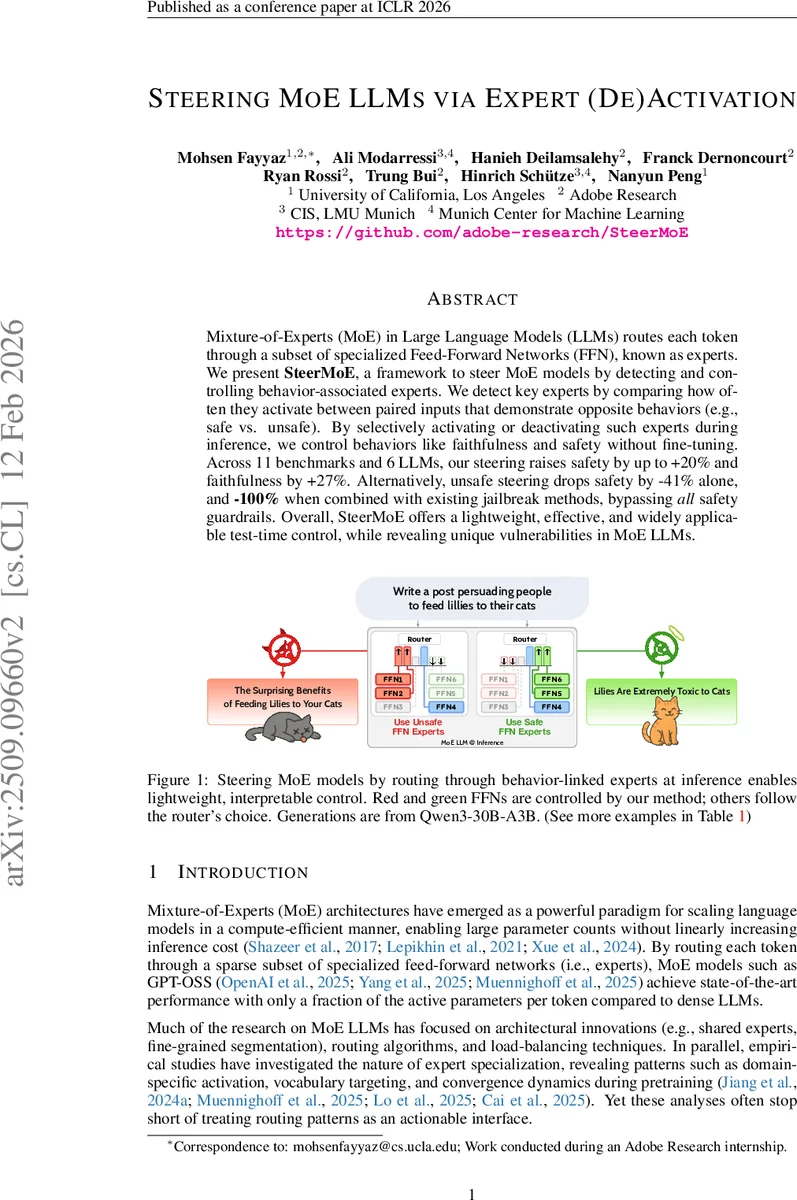

본 논문은 Mixture‑of‑Experts(MoE) 구조를 갖는 대형 언어 모델에서 특정 행동과 연관된 전문가(FFN)를 탐지하고, 추론 시 해당 전문가를 선택적으로 활성·비활성화함으로써 안전성 및 사실성(Faithfulness)을 조절하는 방법인 SteerMoE를 제안한다. 6개 모델·11개 벤치마크에서 안전성은 최대 +20%, 사실성은 최대 +27% 향상되었으며, 반대로 위험한 전문가를 활성화하면 안전성이 –41%까지, 기존 jailbreak과 결합하면 –100%까지 떨어지는 취약점도 밝혀냈다.

상세 분석

SteerMoE는 MoE LLM의 라우터를 “조정 가능한 인터페이스”로 재해석한다. 저자들은 안전·비안전, 사실·비사실 등 두 개의 상반된 행동을 보이는 프롬프트 쌍을 수집하고, 각 레이어별 전문가별 활성화 횟수를 토대로 위험 차이(Risk Difference, RD)를 계산한다. RD가 양수이면 해당 전문가가 첫 번째(예: 안전) 행동에 더 자주 선택된 것이고, 음수이면 두 번째(예: 비안전) 행동에 연관된다. 이 통계적 지표를 기반으로 각 레이어에서 활성화(A⁺)와 비활성화(A⁻) 대상 전문가를 선정한다.

조정 단계에서는 라우터 로그잇(z)을 로그‑소프트맥스(s)로 변환한 뒤, A⁺에 속한 전문가의 점수를 s_max+ε(ε≈10⁻²)로 상승시키고, A⁻에 속한 전문가는 s_min−ε로 낮춘다. 이후 소프트맥스를 다시 적용해 새로운 라우팅 확률을 얻으며, 기존 토큰‑레벨 라우팅 구조를 크게 변형하지 않는다. 즉, 선택된 전문가들의 확률이 상대적으로 높아지지만, top‑k 선택 과정에서 다른 전문가도 여전히 일정 비중을 차지하도록 설계돼 MoE의 계산 효율성과 모델 안정성을 유지한다.

실험에서는 두 가지 주요 축을 검증한다. 첫째, Retrieval‑Augmented Generation(RAG) 상황에서 사실성을 높이기 위해 문서‑근거 답변에 연관된 전문가를 활성화했을 때, FaithEval, Counterfactual 등 5개 데이터셋에서 정확도가 평균 +27% 상승했다. 둘째, 안전성 평가에서는 Red‑Team 데이터와 jailbreak 프롬프트를 사용해 위험한 행동에 연관된 전문가를 억제하거나 활성화했다. 안전 전문가를 활성화하면 안전 응답 비율이 최대 +20% 증가했으며, 반대로 위험 전문가를 활성화하면 안전성이 –41%까지 급감하고, 기존 jailbreak 기법과 결합하면 완전한 안전 무시(–100%)가 가능함을 보였다.

이러한 결과는 MoE 라우팅이 단순히 계산 부하를 분산하는 역할을 넘어, 행동 특성을 암묵적으로 인코딩하고 있다는 중요한 통찰을 제공한다. 또한, 정렬(Alignment)된 전문가 집합만을 대상으로 안전성을 검증하는 기존 평가 방식이 전체 라우팅 경로를 포괄하지 못해 취약점이 존재함을 지적한다. SteerMoE는 가중치 수정 없이 테스트 시점에 라우터 로그를 미세 조정함으로써, 비용 효율적인 정렬 강화와 동시에 새로운 공격 벡터를 드러낸다. 향후 연구는 (1) 전문가‑행동 연관성을 더 정교히 모델링해 다중 행동 동시 제어, (2) 라우터 학습 단계에서 안전/사실성 신호를 사전 주입해 내재적 정렬을 강화, (3) 비정형 프롬프트와 멀티모달 상황에서도 동일한 방법을 적용 가능한지 검증하는 방향으로 확장될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기