확산 증류 일반화 이해를 위한 확률 흐름 거리

초록

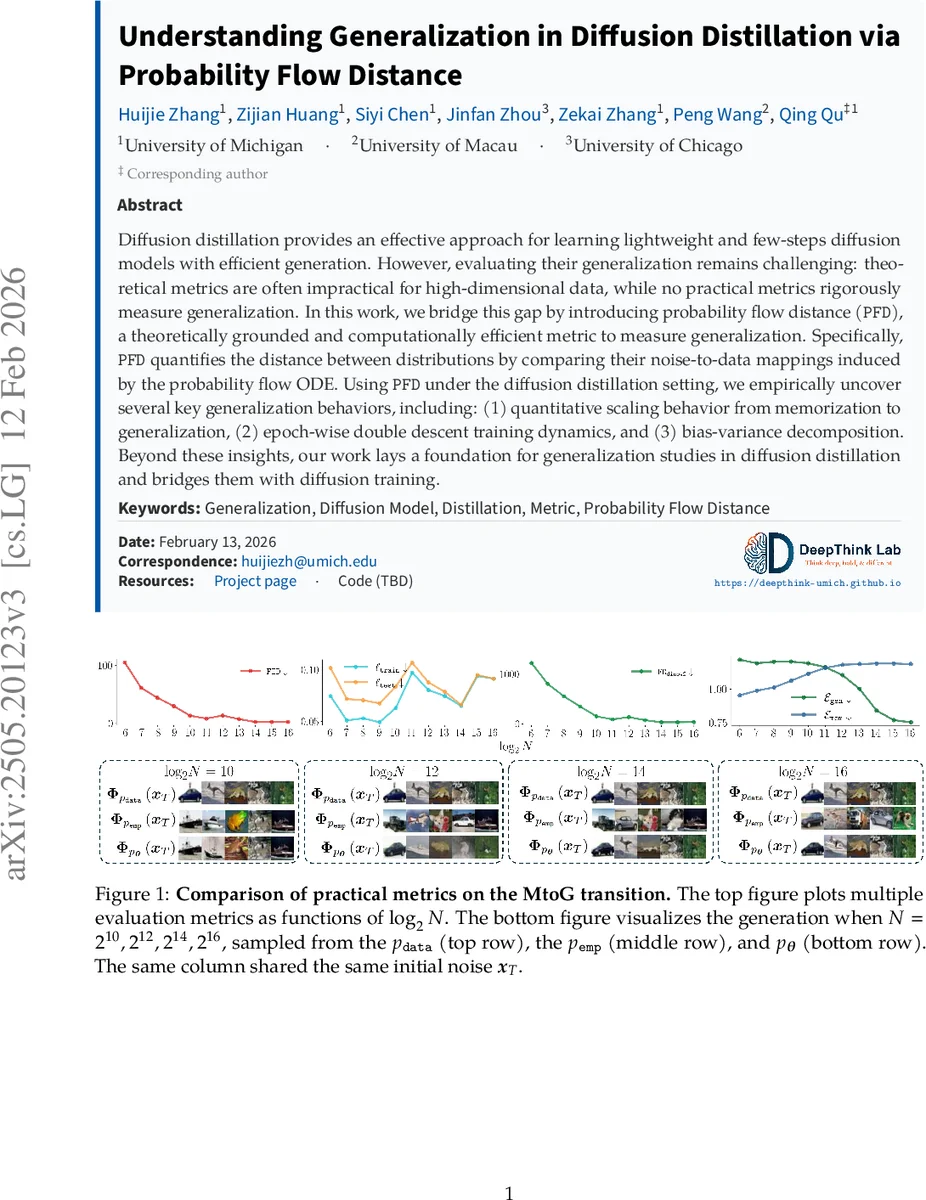

본 논문은 확산 증류 모델의 일반화 능력을 정량적으로 평가하기 위해 확률 흐름 거리(PFD)라는 새로운 메트릭을 제안한다. PFD는 확률 흐름 ODE가 정의하는 노이즈‑투‑데이터 매핑을 비교함으로써 두 분포 간 거리를 측정하며, 이론적 타당성과 샘플 기반 추정 효율성을 동시에 갖는다. 실험을 통해 PFD가 기억에서 일반화로의 스케일링, epoch‑wise double descent 학습 역학, 그리고 편향‑분산 트레이드오프 등 핵심 일반화 현상을 드러냄을 보인다.

상세 분석

확률 흐름 거리(PFD)는 확산 모델에서 사용되는 확률 흐름 ODE(PF‑ODE)의 역방향 매핑 ϕₚ를 활용한다. 두 분포 p와 q에 대해 동일한 고차원 가우시안 노이즈 x_T를 입력으로 하여 ϕₚ(x_T)와 ϕ_q(x_T)를 얻고, 이들의 차이를 이미지 디스크립터 ψ(·)를 통해 L2 norm으로 평균화한다. 정의상 PFD는 거리 공리(양성, 동일성, 대칭, 삼각 부등식)를 만족함을 정리 1에서 증명하고, Lipschitz 연속성과 점근적 근접성을 가정한 정리 2를 통해 샘플 수 M이 충분히 클 때 경험적 추정 ˆPFD가 실제 PFD에 수렴함을 보인다. 기존의 KL, TV와 같은 밀도 기반 거리와 달리 PFD는 샘플 기반으로 계산 가능하면서도 ODE의 구조적 특성을 이용해 고차원 이미지 공간에서도 효율적으로 추정된다.

실험에서는 (1) 데이터 양 N과 모델 파라미터 |θ|의 비율 N/|θ|가 일정할 때 PFD가 일정한 스케일링 법칙을 보이며, 이는 기억 단계에서 일반화 단계로 전이하는 양상을 정량화한다. (2) 충분한 데이터 상황에서는 학습 초기에 일반화 오차가 감소했다가 증가했다가 다시 감소하는 epoch‑wise double descent 현상이 관찰되었으며, 이는 과잉 파라미터화된 지도 학습에서 보고된 현상과 유사하지만 확산 증류 특유의 노이즈‑투‑데이터 매핑을 통해 처음으로 실증되었다. (3) 편향‑분산 분해를 PFD에 적용하면 모델 용량이 커질수록 편향은 감소하고 분산은 증가하는 전형적인 U‑shape 일반화 곡선을 얻는다. 이러한 분석은 기존 메트릭이 포착하지 못했던 기억‑일반화 구분, 학습 역학의 복합적 변곡점, 그리고 통계적 편향‑분산 트레이드오프를 명확히 드러낸다.

또한, PFD는 이미지 디스크립터 ψ를 SSCD나 DINOv2와 같은 사전 학습된 비전 모델으로 교체해도 일관된 결과를 보이며, 실험적 Ablation에서 ψ를 단순 아이덴티티로 설정해도 이론적 특성이 유지됨을 확인했다. 계산 복잡도 측면에서는 M개의 샘플에 대해 O(M·T) 정도의 ODE 통합 비용만 필요해, 고해상도 이미지와 대규모 데이터셋에서도 실용적으로 적용 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기