그래프 신경망으로 시뮬레이션 신경 집합의 구조와 기능 해석

초록

**

본 연구는 메시지‑패싱 그래프 신경망(GNN)을 이용해 수천 개 뉴런으로 구성된 시뮬레이션 신경 집합의 활동 데이터를 입력으로, 연결 행렬, 뉴런 유형, 시그널 전송 함수 및 숨겨진 외부 자극까지 자동으로 복원한다. 기존 RNN·Transformer 기반 예측 모델이 정확도에만 초점을 맞추는 반면, 제안 방법은 높은 예측 성능과 동시에 해석 가능한 메커니즘을 제공한다.

**

상세 분석

**

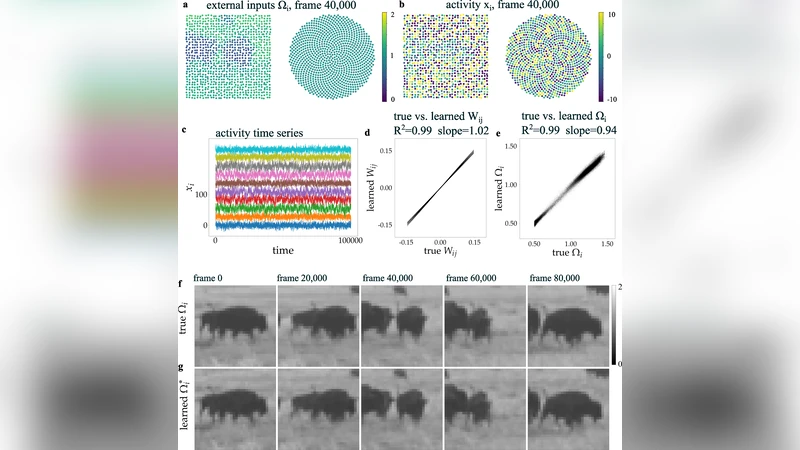

이 논문은 복잡한 이질적 동역학 시스템을 그래프 형태로 표현하고, 메시지‑패싱 GNN을 통해 각 노드(뉴런)의 상태 업데이트 규칙과 엣지(시냅스) 가중치를 동시에 학습한다는 점에서 혁신적이다. 시뮬레이션 모델은 (\dot{x}i = -x_i/\tau_i + s_i\tanh(x_i) + g_i\Omega_i(t)\sum_j W{ij}\psi_{ij}(x_j) + \eta_i(t)) 형태의 비선형 미분 방정식으로 정의되었으며, 여기서 (\tau_i, s_i, g_i)는 뉴런 고유 파라미터, (W_{ij})는 연결 강도, (\psi_{ij})는 전송 함수, (\Omega_i(t))는 외부 입력 스케일링을 나타낸다. 저자들은 이 복합식을 그대로 GNN의 학습 목표로 설정하고, ϕ*와 ψ*를 각각 3‑layer MLP(ReLU, hidden = 64)와 5‑layer 좌표 기반 MLP(입력 = 3, hidden = 128)로 파라미터화하였다.

핵심 아이디어는 각 뉴런마다 2‑차원 잠재 벡터 (a_i)를 부여해 뉴런 유형을 암묵적으로 표현하고, 이를 ϕ*와 ψ*의 입력으로 활용함으로써 이질성을 모델 내부에 자연스럽게 통합한다는 것이다. 손실 함수는 (1) 예측 오차, (2) 정적 상태 제로화, (3) 지수 감쇠 강제, (4) 연결 부호 모호성 억제, (5) L2 정규화된 연결 희소성 등 다중 정규화 항을 포함해 물리적 제약을 반영한다.

실험에서는 1,000·8,000 뉴런 규모, 4·16·32개의 뉴런 유형, 5 %~100 % 연결 밀도, 다양한 신호 전송 함수(예: (\tanh(x_j\gamma_i)), (\tanh(x_j\gamma_i)-\theta_j x_j)) 및 외부 입력 (\Omega_i(t))를 포함한 시나리오를 모두 검증하였다. 결과는 다음과 같다.

- 연결 행렬 복원 – R² = 1.00(밀도 100 %)에서 0.99(5 % 희소)까지, 기울기 0.94~1.03 수준으로 거의 완벽히 복원. L1 정규화와 마스크 기법을 활용하면 극히 희소한 경우에도 정확도가 유지된다.

- 뉴런 유형 식별 – 잠재 벡터 (a_i)에 대한 K‑means 클러스터링이 1.00(4 유형)에서 0.99(32 유형)까지 정확도를 보이며, 차원 수를 2로 제한했을 때 시각적으로 명확한 군집이 형성된다. 1‑차원 잠재 공간은 성능 저하를 초래한다.

- 시그널 전송·업데이트 함수 회귀 – 학습된 MLP ψ*와 ϕ*를 샘플링해 PySR 기반 심볼릭 회귀에 입력하면, 원래의 (\tanh) 형태와 파라미터 (\gamma_i, \theta_i)를 정확히 재구성한다. 이는 “블랙박스” 모델이 아닌 해석 가능한 수식으로 변환 가능함을 의미한다.

- 외부 입력 복원 – 좌표 기반 MLP Ω*가 공간·시간에 따라 변하는 외부 자극을 R² = 0.99, 기울기 ≈ 1.02 수준으로 추정한다. 이는 실제 실험에서 관측되지 않는 조절 신호를 추정하는 데 유용하다.

- 예측 롤아웃 – 훈련에 사용되지 않은 초기 조건에서 400 시간 단계까지 R² = 0.94, 800 시간 단계에서는 R² = 0.36으로 점진적 오류 누적을 보이지만, 단기·중기 예측에서는 충분히 정확하다. 잠재 벡터를 고정하거나 이질성을 무시하면 복원 정확도와 롤아웃 성능이 현저히 떨어진다.

또한, 학습 데이터 양에 대한 민감도 분석에서 약 2 × 10⁴ 시점(1,000 뉴런) 이상이면 성능이 포화됨을 확인했다. 이는 실제 뇌 영상 데이터에서 필요한 최소 샘플 수를 가늠하는 데 참고가 될 수 있다.

전체적으로 이 연구는 (i) 복잡한 비선형 신경 동역학을 그래프 구조로 명시화, (ii) 메시지‑패싱 GNN을 통해 구조·함수·외부 입력을 동시 복원, (iii) 저차원 잠재 공간을 활용해 해석 가능성을 확보한다는 세 가지 핵심 기여를 한다. 향후 실제 신경 기록에 적용하려면 시간 지연, 가변 연결성, 화학적 확산, 비직접 관측(칼슘 영상 등)과 같은 생물학적 복잡성을 추가 모델링해야 할 과제가 남아 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기