LLM 추론의 균열을 찾아라: 패러프레이즈 탐색과 일관성 검증으로 성능 향상

초록

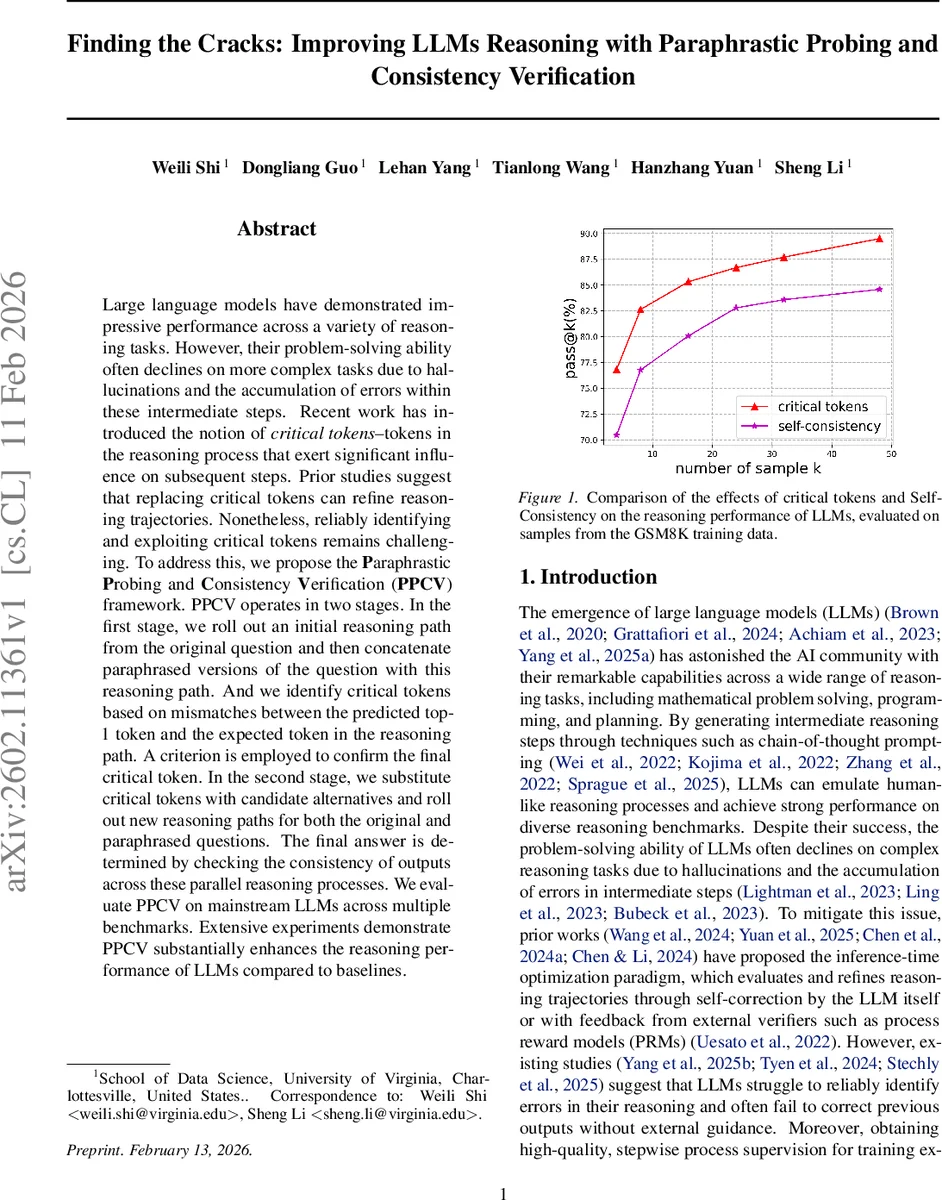

본 논문은 LLM의 추론 과정에서 오류를 일으키는 ‘핵심 토큰’을 파라프레이즈된 질문과 결합해 자동으로 탐지하고, 대체 후보를 적용한 뒤 원문·패러프레이즈 양쪽에서 일관된 답을 선택하는 PPCV 프레임워크를 제안한다. 실험 결과, 기존 Self‑Consistency와 자기 교정 방식보다 높은 정확도를 달성한다.

상세 분석

PPCV는 두 단계로 구성된다. 첫 번째 단계인 ‘패러프레이즈 탐색(Paraphrastic Probing)’에서는 원 질문에 대해 초기 체인‑오브‑생각(Chain‑of‑Thought) 경로를 생성하고, 여러 패러프레이즈된 질문을 동일 경로에 이어 붙인다. 이렇게 만든 복합 입력을 LLM에 다시 통과시켜 각 토큰 위치에서 top‑1 예측 토큰과 기대 토큰(초기 경로에서 실제 생성된 토큰) 사이의 불일치를 기록한다. 불일치가 발생한 위치는 파라프레이즈에 민감하게 반응하는 지점으로, 이는 이후 단계에서 ‘핵심 토큰(Critical Token)’ 후보가 된다. 논문은 이러한 후보를 최종 핵심 토큰으로 확정하기 위해 두 가지 경험적 기준을 적용한다. 첫째, 해당 위치에서의 토큰 확률 차이(Δ)가 일정 임계값을 초과해야 한다. 둘째, 그 토큰 이후의 토큰들이 지속적으로 낮은 정확도 점수를 유지해야 한다. 이 과정은 외부 검증 모델 없이 LLM 자체의 로짓을 활용하므로 구현 비용이 낮다.

두 번째 단계인 ‘일관성 검증(Consistency Verification)’에서는 확정된 핵심 토큰을 상위 K개의 후보 토큰으로 교체한다. 교체된 토큰을 사용해 원 질문과 모든 패러프레이즈 질문에 대해 새로운 추론 경로를 다시 생성한다. 여기서 핵심 아이디어는 올바른 답변을 도출하는 경로는 파라프레이즈 변형에 대해 견고(robust)하다는 관찰이다. 따라서 각 후보 토큰에 대해 원문·패러프레이즈 양쪽에서 생성된 최종 답변을 비교하고, 가장 높은 일관성 점수를 얻는 답을 최종 선택한다. 일관성 점수는 단순 다수결이 아니라, 원문과 패러프레이즈 간의 의미 유사도 가중치를 포함한다.

실험에서는 Llama‑3.1‑8B‑Instruct, GPT‑3.5‑Turbo 등 주류 모델을 대상으로 GSM8K, MathQA, CommonsenseQA 등 다양한 수학·논리·상식 베엔치마크에 적용하였다. 결과는 Pass@k, 정확도, 그리고 평균 토큰 수 등 여러 지표에서 Self‑Consistency와 기존 자기 교정 기법을 크게 앞섰으며, 특히 복잡한 다단계 문제에서 오류 전파를 효과적으로 차단한다는 점이 강조된다.

기술적 강점은 (1) 핵심 토큰을 파라프레이즈 민감도만으로 자동 탐지함으로써 외부 라벨링 비용을 제거, (2) 후보 토큰 탐색과 일관성 검증을 통해 추론 경로 자체를 재구성해 오류를 정정, (3) 기존 샘플링 기반 방법보다 계산 효율성이 높다는 점이다. 반면 한계점으로는 (①) 파라프레이즈 생성 품질에 크게 의존한다는 점, (②) 핵심 토큰 탐지 과정에서 토큰 수준의 미세 조정이 어려워 복합적인 오류(예: 논리적 비일관성)에는 적용이 제한될 수 있다, (③) 후보 토큰 K값과 일관성 가중치 등 하이퍼파라미터가 데이터셋마다 민감하게 변동한다는 점이다. 또한, 현재 구현은 토큰‑레벨 로짓을 직접 접근할 수 있는 모델에만 적용 가능하므로, API‑only 모델에는 적용이 어려울 수 있다.

향후 연구 방향으로는 (1) 파라프레이즈 다양성을 자동으로 최적화하는 메타‑프롬프트 설계, (2) 핵심 토큰 탐지를 문맥‑전체 수준의 그래프 구조와 결합해 복합 오류를 포착, (3) 외부 검증기 없이도 토큰‑레벨 확신도를 추정하는 베이지안 방법 도입 등이 제시된다. 전반적으로 PPCV는 LLM 추론의 “취약점”을 찾아내고, 이를 일관성 기반 재검증으로 보완하는 실용적인 프레임워크로 평가된다.

댓글 및 학술 토론

Loading comments...

의견 남기기