같은 피드백 다른 출처가 학습자 참여에 미치는 영향

초록

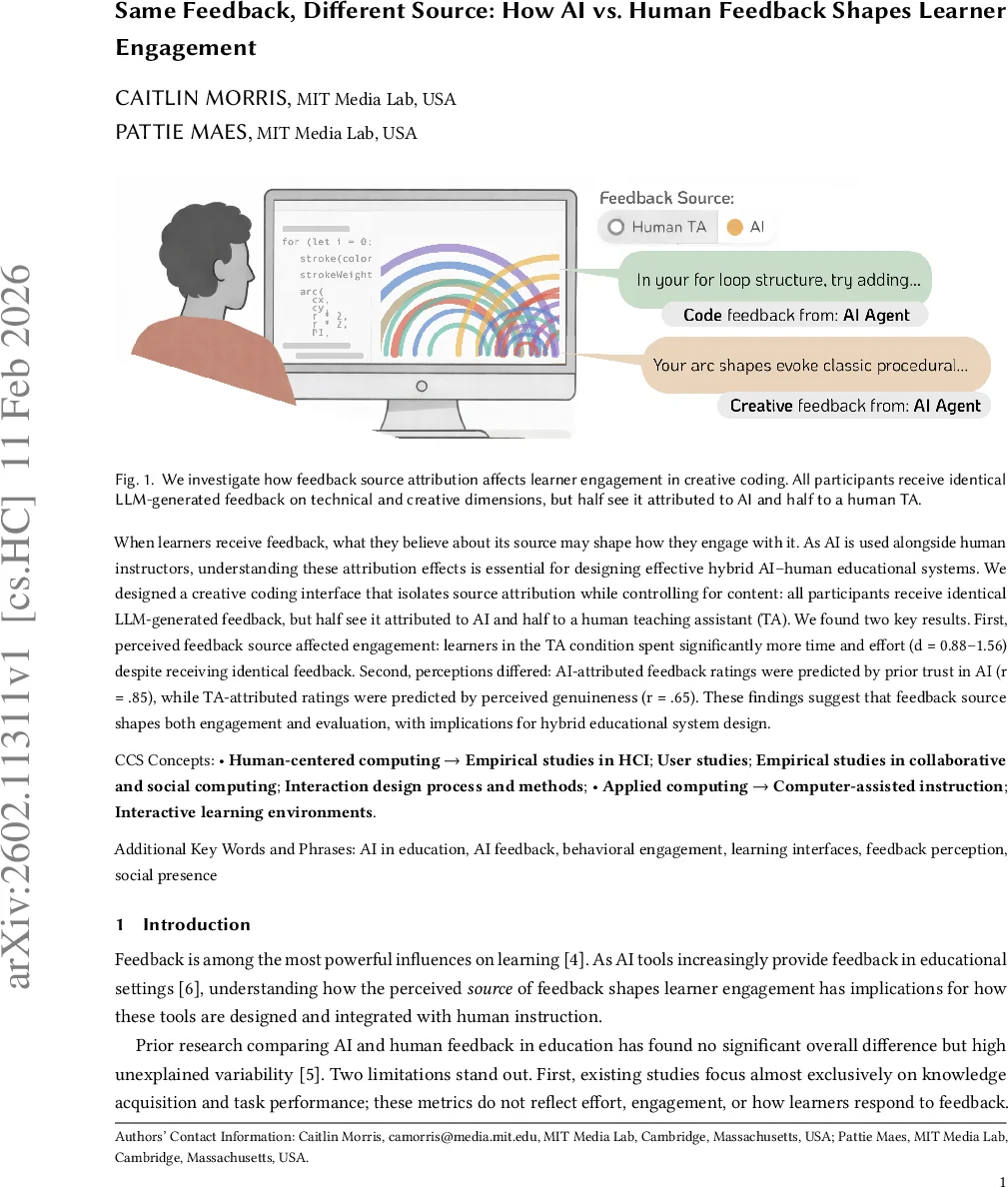

본 연구는 동일한 LLM‑생성 피드백을 AI와 인간 조교(TA) 중 하나의 출처로 속였을 때 학습자의 행동적 참여와 인지적 평가가 어떻게 달라지는지를 실험하였다. 피드백 내용은 동일했지만 출처에 따라 TA 조건이 시간, 코드 실행 횟수, 코드 양 등에서 현저히 높은 참여를 보였으며, AI 조건에서는 사전 AI 신뢰도가 피드백 유용성 평가에 큰 영향을 미쳤다. 출처 귀속이 학습 동기와 참여에 중요한 역할을 함을 시사한다.

상세 분석

이 논문은 피드백 출처 귀속(attribution)이 학습자의 행동적 참여와 인지적 평가에 미치는 영향을 정밀하게 분리하고자 한 실험 설계가 가장 큰 강점이다. 동일한 LLM(Claude Sonnet 4)으로 생성된 피드백을 두 조건에 동일하게 제공하고, 오직 “AI‑Generated Feedback”와 “Your TA: Cass”라는 헤더와 피드백 제공 지연 시간(즉시 vs. 2분 지연)만을 차별화함으로써 내용(confound) 없이 순수한 출처 효과만을 측정했다. 이는 기존 연구가 인간과 AI 피드백을 서로 다른 내용으로 비교해 온 한계를 극복한 접근이다.

행동적 지표는 모듈별 과제 수행 시간, 코드 실행 빈도, 작성 코드 길이, 클릭‑away(참조) 횟수 등 다차원적으로 측정되었으며, 특히 TA 조건에서 시간(d = 1.56, 색상 모듈)과 노력(d = 0.88, 인터랙션 모듈)에서 큰 효과크기를 보였다. 이는 학습자가 인간 존재를 인지했을 때 사회적 존재감(social presence)이 동기 부여와 지속적인 노력으로 전이된다는 사회적 존재 이론을 실증적으로 뒷받침한다.

인지적 평가 측면에서는 기술적 피드백과 창의적 피드백 모두에 대해 출처 차이가 없었으며(F = 0.13, p = .723), 이는 학습자가 피드백의 객관적 품질을 출처와 무관하게 평가한다는 점을 보여준다. 그러나 피드백 유용성 평가는 출처별로 다른 선행 변인에 의해 설명된다. AI 조건에서는 사전 AI 신뢰도(기술·창의 모두에 대해 r ≈ 0.8)가 강한 예측변인으로 작용했으며, 인간 TA 조건에서는 피드백의 진정성(genuineness)과 목표 이해도가 주요 예측변인(r ≈ 0.65)으로 나타났다. 이는 학습자가 같은 내용이라도 출처에 따라 “신뢰”와 “진정성”이라는 다른 심리적 기준을 적용한다는 점을 시사한다.

제한점으로는 표본(N = 25) 규모가 작아 효과 크기의 안정성이 낮고, 단일 세션 설계로 장기적 귀속 효과를 검증하기 어렵다는 점이다. 또한 TA 조건이 실제 인간 조교가 아닌 시뮬레이션이라는 점에서 윤리적·생태학적 타당성에 의문이 남는다. 그럼에도 불구하고, 피드백 내용 통제와 출처 조작이라는 엄격한 실험 설계는 향후 하이브리드 AI‑human 교육 시스템 설계에 중요한 실증 근거를 제공한다.

요약하면, 동일한 피드백이라도 출처가 인간이면 학습자는 더 많은 시간과 노력을 투자하고, 인간 피드백을 진정성 있게 인식한다. 반면 AI 피드백은 사전 신뢰도가 높을 때만 긍정적 평가를 얻으며, 이는 AI 도입 시 학습자에게 AI에 대한 신뢰 구축이 필요함을 의미한다.

댓글 및 학술 토론

Loading comments...

의견 남기기