현실 파일럿: 음성 기반 혼합현실 인간‑AI 협업 시스템

초록

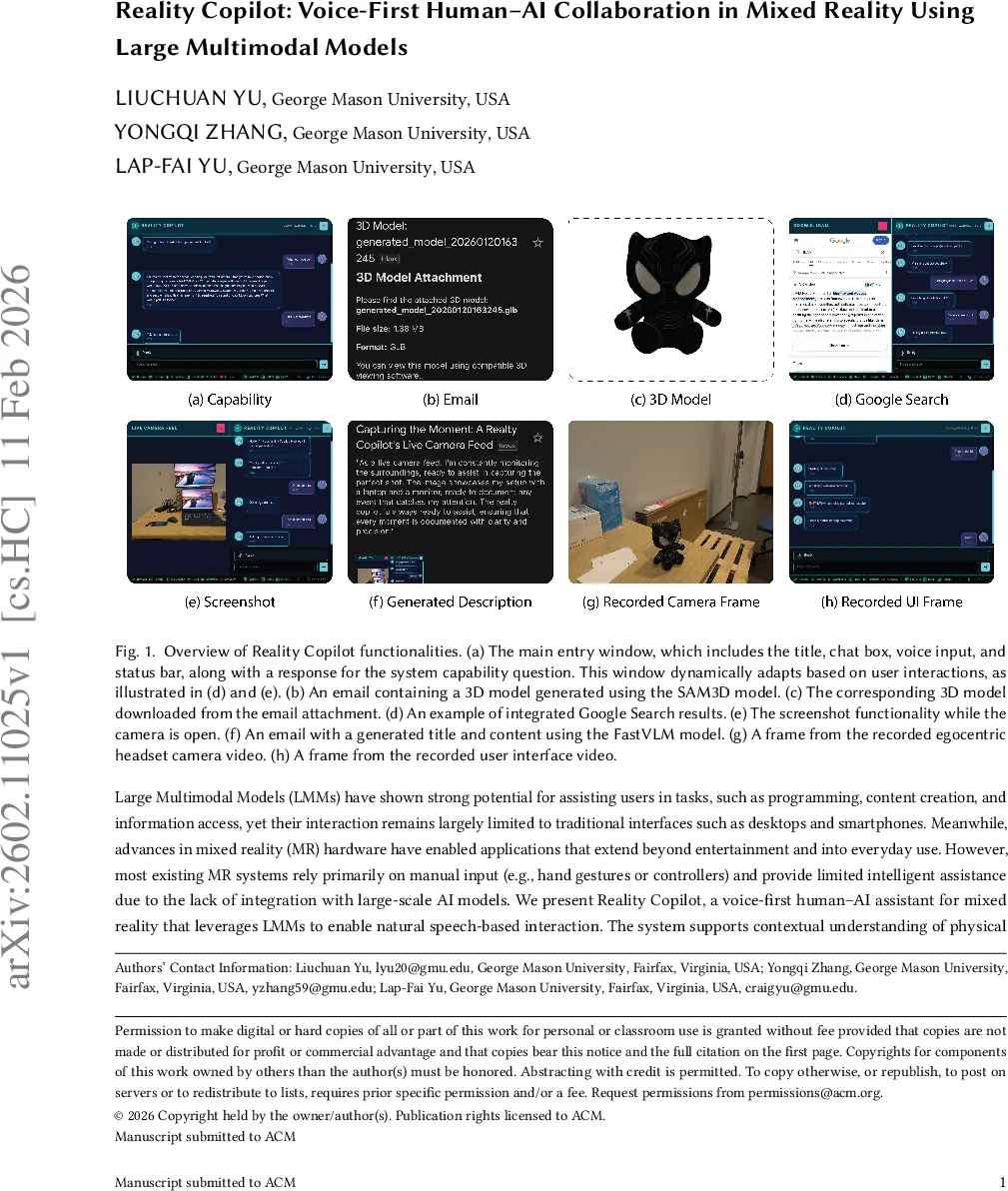

Reality Copilot은 음성 입력을 주 인터페이스로 삼아, 메타 Quest 3 등 MR 헤드셋에서 대규모 멀티모달 모델(LMM)을 활용해 실시간 3D 콘텐츠 생성, 환경 인식, 정보 검색 및 이메일 자동 작성 등을 수행하는 시스템이다. 상업용 LLM·LMM(예: ChatGPT, Gemini)과 오픈소스 비전·3D 모델링 모델(FastVLM, SAM, SAM3D)을 혼합해 프라이버시를 보호하면서도 풍부한 멀티모달 처리를 제공한다. 스택 기반 컨텍스트 관리와 하드웨어 가속 영상·오디오 녹화 파이프라인을 도입해 손‑프리 생산성을 크게 향상시킨다.

상세 분석

Reality Copilot은 “음성‑우선” 인터페이스 설계라는 핵심 가설을 바탕으로, 혼합현실(MR) 헤드셋의 물리적 제약(손‑피로, 시야 제한)을 극복하고자 한다. 시스템은 크게 세 계층으로 구성된다. 1) 입력 계층에서는 TEN VAD를 이용해 사용자의 발화 시점을 자동 감지하고, 마이크와 헤드셋 스피커를 통해 양방향 음성 흐름을 유지한다. 2) 처리 계층에서는 상업용 LLM(Large Language Model)인 ChatGPT·Google Gemini을 “시스템 프롬프트” 기반의 구조화된 응답 생성에 활용한다. 여기서 LLM은 사용자의 의도 파악, 컨텍스트 스택 조회, 후속 액션 정의 등을 담당한다. 이미지·비디오·3D 모델과 같은 멀티모달 데이터는 오픈소스 모델(FastVLM, SAM, SAM3D)로 로컬 서버에서 처리함으로써 개인정보 유출 위험을 최소화한다. 3) 실행 계층은 LLM이 반환한 액션을 실제 헤드셋 기능(카메라 활성화, 스크린샷, 영상 녹화, 이메일 전송 등)과 연결한다. 특히, 하드웨어 가속 H.264·AAC 인코더를 이용해 듀얼 트랙(마이크·스피커) 오디오를 포함한 MP4 영상을 실시간으로 생성하고, MediaMuxer로 최종 파일을 합치는 파이프라인을 구현했다.

컨텍스트 관리 방식은 “스택 기반”으로, 현재 UI 상태·시스템 가용성(네트워크, 백엔드 서비스) 등을 메타데이터로 저장하고, 새로운 발화가 들어오면 최신 컨텍스트를 팝하고 LLM에 전달한다. LLM이 반환한 새로운 컨텍스트는 다시 푸시되어 대화 흐름의 일관성을 유지한다. 사용자는 “스택 팝” 명령을 음성으로 직접 트리거할 수 있어, 예를 들어 현재 사진을 이메일로 전송하는 작업을 수행하면서도 이전 대화 상태를 보존한다.

하드웨어 측면에서 Unity 6000 기반 UI와 Vuplex 3D WebView를 결합해 HTML 기반 인터페이스를 MR 환경에 삽입했으며, Mixed Reality Utility Kit의 Passthrough Camera Access를 통해 실시간 장면 캡처가 가능하도록 했다. 백엔드 서버는 Ubuntu 24.04에 NVIDIA GTX 5090 GPU를 탑재해 모델 추론을 가속화한다.

주요 기여는 (1) 음성‑우선 MR 인간‑AI 협업 프레임워크 제안, (2) 상업·오픈소스 LMM을 혼합한 프라이버시‑보호 아키텍처 구현, (3) 스택 기반 컨텍스트 관리와 하드웨어 가속 녹화 파이프라인을 통한 실시간 멀티모달 지원, (4) 교육·콘텐츠 제작·3D 디자인 등 세 가지 실제 시나리오 시연이다. 한계점으로는 현재 상업용 LLM에 대한 의존성, 네트워크 지연에 따른 응답 지연, 그리고 오픈소스 비전·3D 모델의 품질 변동성이 있다. 향후 연구에서는 온‑디바이스 LMM 경량화, 사용자 맞춤형 프롬프트 학습, 그리고 협업 멀티유저 환경 지원을 목표로 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기