보드게임을 위한 자원 효율 모델 프리 강화학습

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

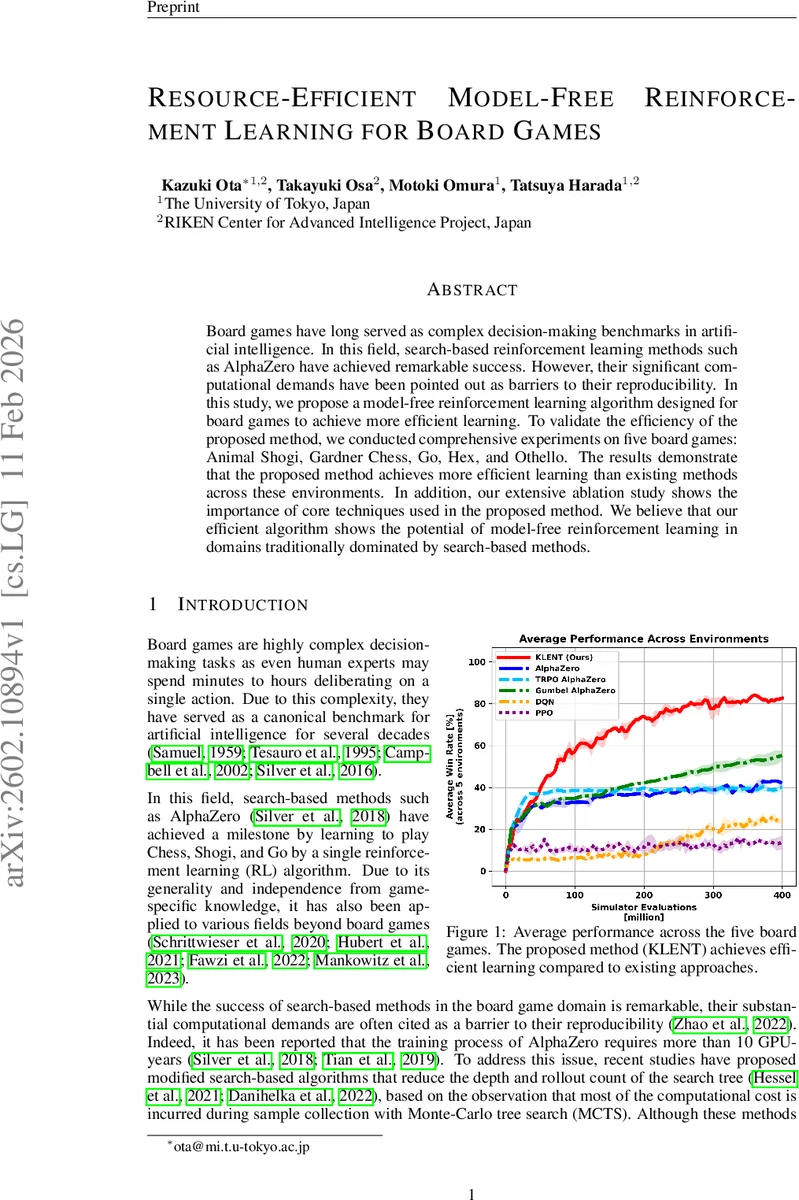

본 논문은 탐색 기반 학습을 배제하고, KL 정규화와 엔트로피 정규화를 결합한 정책 최적화 기법(KLENT)을 제안한다. KLENT은 유한 행동 공간을 갖는 보드게임을 MDP로 모델링하고, 역 KL과 엔트로피 항을 이용해 점진적인 정책 업데이트를 수행한다. 또한 λ‑returns를 활용해 행동‑가치(Q) 함수를 안정적으로 학습한다. 실험은 Animal Shogi, Gardner Chess, Go, Hex, Othello 다섯 게임에서 기존 모델‑기반 방법보다 학습 효율이 높음을 보였으며, 각 구성 요소의 중요성을 입증하는 상세한 ablation study도 제공한다.

상세 분석

KLENT은 보드게임이라는 완전 정보·유한 행동 공간을 전제로, 모델‑프리(on‑policy) 강화학습 프레임워크를 설계했다. 핵심은 두 가지 정규화 항을 동시에 적용한 정책 최적화 문제이다. 역 KL 정규화(β D_KL(π′‖π))는 새 정책이 기존 정책에서 급격히 벗어나지 않도록 제한하면서, 엔트로피 정규화(α H(π′))는 탐색을 촉진한다. 이 두 항을 포함한 목적함수는 유한 행동 집합에 대해 해석적으로 최적해를 구할 수 있어, π′(a|s)=exp

댓글 및 학술 토론

Loading comments...

의견 남기기