인터랙티브 LLM 기반 커리큘럼 학습으로 다중과제 진화 정책 탐색 강화

초록

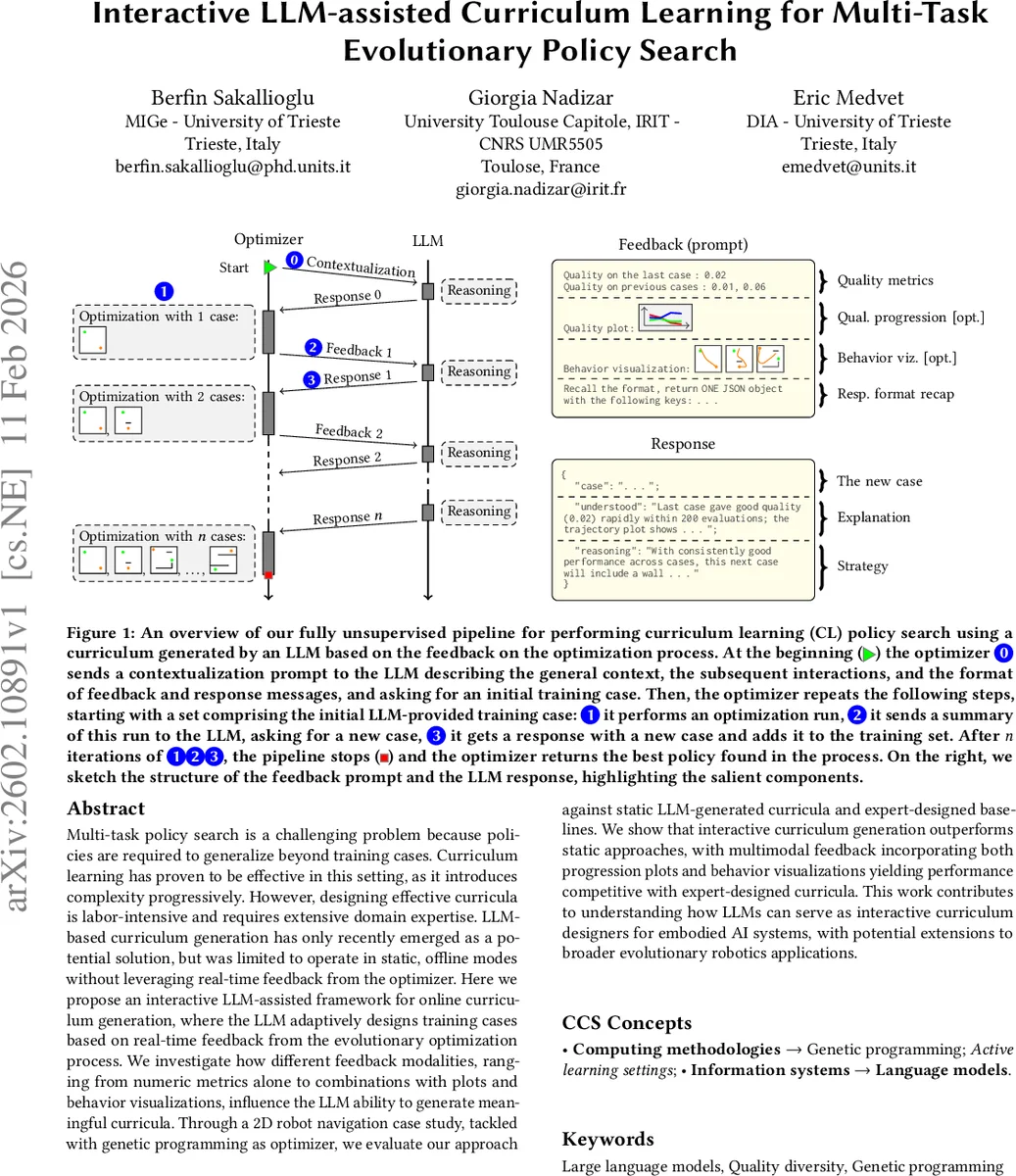

본 논문은 진화적 정책 탐색 과정에서 실시간 피드백을 활용해 대형 언어 모델(LLM)이 커리큘럼을 동적으로 설계하도록 하는 인터랙티브 프레임워크를 제안한다. 숫자형 성능 지표, 진행 플롯, 행동 시각화 등 세 가지 피드백 모드를 비교 실험했으며, 2D 로봇 내비게이션 과제에서 인터랙티브 방식이 정적 LLM 커리큘럼 및 전문가 설계 커리큘럼을 능가함을 보였다.

상세 분석

이 연구는 다중과제(MT) 정책 탐색에서 일반화 능력을 확보하기 위해 커리큘럼 학습(Curriculum Learning, CL)을 진화적 최적화와 결합한 새로운 패러다임을 제시한다. 기존 LLM 기반 커리큘럼 생성은 사전 정의된 정적 사례에 의존했으나, 본 논문은 최적화 진행 상황을 실시간으로 LLM에 전달하고, LLM이 이를 해석해 다음 훈련 케이스를 생성하도록 설계하였다. 피드백 모드는 크게(N) 순수 수치 메트릭, (N+P) 수치와 품질 진행 플롯, (N+P+B) 여기에 행동 시각화(로봇 궤적)를 추가한 형태로 구분된다.

핵심 메커니즘은 다음과 같다. 초기 단계에서 옵티마이저가 LLM에 문제 정의와 피드백·응답 포맷을 전달하고, 초기 케이스를 요청한다. 이후 매 반복마다 옵티마이저는 현재 케이스 집합 C 에 대해 진화적 탐색(Genetic Programming, GP)을 수행하고, 최적 정책의 품질 점수와 선택적 플롯·시각화를 포함한 피드백을 LLM에 전송한다. LLM은 이 정보를 바탕으로 새로운 환경(시작 위치, 목표 위치, 장애물 배치 등) 혹은 난이도 변화를 제안하고, 이를 C 에 추가한다. 케이스를 누적함으로써 catastrophic forgetting을 방지하고, 점진적으로 복잡도가 상승하는 커리큘럼을 형성한다.

실험에서는 2D 로봇 내비게이션 문제를 설정하였다. 로봇은 5개의 근접 센서와 목표 거리·방향 센서를 갖고, GP 트리 형태의 심볼릭 컨트롤러를 진화시켰다. 정책은 21차원 관측을 입력으로 받아 실수값을 출력하고, 이를 회전 속도로 변환한다. 각 케이스는 시작·목표 위치와 벽 구조를 정의하며, 에피소드는 60 초(600 스텝) 동안 시뮬레이션된다.

성능 평가는 각 케이스별 최적 정책의 품질 점수(목표 도달 거리, 충돌 여부 등)와 전체 커리큘럼 진행 동안의 평균 점수 상승률을 사용했다. 결과는 (N+P+B) 피드백을 제공한 인터랙티브 LLM 커리큘럼이 정적 LLM 커리큘럼보다 현저히 높은 성공률과 빠른 수렴을 보였으며, 전문가가 설계한 커리큘럼과 거의 동등한 수준에 도달함을 보여준다. 특히 행동 시각화가 포함될 때 LLM이 로봇의 움직임 패턴을 직접 파악해 장애물 회피 전략을 단계적으로 강화하는 것이 관찰되었다.

이 논문의 주요 기여는 (1) 진화적 정책 탐색과 LLM을 결합한 실시간 커리큘럼 생성 프레임워크, (2) 피드백 모드별 LLM의 설계 능력 차이를 정량적으로 분석, (3) 인터랙티브 방식이 전문가 수준의 커리큘럼을 자동으로 생성할 수 있음을 실험적으로 입증한 점이다. 한계로는 현재 실험이 2D 시뮬레이션에 국한되어 실제 로봇 하드웨어에 적용하기 위한 전이 연구가 필요하고, LLM의 프롬프트 설계가 여전히 도메인 전문가의 개입을 요구한다는 점을 들 수 있다. 향후 연구에서는 멀티모달 LLM(텍스트·이미지·비디오)과 더 복잡한 3D 로봇 환경, 그리고 온라인 학습과 연계한 지속적 커리큘럼 적응을 탐색할 예정이다.

댓글 및 학술 토론

Loading comments...

의견 남기기