자기진화 루브릭으로 체인오브생각 강화하기

초록

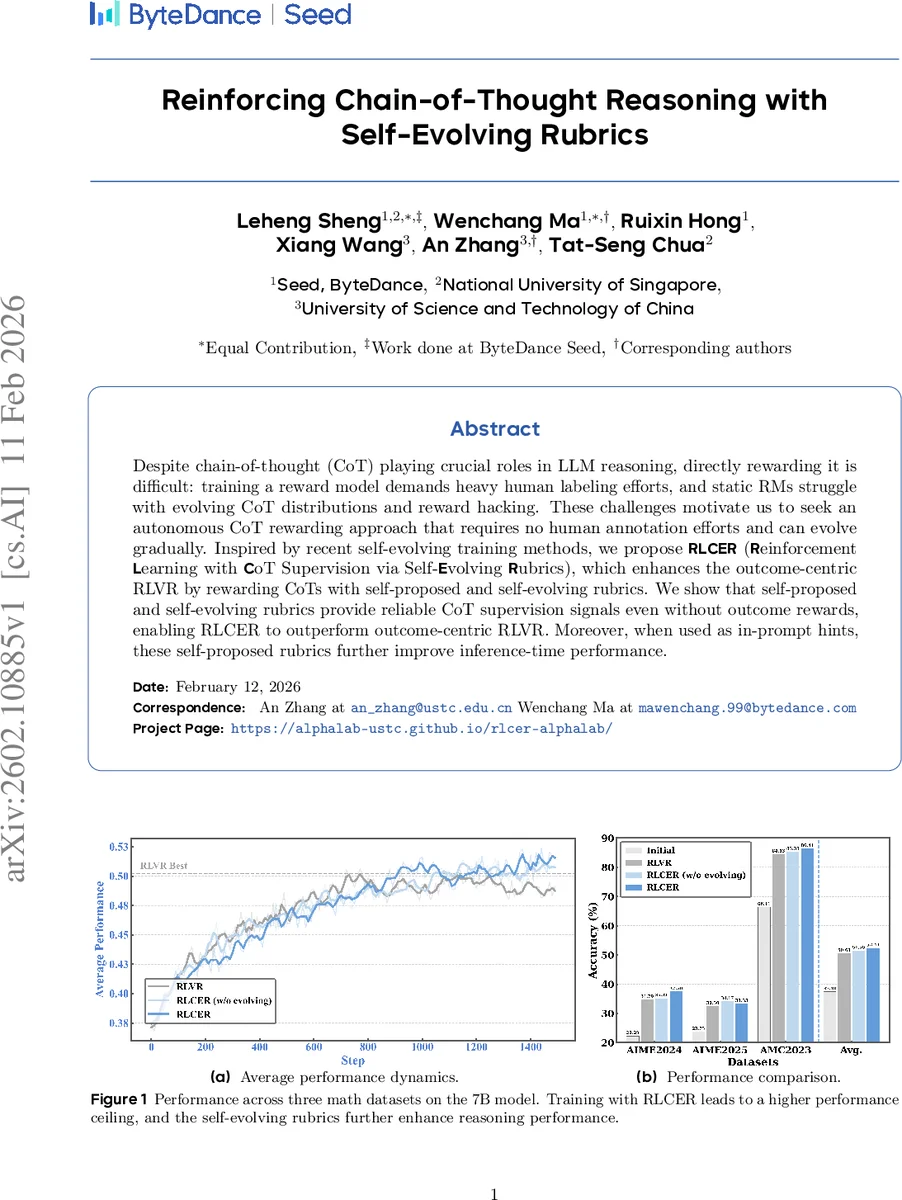

RLCER는 하나의 LLM을 이유자와 루브릭 생성기 두 역할로 활용해, 인간 라벨 없이 스스로 만든 자연어 루브릭을 지속적으로 진화시키며 CoT(Chain‑of‑Thought) 품질을 직접 보상한다. 루브릭의 유효성은 정답 정확도와의 상관관계로 판단하고, 이를 기반으로 CoT와 최종 답에 대한 복합 보상을 제공한다. 실험 결과, 순수 루브릭 보상만으로도 학습이 가능하며, 기존 결과‑중심 RLVR보다 우수하고, 진화된 루브릭을 프롬프트 힌트로 사용할 경우 추론 성능이 추가로 향상된다.

상세 분석

이 논문은 LLM의 추론 과정을 직접 최적화하려는 시도로, 기존 RL VR이 최종 정답만을 보상하고 CoT는 부수적인 효과에 머무는 한계를 짚는다. RLCER는 정책 모델 πθ를 두 개의 프롬프트(P_Rea, P_Rub)로 인스턴스화해 ‘이유자’와 ‘루브릭 생성기’ 역할을 동시에 수행하게 한다. 이유자는 질문 Q에 대해 CoT ˆC와 답 ˆA를 생성하고, 루브릭 생성기는 동일 질문과 생성된 CoT를 입력으로 K개의 루브릭 ˆτk(텍스트 기준 c_k와 가중치 s_k)를 출력한다.

루브릭의 유효성 판단은 핵심적인 설계이다. 각 루브릭에 대해 N개의 샘플 롤아웃을 수집해 만족 지표 v_k=⟨πϕ(c_k, C_i)⟩와 정답 일치 지표 z=⟨I(A, Â_i)⟩를 구하고, corr(v_k, z) > α (α=0.2) 및 std(v_k)>0인 경우에만 ‘유효’ 루브릭으로 채택한다. 이렇게 하면 루브릭이 실제 정답과 강한 양의 상관관계를 갖는 경우에만 보상에 사용되므로, 무의미하거나 편향된 기준이 학습을 방해하지 않는다.

CoT 보상 r_Rea^cot은 유효 루브릭들의 만족 여부와 가중치를 곱해 합산한 뒤 min‑max 정규화로

댓글 및 학술 토론

Loading comments...

의견 남기기