시각 히스토리 기반 맥락 인식 이미지 검색을 위한 DeepImageSearch와 DISBench

초록

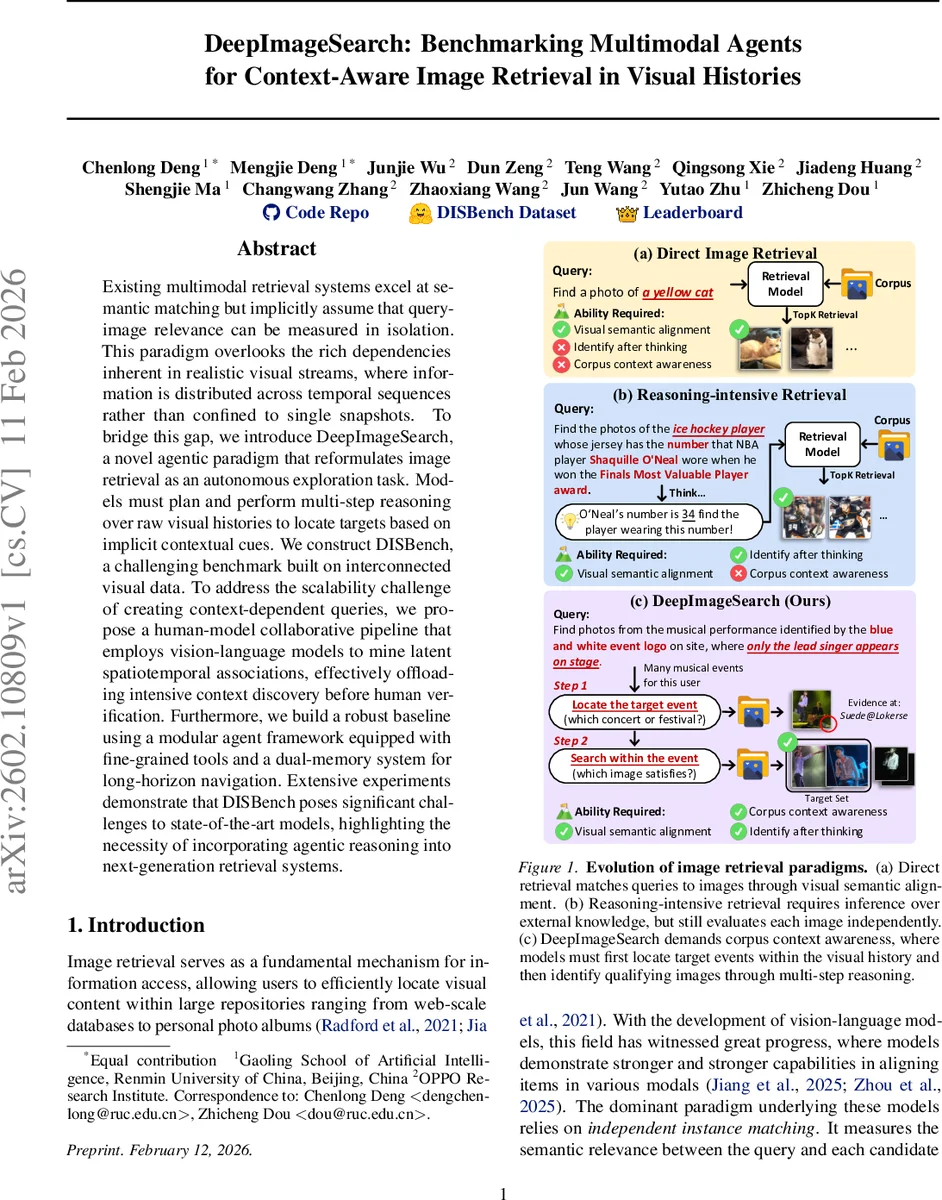

DeepImageSearch는 이미지 검색을 독립적인 매칭이 아니라 시각 히스토리 전체를 탐색하는 에이전트 과제로 재정의한다. 저자들은 인간‑모델 협업 파이프라인으로 대규모 맥락‑의존 쿼리를 자동 생성하고, 이를 기반으로 DISBench라는 새로운 벤치마크를 구축했다. 모듈형 에이전트와 이중 메모리 구조를 활용한 베이스라인을 제시했으며, 최신 멀티모달 모델들은 EM 28.7% 수준에 머물러 장기 탐색 및 교차 이벤트 연관성 파악에 한계를 보였다.

상세 분석

본 논문은 기존 멀티모달 이미지 검색이 “쿼리‑이미지 매칭”이라는 정적 프레임에 머물러 있다는 근본적인 한계를 짚고, 시각 히스토리라는 시간·공간적 연속성을 고려한 새로운 패러다임을 제시한다. 핵심 아이디어는 이미지 검색을 “에이전트가 직접 탐색하고 증거 사슬을 구축하는 과정”으로 전환하는 것으로, 이를 위해 두 가지 기술적 축을 구축한다. 첫째, 인간‑모델 협업 파이프라인이다. 저자들은 대규모 공개 사진 데이터(YFCC100M)를 활용해 사진집(photoset) 단위의 이벤트 구조를 유지하면서, 비전‑언어 모델(VLM)을 이용해 각 이미지에서 시각적 단서(랜드마크, 텍스트, 인물 등)를 추출하고, 클러스터링·연관성 검증 과정을 거쳐 고신뢰 연관 그래프를 자동 생성한다. 인간 annotator는 이 그래프를 검증·보완함으로써, 수천 장의 이미지에 걸친 복합 쿼리를 효율적으로 설계한다. 둘째, 에이전트 기반 베이스라인이다. 모델은 “이중 메모리”(short‑term tool memory + long‑term episodic memory)를 갖춘 모듈형 구조로, 툴(예: 이미지 검색, OCR, 객체 검출) 호출을 계획하고 실행한다. 특히, 에이전트는 먼저 “앵커 이미지”(예: 로고)를 찾아 이벤트를 로컬라이징하고, 이후 해당 이벤트 내부에서 목표 이미지를 필터링한다는 2‑단계 탐색 흐름을 따른다. 이러한 설계는 기존의 “쿼리 → 이미지 → 점수” 흐름을 탈피해, 증거가 분산된 여러 이미지 사이의 논리적 연결을 명시적으로 모델링한다는 점에서 혁신적이다. 실험 결과는 두 가지 쿼리 유형(이벤트 내부 탐색, 이벤트 간 교차 탐색) 모두에서 최신 CLIP, BLIP‑2, Flamingo 등 최첨단 멀티모달 모델이 70% 이상 성능 격차를 보이며, 특히 장기 탐색 단계에서 상태 유지와 연관성 추론이 크게 약화됨을 보여준다. 오류 분석에서는 (1) 툴 호출 순서 최적화 실패, (2) 메모리 내 오래된 증거 소실, (3) 시각적 단서의 다중 의미성(예: 동일 색상의 로고가 여러 이벤트에 존재) 등이 주요 원인으로 지목된다. 결국 논문은 “시각 히스토리 수준의 맥락 인식”이 차세대 이미지 검색의 핵심 과제이며, 이를 위한 에이전트 설계와 대규모 벤치마크가 시급히 필요함을 설득력 있게 주장한다.

댓글 및 학술 토론

Loading comments...

의견 남기기