협업 임계값 워터마킹: 연합 학습을 위한 비밀 공유 기반 모델 인증

초록

연합 학습에서 K명의 클라이언트가 공동으로 모델을 학습할 때, (t, K) 임계값 워터마크를 비밀 공유와 안전한 집계 기법으로 삽입한다. t명 이상의 클라이언트가 모여야만 워터마크 키 τ를 복원하거나 검증 가능하며, 소수의 클라이언트는 키를 알 수 없고 워터마크를 제거할 수 없다. 실험은 CIFAR‑10/100 및 Tiny‑ImageNet에서 K=128까지 정확도 손실 없이 검출 가능(z≥4)을 확인하고, 90% 프루닝, 4‑bit 양자화, 20% 데이터 기반 파인튜닝 공격에도 강인함을 보였다.

상세 분석

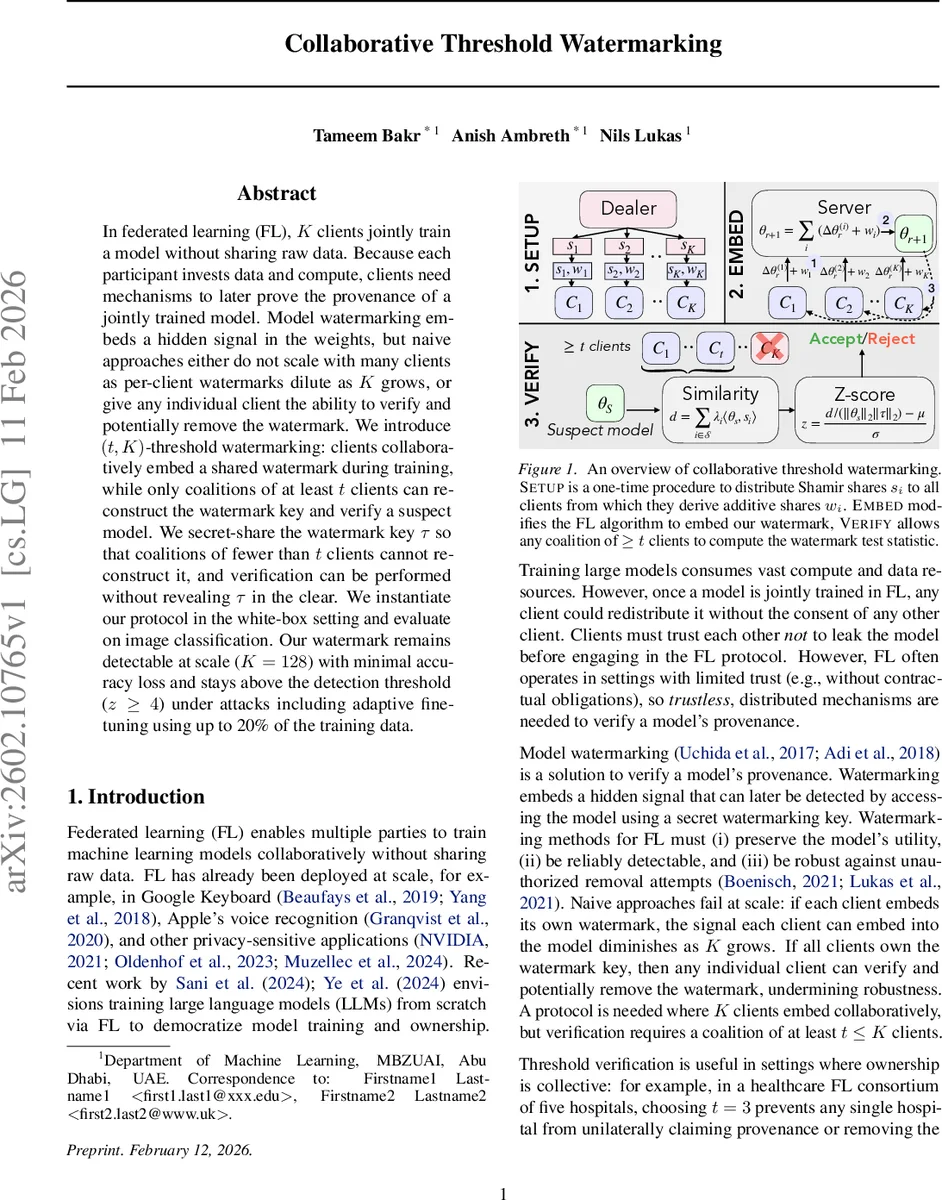

이 논문은 연합 학습(FL) 환경에서 모델 소유권을 집단적으로 증명하기 위한 새로운 워터마킹 프레임워크를 제안한다. 핵심 아이디어는 Shamir 비밀 공유를 이용해 워터마크 키 τ를 K명의 클라이언트에게 (t, K) 임계값 형태로 분배하고, 각 클라이언트는 자신이 받은 공유 s_i 로부터 라그랑주 계수 λ_i 를 곱해 additive share w_i=λ_i s_i 를 만든다. 이렇게 하면 모든 w_i 를 합하면 τ가 되므로, 안전한 집계(Secure Aggregation) 과정을 통해 서버는 개별 w_i 를 알 수 없고 전체 합만을 관찰한다.

임베딩 단계에서는 각 라운드마다 클라이언트가 로컬 업데이트 Δθ_i^r 를 수행하고, 업데이트 크기의 지수 이동 평균(EMA)을 이용해 스케일링 팩터 scale_i 를 동적으로 조정한다. 모든 클라이언트는 scale_i 를 또다시 안전하게 집계해 전역 scale_total 을 얻고, 이를 w_i 에 곱해 θ_i^r 에 추가한다. 결과적으로 전역 모델 θ^r 은 (scale_total/K)·τ 만큼 워터마크 방향으로 이동한다. 이 과정은 클라이언트가 탈락하거나 부분 참여할 경우에도 |S_r|≥t이면 동일하게 동작하도록 설계되었으며, t명 미만이 참여하면 워터마크 삽입을 건너뛴다.

검증 단계는 흰색 상자(white‑box) 방식으로, τ 자체를 복원하지 않고도 ⟨θ_s, τ⟩ 내적을 직접 계산한다. t명 이상의 클라이언트는 라그랑주 계수를 이용해 τ를 재구성하거나, 공유만으로도 검증 통계량 d=∑λ_i⟨θ_s, s_i⟩ 를 구하고, 정규화된 z‑score = (d/(‖θ_s‖·‖τ‖) − μ)/σ 로 가설 검정을 수행한다. 따라서 키가 노출되지 않아 보안성이 유지된다.

실험에서는 CIFAR‑10, CIFAR‑100, Tiny‑ImageNet에 대해 K=128까지 확장성을 확인했으며, 기존 개별 워터마크 방식은 K≥16에서 검출률이 급격히 떨어지는 반면, 제안 방식은 z≥4를 지속적으로 유지한다. 정확도 손실은 0.5% 이하에 머물렀고, 프루닝(90%), 4‑bit 양자화, 그리고 20% 데이터로 파인튜닝한 적응형 공격에도 z‑score가 4.2 이상으로 회복되었다.

보안 분석에서는 (i) 서버가 개별 공유를 알 수 없으므로 τ를 유추할 수 없고, (ii) t‑1명 이하의 악의적 클라이언트 연합은 τ에 대한 정보가 완전히 독립적임을 증명한다. 또한, 커밋먼트 스킴을 사용해 τ를 공개적으로 커밋함으로써 무결성을 보장하고, DKG(분산 키 생성) 절차를 통해 신뢰할 수 있는 딜러가 없을 경우에도 동일한 보안 수준을 유지한다.

성능 측면에서는 매 라운드 한 번의 추가 안전 집계와 스케일 전파가 필요하지만, 통신·연산 오버헤드는 기존 FL 프로토콜 대비 선형 수준에 머물러 실용적이다. 한계점으로는 라그랑주 계수를 사전에 고정해야 하는 점, 그리고 워터마크 검증을 위해 모델 파라미터에 직접 접근할 수 있는 흰색 상자 환경이 필요하다는 점을 들 수 있다. 향후 연구에서는 검증을 블랙박스 API 수준으로 확장하거나, 비동기식 클라이언트 참여 모델에 대한 이론적 보장을 강화할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기