양단 일관성 모델로 한 단계 이미지 생성 혁신

초록

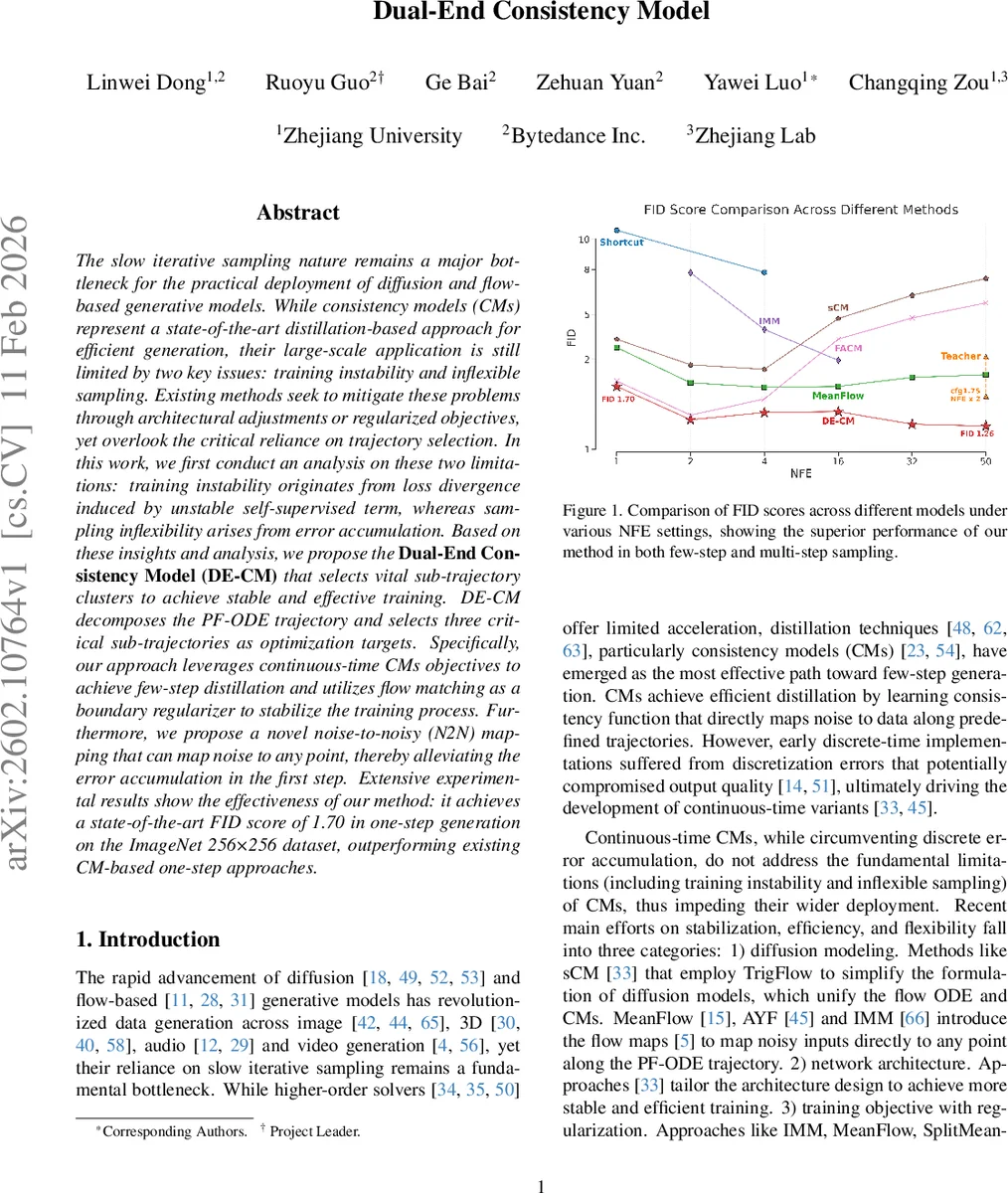

본 논문은 확산·플로우 기반 생성 모델의 느린 반복 샘플링을 극복하기 위해, 훈련 불안정성과 샘플링 경직성을 해결하는 새로운 접근법인 Dual‑End Consistency Model(DE‑CM)을 제안한다. 핵심 아이디어는 PF‑ODE 궤적을 세 개의 중요한 서브‑궤적으로 분할하고, 각각에 맞는 손실을 적용해 안정적인 학습과 몇 단계(최대 1‑step) 생성 품질을 동시에 달성하는 것이다. 실험 결과 ImageNet 256×256에서 1‑step FID 1.70을 기록, 기존 일관성 모델을 크게 앞선다.

상세 분석

DE‑CM은 기존 연속‑시간 Consistency Model이 전체 PF‑ODE 궤적을 무차별적으로 학습 대상으로 삼아 발생하는 두 가지 근본적 문제, 즉 “훈련 불안정성”과 “샘플링 경직성”을 체계적으로 분석한다. 훈련 불안정성은 손실 함수가 자기‑지도(supervised)와 완전‑지도(fully‑supervised) 두 구성 요소 사이에서 발산하면서, 특히 순간 속도(instantaneous velocity) 정보를 충분히 활용하지 못해 발생한다는 점을 밝혀낸다. 이는 손실식(7)·(8)에서 보듯, 모델이 아직 수렴하지 않은 상태에서 일관성 항이 과도하게 강조되어, 목표 속도 v ϕ와 모델 자체가 예측한 속도 사이의 차이가 급격히 커지는 현상이다. 반면 샘플링 경직성은 기존 CMs가 “any xₜ → x₁” 매핑만을 학습하기 때문에 초기 예측 오차가 그대로 최종 출력에 전이되고, 다단계 샘플링 시 매 단계마다 새로운 노이즈를 주입함으로써 누적 오차가 급증한다는 점에서 기인한다.

이러한 분석을 바탕으로 저자들은 PF‑ODE 궤적을 (t, s) 공간에서 세 개의 서브‑궤적 클러스터—Consistency Trajectory( t → 1 ), Instantaneous Trajectory( t → t ), Noise‑to‑Noisy(N2N) Trajectory( 0 → t )—로 명시적으로 선택한다. Consistency Trajectory는 기존 CMs와 동일하게 “any t → data” 매핑을 학습해 몇 단계(distillation) 생성 능력을 제공한다. Instantaneous Trajectory는 흐름 매칭(flow matching) 손실을 경계 조건으로 도입해, 순간 속도 v ϕ를 정확히 복원하도록 강제함으로써 훈련 중 발생하던 발산을 억제한다. N2N Trajectory는 순수 노이즈를 임의의 중간 시점으로 매핑하는 새로운 목표 함수를 정의해, 초기 노이즈 재사용을 가능하게 함으로써 다단계 샘플링 시 누적 오차를 크게 감소시킨다.

수식적으로는 Eq.(9) fθ(xₜ,t,s)=xₜ+(s−t)Fθ(xₜ,t,s) 를 기반으로, s=1일 때는 Consistency 손실 L_cm (Eq.10), s=t일 때는 흐름 매칭 경계 손실, 그리고 r→0, s=t인 경우는 N2N 손실 L_n2n (Eq.15) 으로 각각 최적화한다. 특히 Instantaneous Trajectory에서 Jacobian‑Vector‑Product(JVP)를 이용해 dFθ/dt 를 동적으로 계산하고, 이를 가중치 λ, γ 로 조절해 안정성을 확보한다. 실험에서는 이 세 손실을 동시에 학습함으로써, 기존 방법이 겪던 “loss divergence”와 “error accumulation”을 실질적으로 해소한다는 것이 입증되었다.

결과적으로 DE‑CM은 훈련 단계에서의 불안정성을 최소화하고, 샘플링 단계에서는 초기 노이즈를 재활용함으로써 1‑step에서 FID 1.70, 다단계에서도 경쟁력 있는 성능을 달성한다. 이는 기존 CMs가 한계였던 “전체 궤적을 무차별 학습” 전략을 “핵심 서브‑궤적 선택” 전략으로 전환함으로써 얻은 성과이며, 향후 고해상도 이미지·비디오·3D 생성 분야에 확산·플로우 모델을 실용화하는 데 중요한 전환점이 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기