다이나믹 환경에서 온라인 다중스펙트럼 센서 재구성을 위한 ReSPEC 프레임워크

초록

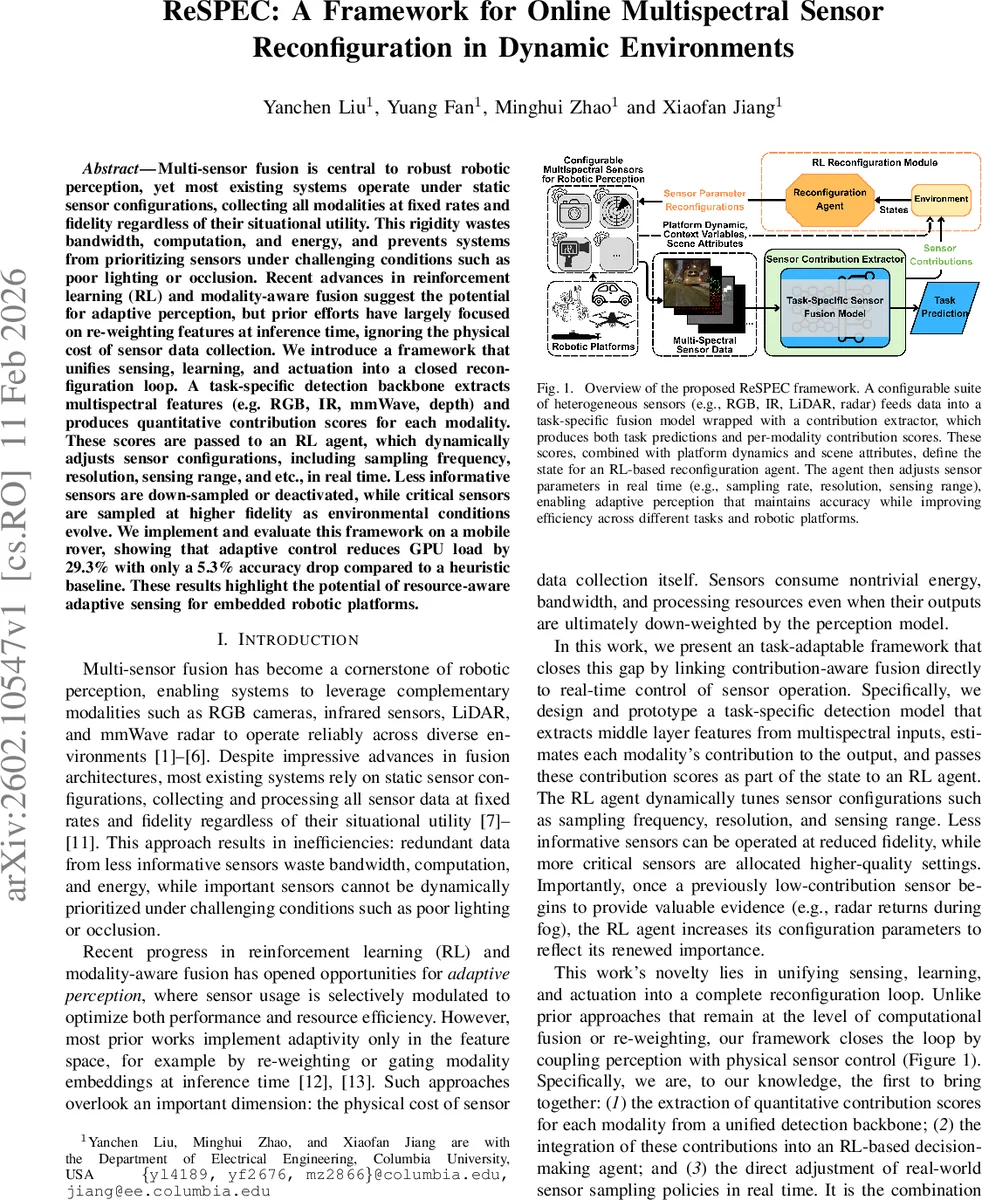

ReSPEC는 멀티스펙트럼 센서들의 샘플링 주파수·해상도·감지 범위 등을 실시간으로 조절하는 강화학습 기반 프레임워크이다. 감지 백본이 각 모달리티의 기여도를 정량화해 상태로 제공하고, RL 에이전트가 이를 활용해 자원 효율성을 극대화한다. 모바일 로버 실험에서 GPU 부하를 29.3 % 감소시키면서 정확도 손실을 5.3 % 이하로 억제했다.

상세 분석

본 논문은 로봇 인식 시스템에서 센서 데이터 수집 자체가 차지하는 비용을 간과해 온 기존 연구와 차별화된다. 핵심 아이디어는 ‘감지 백본 → 기여도 추출 → 강화학습 기반 재구성’이라는 폐쇄 루프를 구축하는 것이다. 구체적으로, 저자들은 YOLOv8 기반의 경량 검출 백본을 두 단계로 설계하였다. 첫 번째 백본은 RGB 입력을 독립적으로 처리하고, 두 번째 백본은 IR, mmWave 레이더, 깊이 맵을 2D로 투영해 RGB와 정렬한 뒤 공동 처리한다. 중간 레이어에서 각 모달리티별 특징 맵을 추출하고, 이를 가벼운 융합 블록에 결합한다.

기여도 추출은 gradient‑based attribution 방식을 채택한다. 특정 바운딩 박스에 대해 역전파된 그래디언트를 채널별로 집계해, 해당 객체에 대한 각 센서의 기여량을 정량화한다. 이렇게 얻은 객체‑레벨 기여는 씬‑레벨 스코어로 평균·가중합되어 RL 에이전트의 상태(state)로 사용된다. 이 과정은 학습된 검출 모델이 환경에 따라 자동으로 센서 중요도를 학습하도록 하며, 사전 정의된 휴리스틱에 의존하지 않는다.

RL 에이전트는 탭형 Q‑learning을 선택했는데, 이는 실시간 제어에 필요한 계산량을 최소화하기 위함이다. 상태는 (① 플랫폼 속도·가속도, ② 씬 조명·클러터 정도, ③ 모달리티 기여도) 로 구성된다. 행동(action)은 각 센서의 프레임 레이트와 해상도, 그리고 mmWave 레이더의 ‘거리 우선’·‘속도 우선’ 모드 선택을 포함한다. 보상 함수는 (센서 유틸리티 − 자원 비용) 형태로 정의돼, 높은 기여도를 보이는 센서는 고해상도·고주파수로 유지하고, 기여도가 낮은 센서는 저해상도·저주파수 혹은 최소 1 fps로 유지하도록 유도한다.

실험은 Columbia 대학 로봇 연구실에서 구축한 모바일 로버 SPEC에 4종 센서(RGB, IR, mmWave, Depth)를 장착해 수행되었다. 다양한 조명·날씨·장애물 조건에서 에이전트를 학습시킨 결과, 평균 GPU 사용량이 29.3 % 감소했으며, 전체 검출 정확도(mAP)는 기존 고정‑구성 대비 5.3 %만 감소했다. 특히 안개·흐린 날씨에서는 레이더 기여도가 급증함에 따라 에이전트가 레이더의 ‘거리 우선’ 모드와 높은 프레임 레이트를 자동 선택, 전체 성능 저하를 최소화했다.

이 논문의 주요 기여는 다음과 같다. (1) 멀티모달 검출 백본에서 실시간 기여도 추출 메커니즘을 제안, (2) 기여도와 시스템 메트릭을 결합한 상태 정의를 통해 RL 기반 센서 재구성 정책을 학습, (3) 실제 로봇 플랫폼에 적용해 센서 데이터 수집 비용을 직접 절감함을 실증. 한계점으로는 Q‑learning의 이산 행동 공간이 해상도·프레임 레이트 조합을 제한하고, 더 복잡한 연속 제어를 위해서는 정책 기반 RL(DQN, PPO 등)으로의 확장이 필요하다는 점을 들 수 있다. 또한, 기여도 추출이 gradient‑based에 의존하므로 백본이 충분히 학습되지 않으면 잘못된 신호가 에이전트에 전달될 위험이 있다. 향후 연구는 (① 연속형 액션 스페이스와 딥 RL 적용, ② 불확실성 기반 기여도 추정, ③ 다중 태스크(예: SLAM·내비게이션)와의 공동 최적화) 등을 통해 프레임워크를 확장할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기