협동 점프 사족보행 로봇 공동 도약

초록

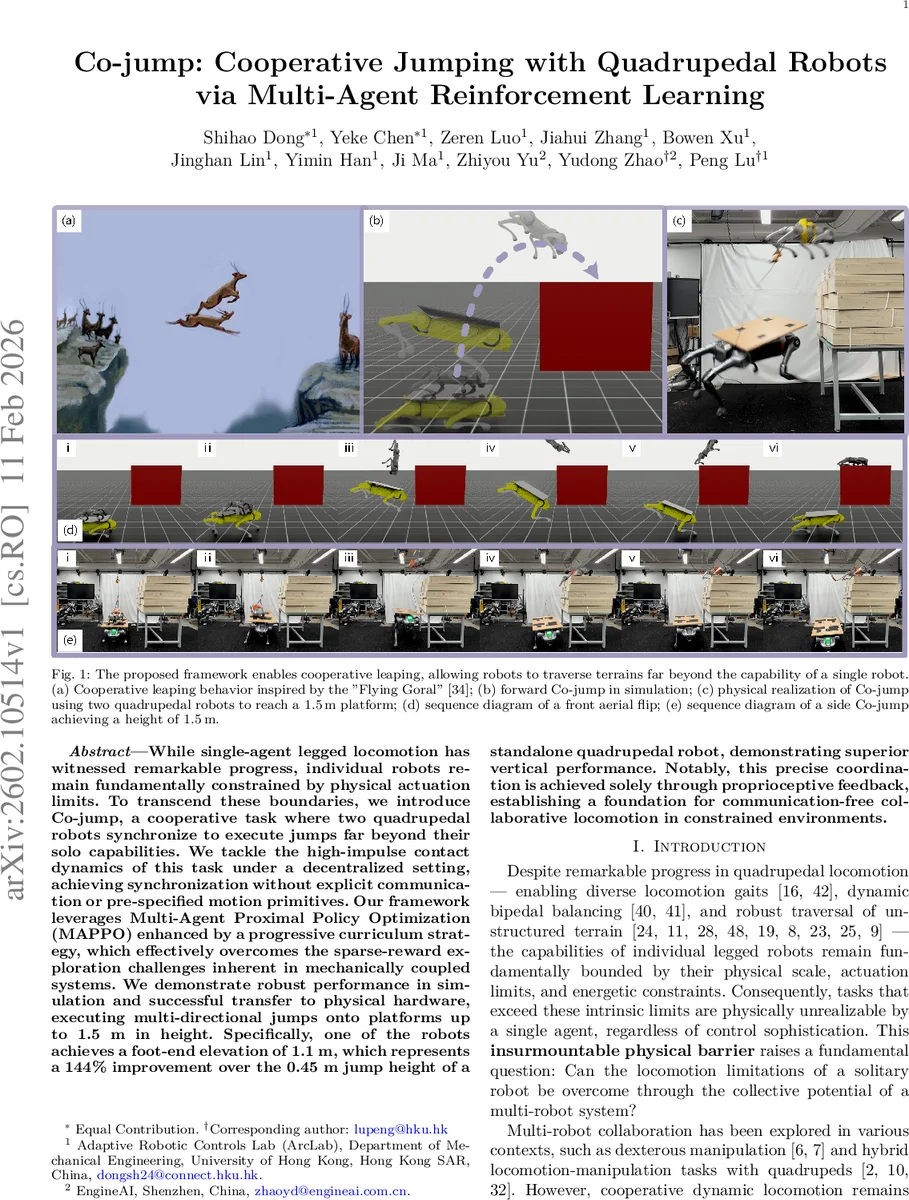

본 논문은 두 대의 사족보행 로봇이 외부 통신 없이 프로프리오셉션만으로 고동기화된 점프를 수행하도록 하는 MARL 프레임워크를 제안한다. MAPPO 기반의 CTDE 구조와 4단계 점진적 커리큘럼을 도입해 희소 보상 문제를 해결하고, 시뮬레이션과 실제 하드웨어에서 1.5 m 높이의 플랫폼을 성공적으로 착지시켰으며, 단독 로봇 대비 144 % 높은 발끝 상승을 달성하였다.

상세 분석

Co‑jump은 물리적 한계에 부딪힌 단일 사족보행 로봇의 점프 능력을 두 로봇이 서로를 ‘활’처럼 이용해 극복한다는 혁신적 아이디어를 제시한다. 핵심 기술은 MAPPO를 활용한 중앙집중식 학습·분산 실행(CTDE) 구조이며, 각 로봇은 proprioceptive 센서와 목표 물체 위치만을 관측한다. 이때 관측 공간은 관절 각·속도, 기반 프레임의 중력·각속도, 이전 액션, 목표 플랫폼의 3D 위치·크기로 구성돼, 외부 시각 정보 없이도 충분히 상태를 파악한다.

보상 설계는 세 가지 요소로 나뉜다. (1) 개별 점프 성능을 평가하는 task reward, (2) 물리적 타당성과 부드러운 움직임을 유도하는 regularization reward, (3) 로봇 간 동기화를 촉진하는 공동 cooperation reward이다. 특히 cooperation reward는 비대칭 역할(‘런처’와 ‘점프어’)을 고려해 비행 단계에서 높이 차이를 최대화하고, 점프어가 착지 실패 시 패널티를 부여함으로써 신뢰성 있는 협동 행동을 학습한다.

학습 과정은 중력, 목표 높이, 초기 자세, 지연 시간 네 단계의 커리큘럼으로 구성된다. 초기 단계에서는 중력을 약화해 낮은 점프를 연습하게 하고, 점차 실제 중력과 높은 목표를 도입해 난이도를 상승시킨다. 이렇게 단계적 난이도 상승은 희소 보상 환경에서 탐색 효율을 크게 높이며, 정책이 급격히 불안정해지는 현상을 방지한다.

시뮬레이션 실험에서는 전방·측면·플립 등 다양한 방향의 Co‑jump을 성공시켰으며, 학습된 정책을 실제 로봇에 그대로 적용해 1.5 m 플랫폼 착지와 1.1 m 발끝 상승을 달성했다. 시뮬‑리얼 격차를 줄이기 위해 물리 엔진 파라미터 랜덤화와 관절 토크 제한을 적용했으며, 정책은 로봇 고유의 PD 제어 루프와 결합돼 실시간 제어에 적합했다.

본 연구는 (1) 외부 통신 없이 물리적 접촉만으로 고정밀 동기화를 이룰 수 있음을 증명, (2) 비대칭 협동 작업에서 credit assignment 문제를 공유 보상과 커리큘럼으로 효과적으로 해결, (3) 고임펄스 동적 행동을 end‑to‑end MARL로 학습함으로써 기존 계층적 플래너가 갖는 정보 손실을 회피한다는 점에서 의미가 크다. 다만 현재는 두 로봇에 한정된 실험이며, 역할이 고정된 비대칭 구조가 확장성에 제한을 줄 수 있다. 향후 다수 로봇, 다양한 지형, 그리고 제한된 통신 환경에서의 적용을 탐구하면 본 프레임워크의 일반화 가능성을 더욱 검증할 수 있을 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기