산업 규모 최적화 모델링을 위한 MIPLIB‑NL 벤치마크 구축

초록

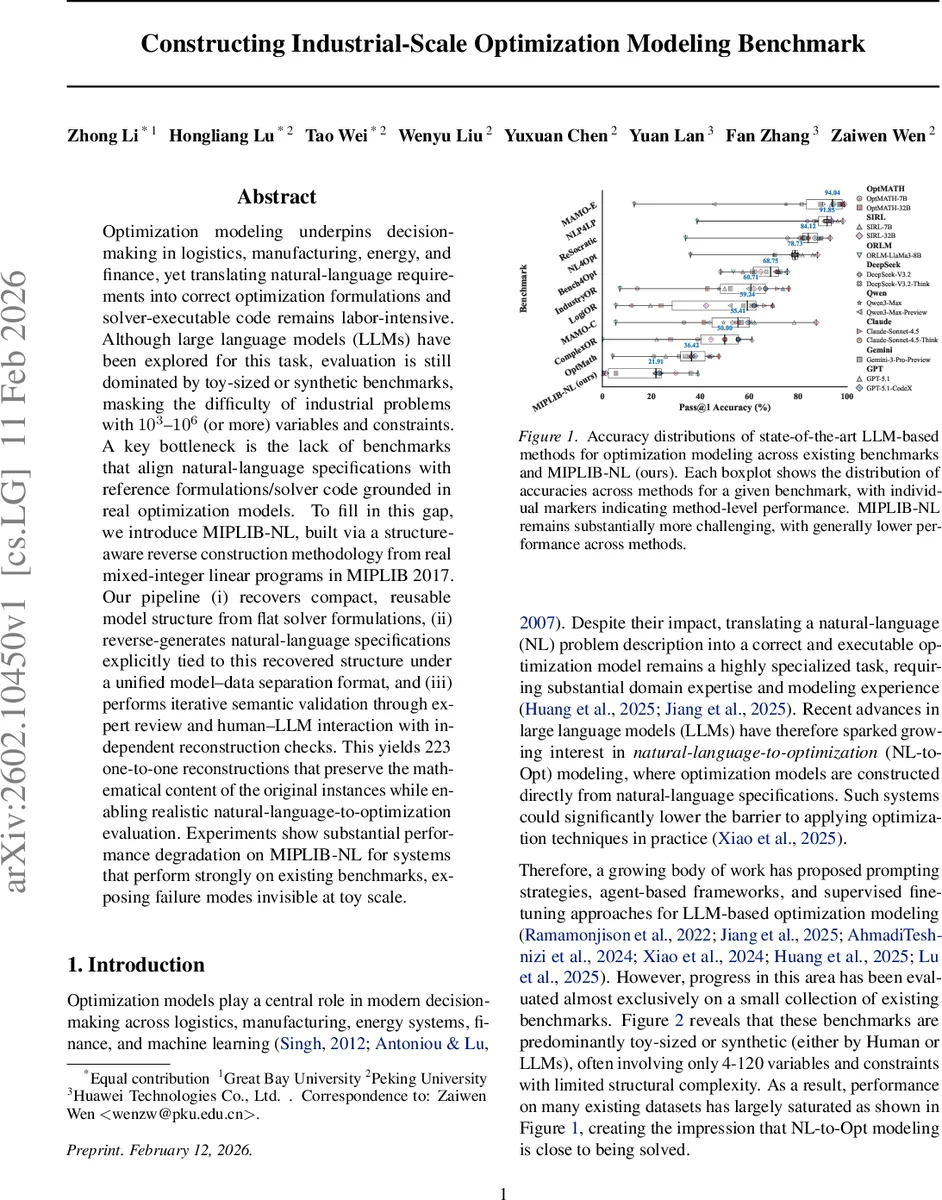

본 논문은 실제 산업용 MILP인 MIPLIB 2017을 기반으로, 모델 구조를 복원하고 역생성한 자연어 사양을 결합한 MIPLIB‑NL 벤치마크를 제시한다. 223개의 대규모 인스턴스를 제공하며, 기존 토이·합성 벤치마크에 비해 규모·구조·정확도 면에서 현저히 어려운 평가 환경을 만든다. 최신 LLM 기반 NL‑to‑Opt 시스템을 시험한 결과, 기존 벤치마크에서는 높은 정확도를 보였던 모델들이 MIPLIB‑NL에서는 크게 성능이 저하됨을 확인한다.

상세 분석

이 연구는 “데이터 중심” 접근법을 채택해, 자연어‑to‑최적화(NL‑to‑Opt) 평가에 필요한 벤치마크를 실제 산업 모델에서 직접 도출한다는 점에서 혁신적이다. 먼저 MIPLIB 2017에 포함된 .mps 파일을 전문가가 주도하는 구조 추출 파이프라인을 통해 변수 그룹과 제약 패밀리를 식별하고, 이를 루프 기반의 고수준 스키마로 압축한다. 기존 연구가 주로 원자적 제약 유형(예: 경계, 선형합)만을 활용해 작은 문제를 다루는 반면, 이 논문은 인덱스 집합 위에 반복되는 제약 패밀리를 명시적으로 복원함으로써 수천~수백만 규모의 변수·제약을 자연스럽게 표현한다.

복원된 구조를 바탕으로 전문가가 설계한 “블루프린트”를 이용해 자연어 사양을 자동 생성한다. 여기서 모델‑데이터 분리를 엄격히 유지해, 자연어 설명은 모델의 논리적 골격만을 기술하고, 구체적인 파라미터와 데이터는 별도 구조화 파일에 담는다. 이렇게 하면 자연어 텍스트가 지나치게 길어지는 것을 방지하면서도, 인간과 LLM이 동일한 구조적 정보를 공유하도록 만든다.

생성된 NL‑Opt 쌍은 독립적인 재구성 검증 단계에서 인간 전문가와 LLM이 상호작용하며 검증된다. 재구성된 모델이 원본 MIPLIB 인스턴스와 수치·구조적으로 일치하는지 확인하고, 오류가 발견되면 블루프린트를 수정·재생성한다. 이 반복적 검증 절차는 223개의 고품질 인스턴스를 확보하는 데 핵심 역할을 한다.

벤치마크 구축 후, 최신 LLM(예: GPT‑4‑Turbo, Claude‑Sonnet, DeepSeek‑V3.2 등) 기반 NL‑to‑Opt 시스템을 기존 NL4Opt, IndustryOR, ComplexOR 등과 동일한 평가 프로토콜로 시험한다. 결과는 기존 토이·합성 벤치마크에서는 80% 이상 정확도를 기록하던 모델들이 MIPLIB‑NL에서는 30% 이하로 급락함을 보여준다. 특히 인덱스 기반 제약 패밀리와 대규모 변수 집합을 정확히 매핑하지 못하는 경우가 빈번했으며, 이는 현재 LLM이 “구조 인식” 능력에 한계가 있음을 시사한다.

이 논문의 주요 기여는 (1) 산업용 MILP를 직접 활용한 데이터‑중심 벤치마크 설계, (2) 구조‑인식 역생성 파이프라인, (3) 모델‑데이터 분리 형식의 자연어 사양 제공, (4) 대규모 실험을 통한 현행 LLM의 한계 진단이다. 향후 연구는 구조‑인식 프롬프트 설계, 멀티‑모달 입력(예: 그래프 형태 인덱스) 활용, 그리고 자동 블루프린트 생성 기술을 통해 NL‑to‑Opt 성능을 향상시키는 방향으로 진행될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기