mmWave 레이더 기반 로봇 물 붓기 실시간 액체 레벨 추적 시스템

초록

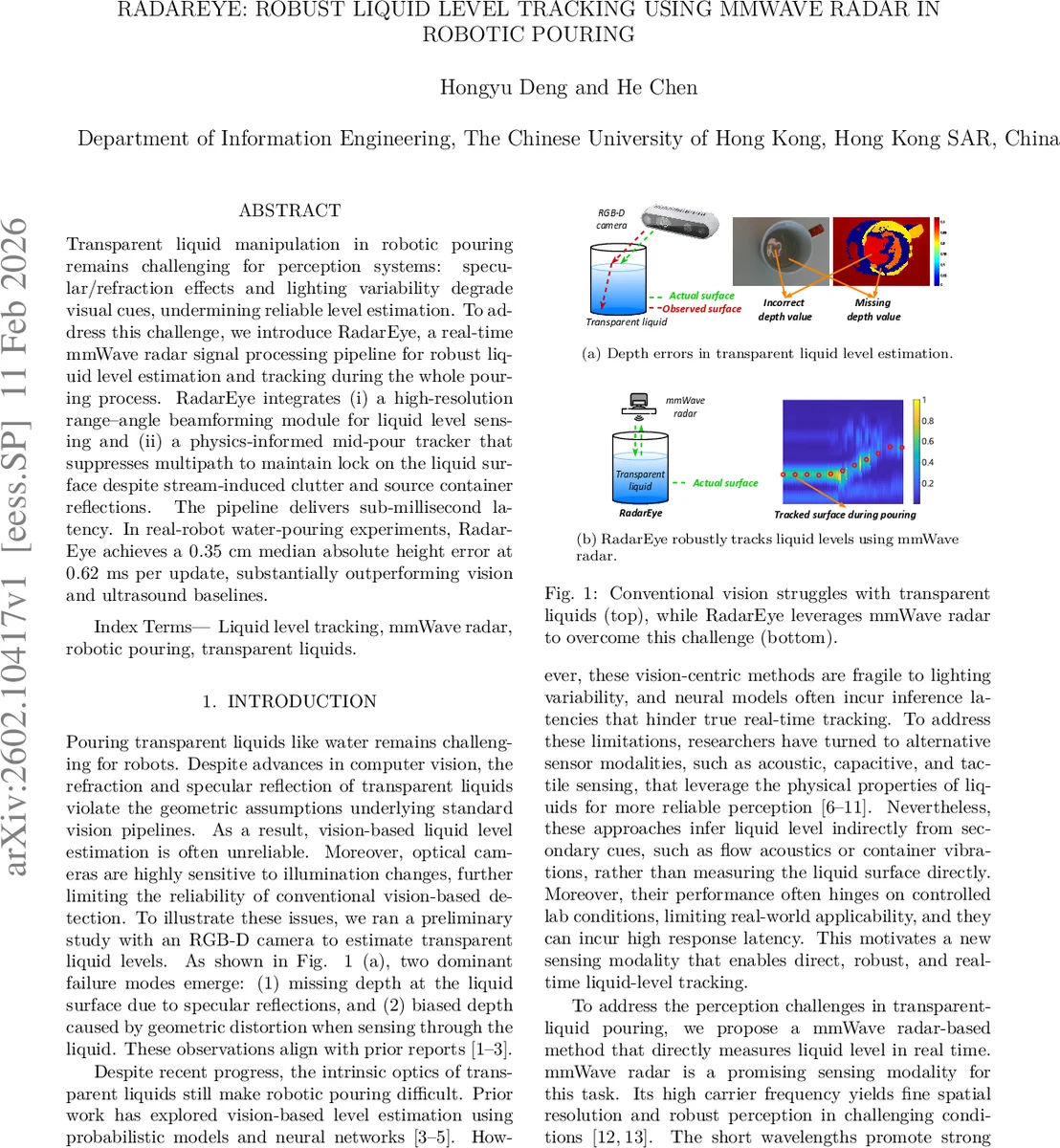

RadarEye는 61.8 GHz mmWave 레이더와 고해상도 AoA‑ToF 빔포밍을 이용해 투명 액체의 표면을 직접 측정한다. 물 흐름 중 발생하는 다중 경로와 잡음을 물리 기반 최적화 트래커로 억제해 0.35 cm의 중간 절대 오차와 0.62 ms의 서브밀리초 지연을 달성한다. 실험 결과, 기존 RGB‑D 비전 및 초음파 센서보다 크게 우수함을 보였다.

상세 분석

본 논문은 로봇 물 붓기 작업에서 투명 액체의 레벨을 정확히 추정하기 어려운 문제를 mmWave 레이더로 해결한다는 점에서 의미가 크다. 첫 번째 핵심은 1×4 Tx‑Rx 배열을 이용한 고해상도 범위‑각(AoA‑ToF) 스펙트럼을 생성하는 빔포밍 파이프라인이다. 수식 (1)‑(3)에서 제시된 신호 모델은 각 안테나와 주파수 샘플에 대한 위상 보정을 통해 특정 AoA‑ToF 격자점(i, j)의 복소합을 계산하고, 그 크기 pᵢ,ⱼ를 스펙트럼 P(i, j)로 만든다. 정적 상황에서는 액체 표면이 가장 강한 반사체가 되어 P의 최대값이 바로 액체 레벨에 해당한다. 그러나 붓는 동안 로봇 그리퍼, 소스 용기, 작업대 등에서 발생하는 다중 경로가 동일한 AoA‑ToF 영역에 겹치면서 단순 피크 선택이 실패한다.

이를 보완하기 위해 논문은 물리 기반 트래커를 설계한다. 시간 슬롯 t에서의 스펙트럼 Pₜ와 다음 슬롯 Pₜ₊₁ 사이의 전이 비용 cₜ((i,j)→(i′,j′))을 정의하고, 여기에는 두 스펙트럼 강도와 공간·시간 변위에 대한 정규화 항 η가 포함된다. η는 (i−i′)²·ωθ와 (j−j′)²·ωτ로 구성돼, 물리적으로 연속적인 액체 레벨 변화는 작은 비용을, 급격한 다중 경로 전이는 큰 비용을 부여한다. 이렇게 정의된 비용을 그래프 최단 경로 문제로 전환해 동적 프로그래밍 방식으로 최적 경로 δ*를 실시간으로 탐색한다. 탐색 범위를 Q² 이웃으로 제한해 연산량을 크게 줄였으며, 실제 구현에서는 0.6 ms 이하의 처리 시간을 확보한다.

시스템 구현은 TI IWR6843 레이더(61.8 GHz, 3.6 GHz 대역폭)와 Intel RealSense D435i 카메라를 3D 프린트 스탠드에 병렬 장착하고, ROS 기반 7‑DoF Reac hy 로봇 팔과 Python 인터페이스를 통해 통합하였다. 실험에서는 투명 용기 내부에 눈금자를 부착해 비디오 기반 지상 진실을 확보했고, 단계적 물 채우기와 연속 붓기 두 시나리오에서 RadarEye의 성능을 검증했다. 정적 단계에서는 평균 0.12 cm 오차, 동적 붓기에서는 0.35 cm 중간 절대 오차를 기록했으며, 비전 기반 방법(2.1 cm)과 초음파 기반 방법(4.3 cm)보다 현저히 우수했다. 또한, 동일 데이터에 대해 5‑peak 스무딩 알고리즘과 경량 딥러닝 모델을 비교했을 때, 딥러닝은 40 ms의 응답 지연을 보였으나 RadarEye와 스무딩은 0.6 ms 수준으로 실시간 요구에 부합했다.

이 연구는 mmWave 레이더가 투명 액체를 “불투명”하게 만들어 직접적인 표면 검출이 가능함을 실증하고, 물리 기반 최적화가 다중 경로 억제에 효과적임을 보여준다. 다만 현재는 물의 전도성 및 용기 형태에 대한 일반화 검증이 부족하고, 레이더 안테나 배치와 파라미터 튜닝이 실험 환경에 의존한다는 한계가 있다. 향후 다양한 액체(예: 오일, 점성액)와 복합적인 작업 환경에서의 적응형 모델링, 그리고 레이더‑비전 융합을 통한 다중 센서 보강이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기