Transformer에서 정규화 제거를 위한 게이트 기반 TaperNorm 기법

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

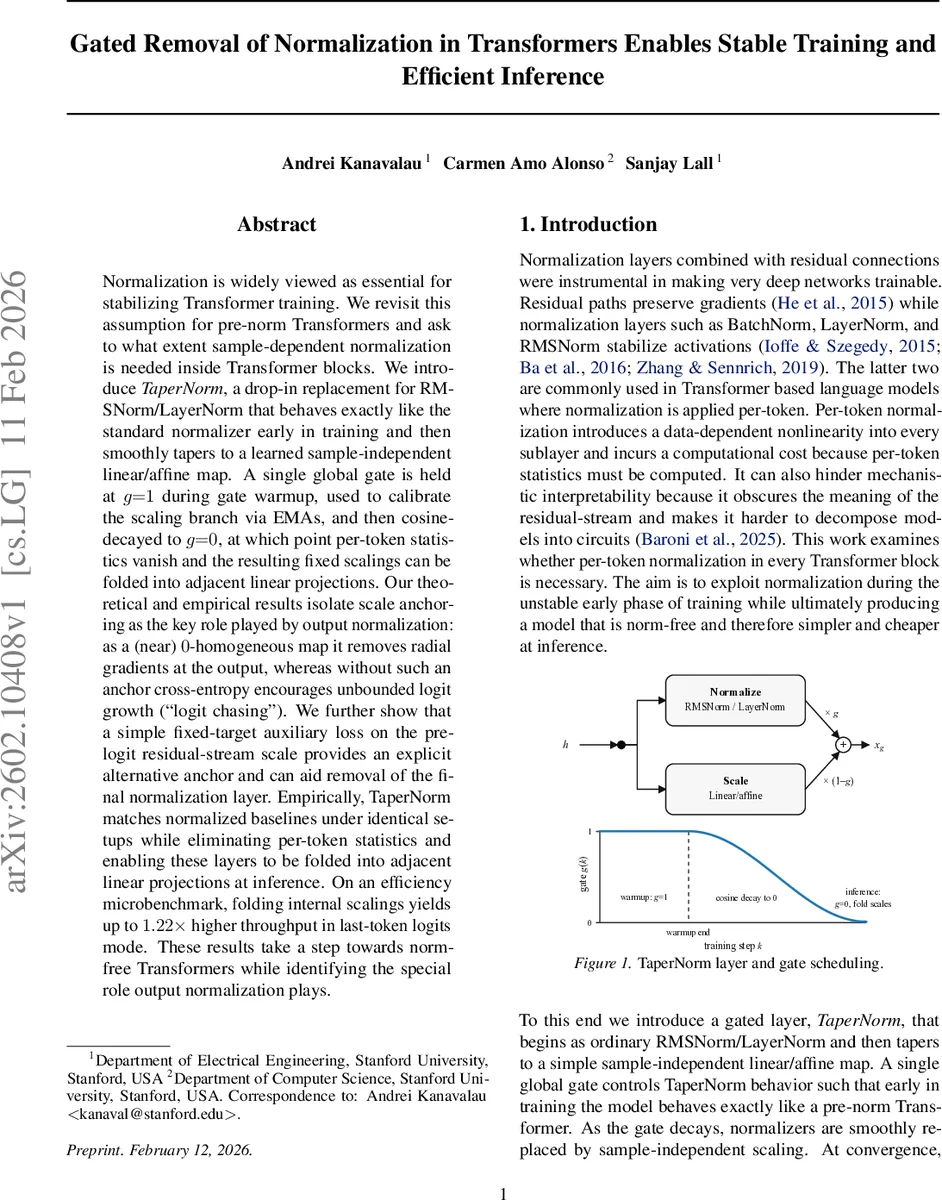

본 논문은 사전 정규화(pre‑norm) Transformer에서 토큰별 정규화가 반드시 필요하지 않음을 보이고, 초기 학습 안정성을 유지하면서 점진적으로 정규화 연산을 고정된 선형/affine 변환으로 전이시키는 TaperNorm을 제안한다. 전역 게이트 g를 1에서 0으로 코사인 감쇠시키며, g = 0이 되면 토큰별 통계가 사라지고 해당 스케일링을 인접 선형 계층에 합칠 수 있어 추론 시 연산량과 메모리를 절감한다. 이 과정에서 출력 정규화가 제공하는 “스케일 앵커” 역할을 이론적으로 분석하고, 고정 목표 보조 손실을 통해 동일한 앵커 효과를 명시적으로 제공함으로써 최종 정규화까지도 제거할 수 있음을 실험적으로 확인한다.

상세 분석

TaperNorm은 기존 RMSNorm·LayerNorm과 완전 호환되는 드롭인 레이어로, 두 개의 브랜치를 선형 결합한다. 첫 번째 브랜치는 표준 정규화 h · r(h)·Dγ(또는 Dβ)와 같이 토큰별 평균·분산을 이용해 입력을 스케일링하고, 두 번째 브랜치는 학습 가능한 스칼라 c와 피처별 게인 \tildeγ를 곱한 단순 선형 변환이다. 전역 게이트 g∈

댓글 및 학술 토론

Loading comments...

의견 남기기