시각·언어 기반 고급 보행 정책 적응을 위한 LocoVLM

초록

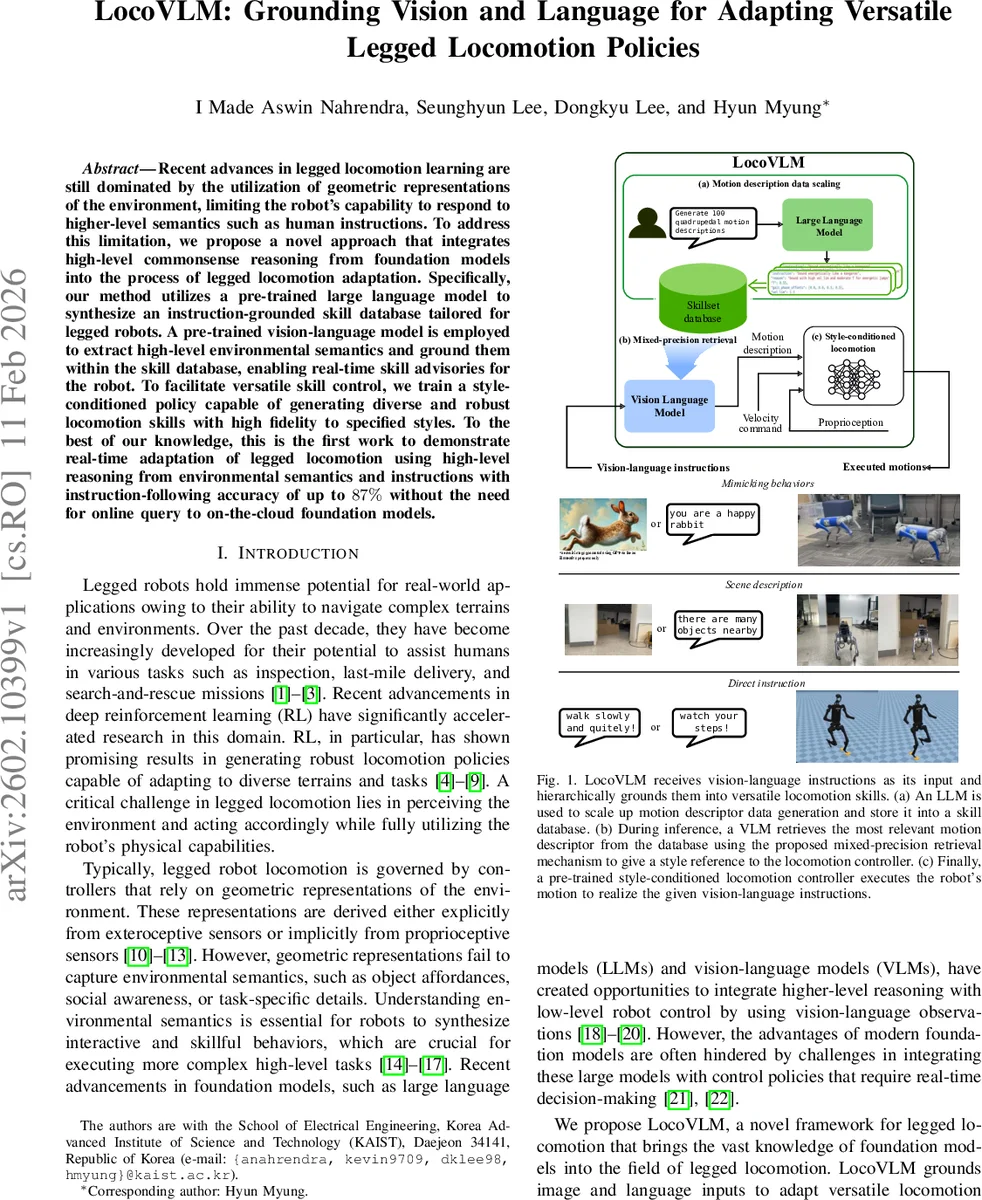

LocoVLM은 대형 언어 모델(LLM)과 시각‑언어 모델(VLM)을 활용해 인간의 고수준 명령을 로봇의 보행 스타일로 실시간 변환한다. LLM으로 생성한 100여 개의 명령‑동작 매핑 데이터베이스를 구축하고, VLM으로 입력된 텍스트·이미지를 데이터베이스와 매칭해 가장 적합한 동작 파라미터를 추출한다. 스타일‑조건부 보행 정책은 보행 주기와 위상 오프셋을 파라미터화하고, 컴플라이언스 접촉 트래킹을 도입해 안정성을 유지한다. 실험 결과, 클라우드 호출 없이도 87% 수준의 명령 수행 정확도를 달성했다.

상세 분석

본 논문은 기존 다리 로봇이 지오메트리 기반 환경 인식에 머무는 한계를 극복하고, 인간이 제공하는 고수준 의미론적 명령을 직접적인 보행 스타일로 변환하는 프레임워크를 제시한다. 핵심 아이디어는 세 단계로 구성된다. 첫째, 사전 학습된 대형 언어 모델(GPT‑4o)을 이용해 “명령‑동작 서술” 쌍을 자동 생성한다. 여기서 명령은 상황 설명, 행동 모방, 직접 지시 등 세 카테고리로 구분되며, 각 명령에 대해 gait‑phase 오프셋 ψ와 주기 T, 최대 전진 속도 vₓ와 같은 구체적 파라미터를 포함한 motion descriptor를 부여한다. 둘째, 생성된 데이터베이스를 VLM(BLIP‑2) 기반의 혼합 정밀도 검색 알고리즘에 연결한다. 입력이 텍스트이든 이미지이든 VLM이 임베딩을 추출하고, 먼저 코사인 유사도로 후보 K개를 선정한 뒤 ITM 헤드를 통해 최종 매칭을 수행한다. 이때 텍스트를 이미지로 렌더링해 “텍스트‑이미지” 형태로 VLM에 입력함으로써 텍스트‑텍스트 관계보다 높은 매칭 정확도를 얻는다. 셋째, 스타일‑조건부 보행 정책은 기존 blind velocity‑conditioned 정책에 gait‑phase 인코딩 ϕ(t)=

댓글 및 학술 토론

Loading comments...

의견 남기기