무한 합성 환경으로 에이전트 학습을 확장하는 새로운 파이프라인

초록

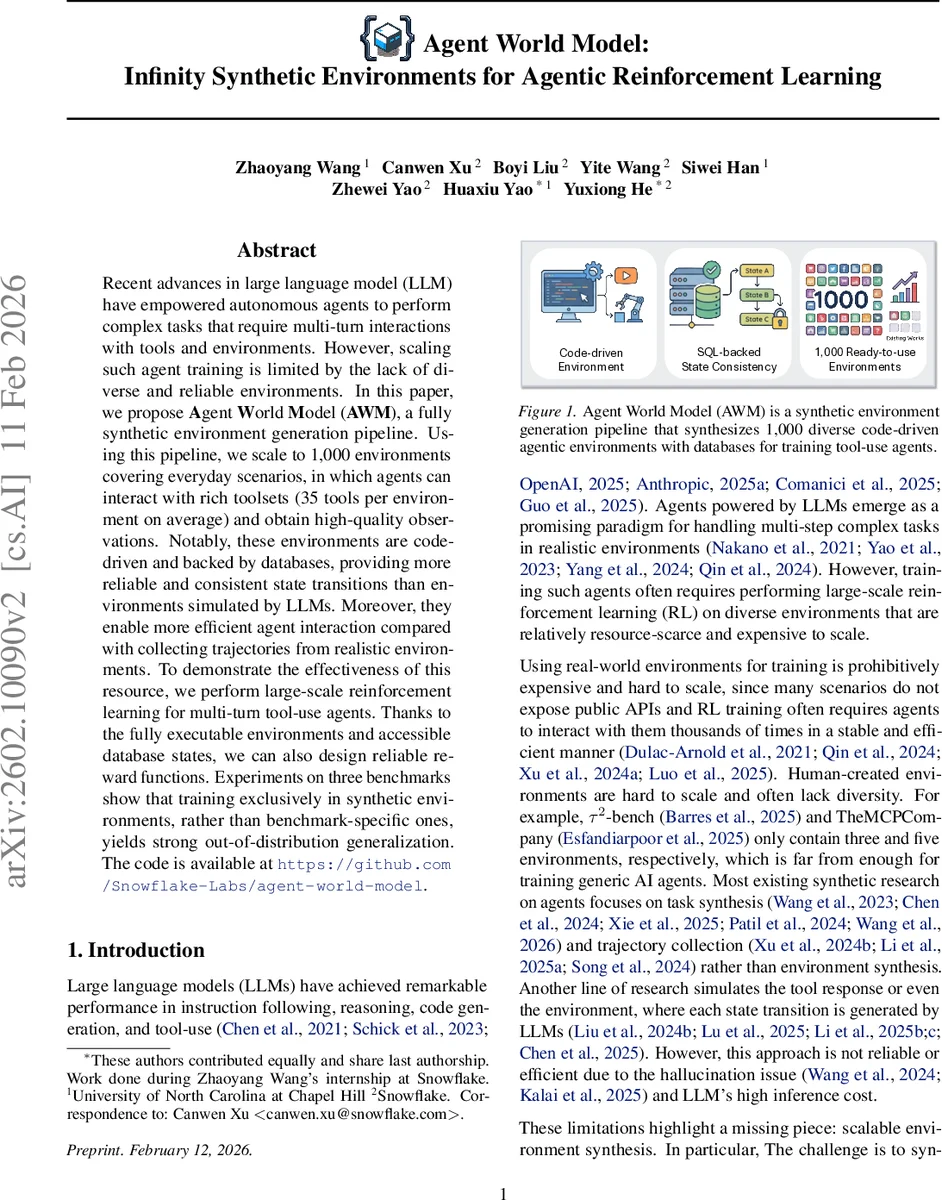

Agent World Model(AWM)은 코드‑구동·데이터베이스‑백엔드 기반의 1,000개 합성 환경을 자동 생성해, 도구 사용 에이전트를 대규모 강화학습으로 훈련한다. 환경은 일관된 상태 전이와 검증 가능한 보상을 제공하며, 실제 벤치마크와는 별개로 학습된 에이전트가 OOD 상황에서도 강한 일반화를 보인다.

상세 분석

본 논문은 대규모 에이전트 학습에 필요한 “다양하고 신뢰할 수 있는” 환경이 부족하다는 문제를 인식하고, 완전 자동화된 합성 파이프라인인 Agent World Model(AWM)을 제안한다. AWM은 시나리오 생성 → 작업(태스크) 생성 → 데이터베이스 스키마·샘플 데이터 설계 → MCP 기반 툴 인터페이스 코드 생성 → 검증·보상 함수 구현의 5단계를 순차적으로 수행한다. 각 단계는 LLM을 활용하되, 생성된 코드가 실행되지 않을 경우 오류 정보를 다시 LLM에 피드백해 self‑correction을 수행한다는 점이 핵심이다.

특히 데이터베이스를 상태 공간으로 사용함으로써 전통적인 LLM‑시뮬레이션 방식에서 발생하는 “hallucination” 문제를 근본적으로 차단한다. SQLite를 백엔드로 선택해 관계형 제약조건을 명시하고, 초기 샘플 데이터를 자동 생성해 모든 태스크가 시작 단계부터 실행 가능하도록 만든다. 툴 인터페이스는 Model Context Protocol(MCP) 형태로 노출되어, 에이전트는 “툴 호출 → DB 읽기/쓰기 → 관찰 반환”이라는 명확한 POMDP 전이 함수를 경험한다.

보상 설계는 두 층으로 구성된다. 첫 번째는 코드 기반 검증 모듈이 사전·사후 DB 상태를 비교해 성공 여부를 판단하고, 두 번째는 LLM‑as‑a‑Judge가 검증 결과와 에이전트 트래젝터리를 종합해 최종 보상을 산출한다. 이중 검증 구조는 환경 결함(예: 코드 오류, 타임아웃)에도 강인한 학습 신호를 제공한다.

실험에서는 1,024개의 환경 인스턴스를 병렬로 운영하며 대규모 RL(예: PPO, SAC 변형) 학습을 수행했다. 세 가지 공개 툴‑사용 벤치마크(예: WebShop, API‑Bench, ToolEval)에 대해, AWM에서만 학습한 에이전트가 기존 베이스라인보다 높은 OOD 성능을 기록했으며, 실제 API 기반 환경에서도 전이 가능함을 보였다. 이는 “특정 벤치마크에 맞춘 환경”이 아니라 “시나리오‑작업‑스키마‑툴‑검증”이라는 일반화 가능한 설계가 효과적임을 입증한다.

또한, 코드‑기반 환경은 에이전트‑환경 인터랙션 비용을 크게 낮춘다. 기존 LLM‑시뮬레이션은 매 스텝마다 거대한 언어 모델 호출이 필요했지만, AWM은 툴 호출당 단일 파이썬 함수 실행만으로 충분해, 학습 속도가 수십 배 가량 향상된다.

한계점으로는 현재 스키마·툴 설계가 LLM에 크게 의존한다는 점과, 복잡한 트랜잭션·동시성 제어가 필요한 시나리오에서는 SQLite의 한계가 드러날 수 있다는 점을 언급한다. 향후에는 멀티‑모델 협업(LLM + 코드‑전문가)과 더 강력한 DBMS(예: PostgreSQL) 연동을 통해 확장성을 높일 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기