클리니컬 정렬의 새로운 패러다임 ClinAlign과 HealthPrinciples

초록

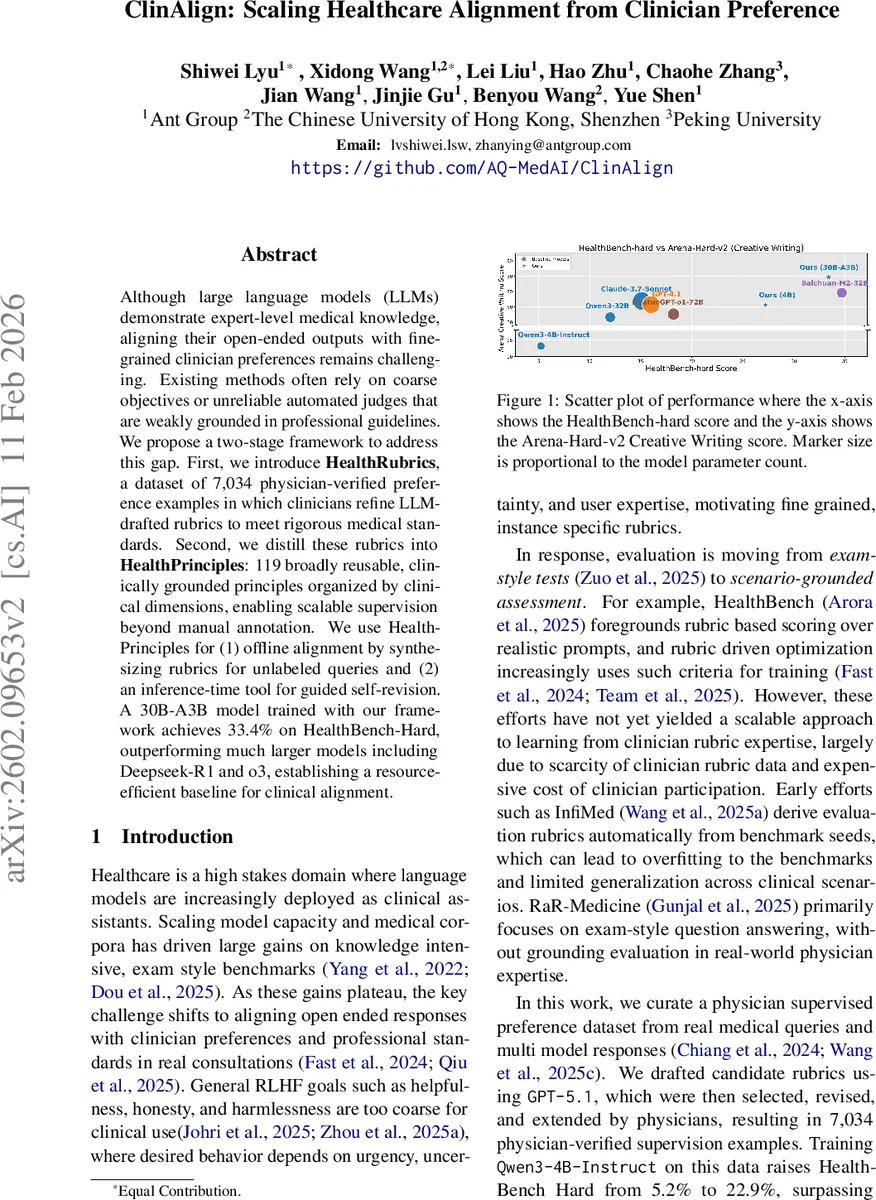

ClinAlign은 의사 검증 루브릭 7,034개와 119개의 재사용 가능한 HealthPrinciples를 활용해 의료 LLM을 정밀하게 정렬한다. 30B‑A3B 모델은 HealthBench‑Hard에서 33.4%를 달성해 대형 상용 모델들을 능가한다.

상세 분석

본 논문은 의료 분야에서 대형 언어 모델(LLM)의 출력이 임상 현장의 세밀한 선호와 규범에 부합하도록 정렬하는 문제에 초점을 맞춘다. 기존 RLHF 기반 접근법은 ‘유용성·정직·무해성’ 등 거친 목표에 머물러, 급박성, 불확실성, 사용자 전문성 등 상황별 변수를 반영하지 못한다는 한계가 있다. 이를 극복하기 위해 저자들은 두 단계 프레임워크를 제안한다. 첫 단계인 HealthRubrics는 실제 의료 질의와 다중 모델 응답을 수집한 뒤, GPT‑5.1이 초안 루브릭을 생성하고, 111명의 임상의가 반복 검토·수정·합의를 거쳐 7,034개의 고품질 루브릭을 완성한다. 루브릭은 안전성, 사실성, 불확실성 처리, 완전성, 명료성 등을 체크리스트 형태로 명시하며, JSON 스키마로 표준화돼 자동 파싱이 가능하도록 설계되었다. 두 번째 단계인 HealthPrinciples는 이러한 루브릭에서 반복적으로 등장하는 패턴을 추출·군집화해 119개의 원칙으로 압축한다. 원칙은 ‘긴급성(비응급·조건부 응급·응급)’, ‘불확실성(충분·감소가능·불가감소)’, ‘사용자 전문성(비전문·전문)’, ‘작업 유형(21개 카테고리)’이라는 네 차원의 택소노미에 매핑된다. 원칙은 인간 검증을 거쳐 합의에 도달했으며, 새로운 질의에 대해 GPT‑5.1이 해당 차원 라벨을 예측하고, 관련 원칙을 조합해 자동으로 루브릭을 생성한다. 이렇게 생성된 루브릭은 오프라인 정렬(offline alignment) 데이터로 활용되거나, 추론 시 모델 자체가 자체 수정(self‑revision) 과정을 수행하도록 가이드한다. 실험에서는 30B‑A3B 모델을 HealthRubrics와 HealthPrinciples 기반 데이터 16,872개로 추가 학습시켜 HealthBench‑Hard에서 33.4% 점수를 기록했으며, 파라미터 수가 2배 이상 큰 DeepSeek‑R1·o3 등을 앞섰다. 특히, 기존 SFT가 2에폭만에 성능이 정체되는 반면, 원칙 기반 루브릭 강화는 지속적인 성능 향상을 보였다. 한계점으로는 원칙 설계 시 전문가 의견에 크게 의존해 문화·지역적 편향이 남을 수 있고, 자동 라벨링 단계에서 GPT‑5.1의 오류 전파 위험이 존재한다는 점을 들 수 있다. 향후 다국어·다문화 임상 데이터와 인간‑인간 피드백 루프를 결합해 원칙의 일반화력을 강화하고, 실시간 환자-의사 인터랙션에 적용하는 연구가 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기