접두어 편향을 없애는 오픈보캘러리 키워드 스팟팅

초록

오픈보캘러리 키워드 스팟팅(OV‑KWS)에서 앞부분 음소에 과도하게 가중치가 부여되는 ‘접두어 편향’ 문제를 발견하고, 이를 해결하기 위해 부분 겹침 벤치마크(POB)와 위치 가중치를 균등하게 하는 EPS(Equal‑weighting Position Scoring) 모듈을 제안한다. EPS만 적용해도 POB‑Spark에서 EER을 64.4 %→29.3 %로, POB‑LP에서 정확도를 87.6 %→96.8 %로 크게 개선하면서 기존 LibriPhrase와 Google Speech Commands(GSC) 성능은 거의 유지한다. POB 데이터를 추가 학습하면 최종 성능이 최고가 되지만, GSC와 같은 단어‑단위 명령에서는 약간의 성능 저하가 나타난다.

상세 분석

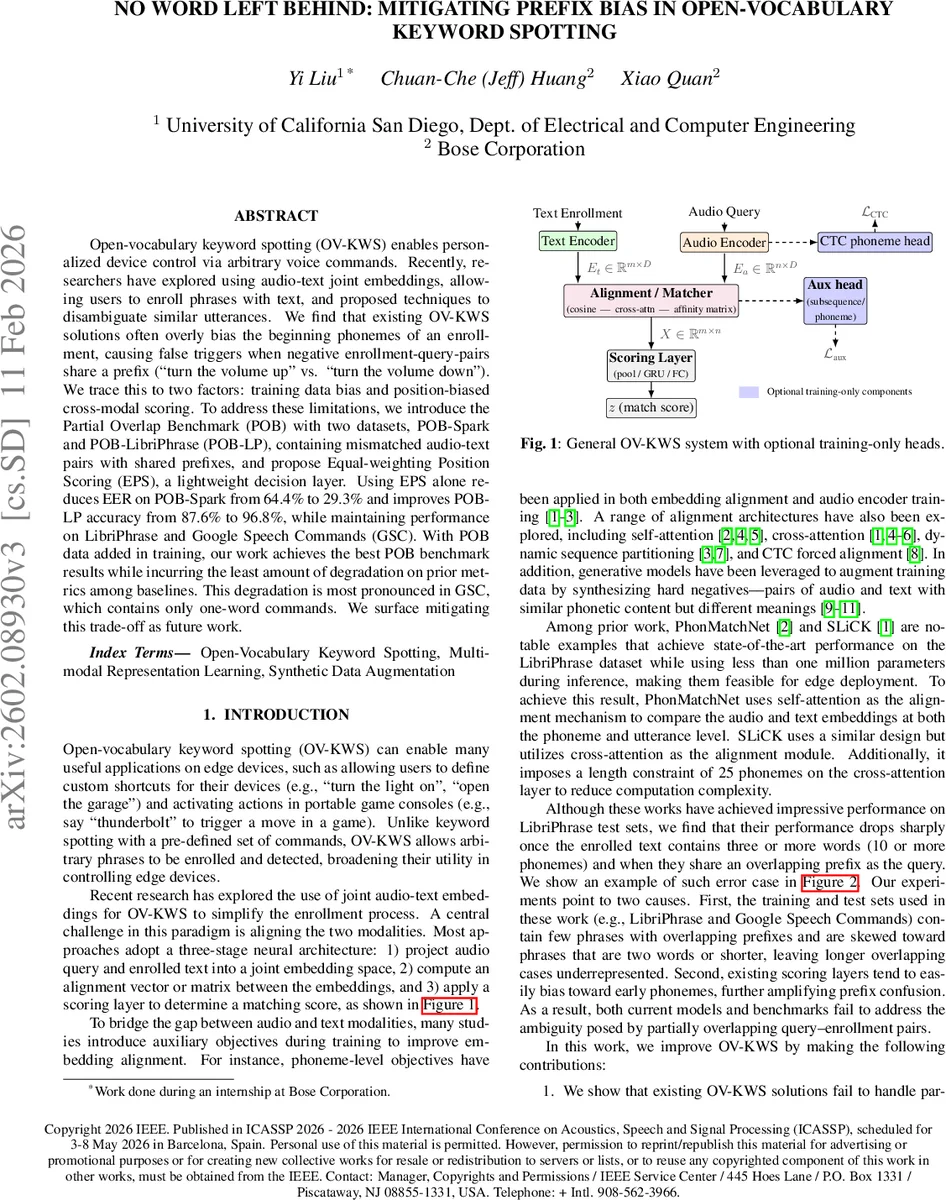

본 논문은 OV‑KWS 시스템이 실제 사용자 환경에서 마주칠 수 있는 “접두어 편향” 현상을 체계적으로 분석한다. 기존의 대표적인 모델인 PhonMatchNet과 SLiCK은 오디오‑텍스트 정렬 후 위치별 가중치를 학습하는 전형적인 구조를 갖는데, 이때 초기 몇 개의 음소에 높은 가중치가 집중되는 경향이 있다. 저자들은 “부분 겹침(partial overlap)”을 수학적으로 정의하고, LibriPhrase 데이터셋이 실제 사용 시 자주 발생하는 긴 구문·공통 접두어 상황을 충분히 포함하지 못한다는 점을 지적한다. 이를 검증하기 위해 두 개의 새로운 벤치마크, POB‑LP(기존 LibriPhrase에 접두어를 인위적으로 추가)와 POB‑Spark(최신 TTS 모델인 Spark‑TTS로 합성한 데이터)를 구축하였다. 두 데이터셋은 첫 번째 다른 음소 인덱스가 크게 분포하도록 설계돼, 모델이 초반부만 일치하고 뒤쪽이 다른 경우를 많이 포함한다.

접두어 편향을 정량화하기 위해 “접두어 집중도 ρ(k)”를 도입했으며, 기존 모델은 ρ(k)가 급격히 상승해 초반 위치에 과도한 가중치를 부여함을 시각화했다. 이를 완화하기 위한 핵심 아이디어가 EPS 모듈이다. EPS는 정렬 단계에서 얻은 m × n 형태의 위치별 특징 행렬 X에 대해, 각 위치에 동일한 선형 변환 w를 적용하고 평균 풀링을 수행한다. 즉, z_i = wᵀX_i 로 얻은 스칼라들을 평균해 최종 점수를 산출함으로써 위치 가중치를 균등하게 만든다. 이 설계는 파라미터 수를 전혀 늘리지 않으며, 기존 파이프라인의 나머지 부분을 그대로 유지한다. 실험 결과, SLiCK‑EPS는 POB‑Spark에서 EER을 35.1 %p 감소시켰고, POB‑LP에서는 정확도가 9.2 %p 상승했다. 또한 LibriPhrase‑easy, LibriPhrase‑hard, GSC와 같은 기존 벤치마크에서는 성능 저하가 거의 없었다(오히려 미세하게 향상). POB 데이터를 학습에 추가하면 모든 모델이 POB 성능을 크게 끌어올리지만, GSC와 같은 단어‑단위 명령에서는 약 1‑2 %p 정도 정확도 감소가 관찰되었다. 이는 “접두어 편향을 없애는” 것이 단어 길이가 짧은 상황에서는 불필요한 일반화 비용을 초래할 수 있음을 시사한다. 저자들은 향후 가중치 정규화나 동적 어텐션을 도입해 다양한 길이의 명령어에 대한 균형을 맞출 방안을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기