행동트리와 강화학습의 진보 제약 통합

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

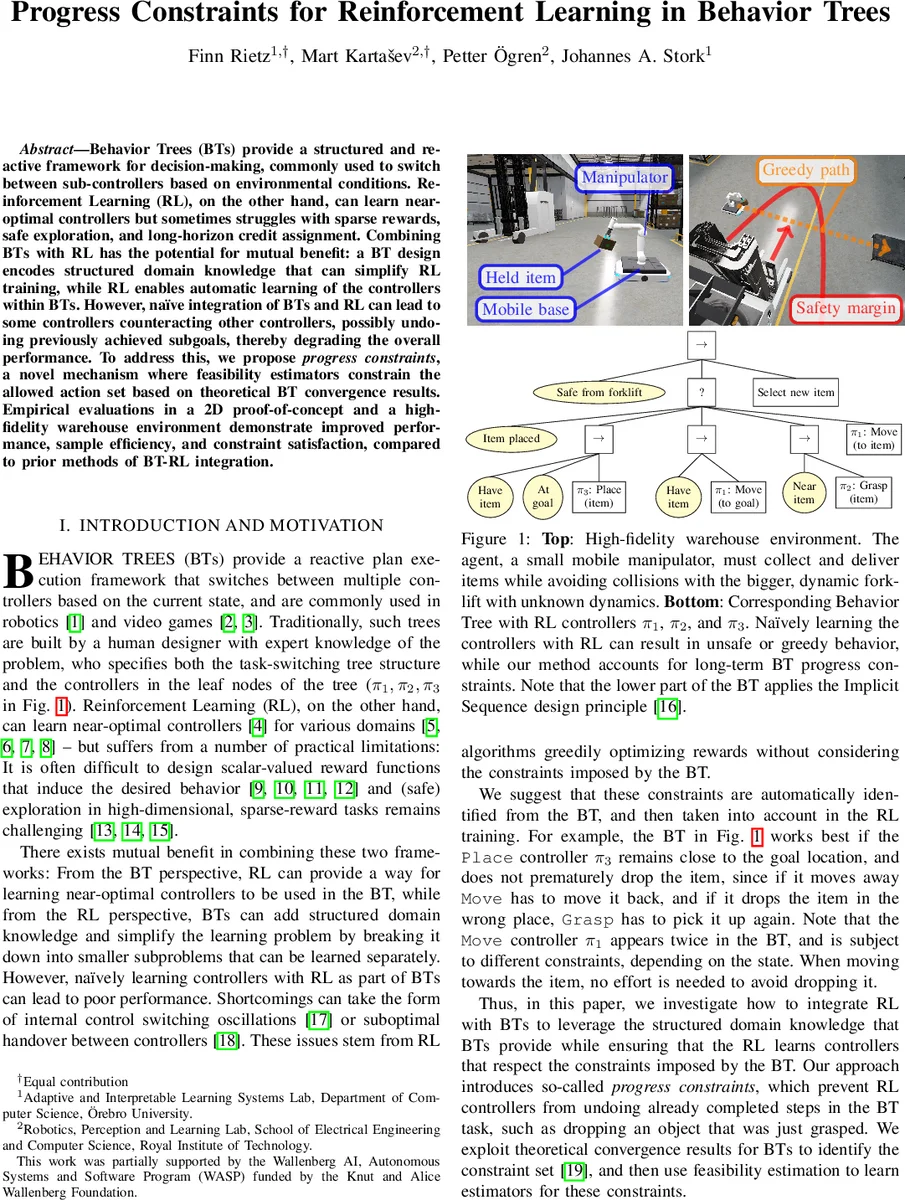

본 논문은 행동트리(BT)의 구조적 지식을 활용해 강화학습(RL) 에이전트가 학습하는 동안 진행 제약(progress constraints)을 적용함으로써, 서로 다른 서브컨트롤러가 이미 달성한 하위 목표를 되돌리는 현상을 방지한다. 이 제약은 BT 수렴 이론에 기반한 ‘수렴 집합(convergence set)’을 추정하는 feasibility estimator를 통해 구현되며, 2D 시뮬레이션과 고충실도 물류 창고 환경에서 기존 BT‑RL 통합 방식보다 샘플 효율성과 성공률이 크게 향상됨을 실증한다.

상세 분석

이 연구는 행동트리(BT)의 수렴 특성을 정량화하고, 이를 강화학습(RL) 정책에 제약으로 삽입하는 새로운 메커니즘인 ‘진보 제약(progress constraints)’을 제안한다. 먼저 BT의 각 리프 노드 i에 대해 영향 영역(influence region) I_i와 실행 영역(operating region) Ω_i 를 정의하고, 기존 수렴 이론

댓글 및 학술 토론

Loading comments...

의견 남기기