LLM을 위한 동적 선호 최적화 통합 프레임워크 Uni‑DPO

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

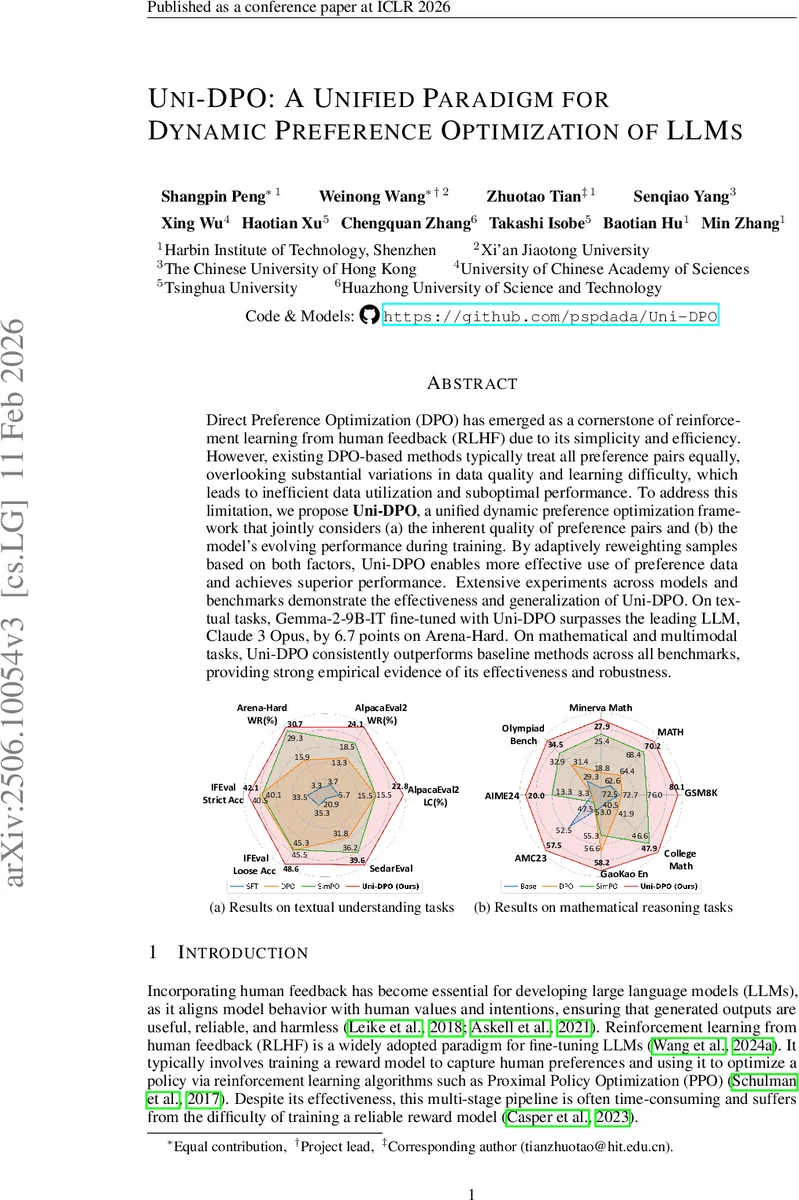

Uni‑DPO는 기존 DPO가 모든 선호 쌍을 동일하게 취급하는 한계를 극복하기 위해, 데이터 품질과 모델 학습 진행 상황을 동시에 고려한 동적 가중치 방식을 제안한다. 품질 기반 가중치 w₍qual₎와 성능 기반 가중치 w₍perf₎를 곱해 샘플을 재조정하고, 어려운 고품질 양성 샘플에 초점을 맞춘 보정된 음‑로그우도 손실(Lc‑NLL)을 추가한다. 텍스트, 수학, 멀티모달 벤치마크에서 기존 DPO·SimPO 대비 일관된 성능 향상을 보이며, 특히 Gemma‑2‑9B‑IT를 Arena‑Hard에서 Claude 3 Opus보다 6.7점 앞선다.

상세 분석

Uni‑DPO는 DPO가 “모든 선호 쌍은 동등하게 기여한다”는 암묵적 가정을 비판하고, 실제 인간 주석이나 모델‑라벨링 데이터가 품질 차이를 보인다는 점을 실험적·통계적으로 입증한다. 저자들은 두 가지 핵심 변수를 정의한다. 첫 번째는 품질 점수 차이 (S_w − S_l) 로, 인간 평가자 혹은 GPT‑4와 같은 강력한 모델이 부여한 스코어를 sigmoid · η 변환해 w₍qual₎ ∈

댓글 및 학술 토론

Loading comments...

의견 남기기