RAG 시스템의 스퓨리어스 특징에 대한 견고성 정량화와 향상

초록

본 논문은 검색 기반 생성(RAG) 모델이 문서 형식·스타일·메타데이터 등 의미와 무관한 스퓨리어스 특징에 취약함을 규명하고, 이를 자동으로 평가·합성하는 SURE 프레임워크와 경량 벤치마크 SIG_Wiki를 제안한다. 또한 합성 데이터를 활용한 두 가지 학습 기반 완화 전략을 통해 견고성을 크게 향상시켰다.

상세 분석

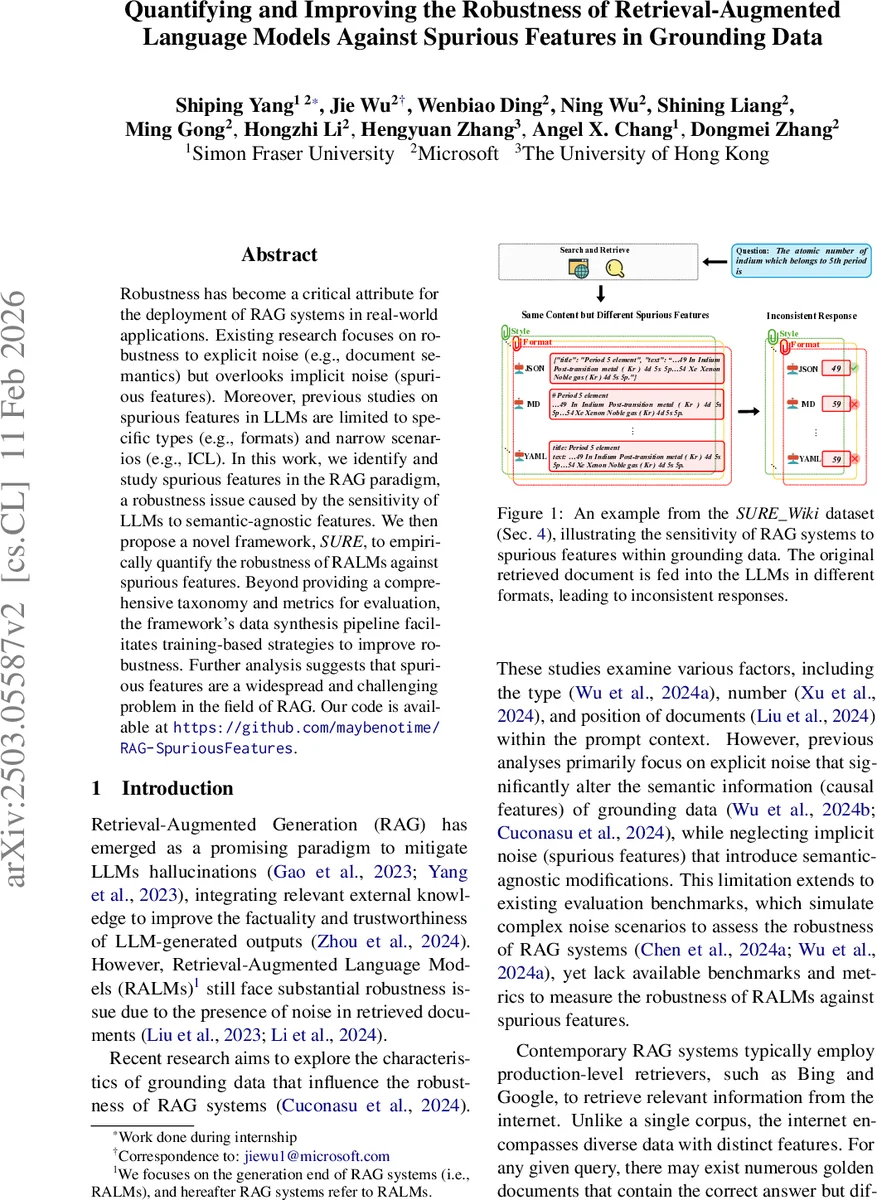

본 연구는 RAG(Retrieval‑Augmented Generation) 패러다임에서 “스퓨리어스 특징”(semantic‑agnostic features)이라는 새로운 위협 요인을 정의하고, 기존 연구가 주로 다루던 명시적 노이즈(문서 의미 변형)와는 구별되는 암묵적 노이즈를 체계적으로 분석한다. 저자들은 스퓨리어스 특징을 크게 다섯 가지 카테고리(Style, Source, Logic, Format, Metadata)와 13개의 세부 변형으로 분류하고, 각각이 LLM 기반 리더에 미치는 영향을 실험적으로 검증한다. 특히, 동일한 내용이지만 표현 방식이 달라지면(Low‑complex vs. High‑complex) 혹은 문서가 LLM이 생성한 텍스트인지 인간이 작성한 텍스트인지에 따라 모델의 답변 일관성이 크게 달라지는 현상을 발견하였다. 이는 검색 엔진이 제공하는 다양한 포맷(HTML, Markdown, JSON, YAML)이나 문서 순서(랜덤, 역순, LLM‑재정렬) 역시 모델의 추론에 비의도적 편향을 유발한다는 점을 시사한다.

SURE 프레임워크는 (1) 스퓨리어스 특징 자동 주입, (2) 인과적 특징(문서의 핵심 답변 정보) 보존, (3) 견고성 평가 메트릭(Win Rate, Lose Rate, Robustness Rate)이라는 세 단계로 구성된다. 자동 주입 단계에서는 LLM(주로 Llama‑3.1‑70B‑Instruct)과 규칙 기반 방법을 혼합해 원본 문서를 변형한다. 인과적 특징 보존을 위해 양방향 엔테일먼트(NLI)와 문자열 매칭을 활용해 의미 동등성을 검증하고, 정답이 파라프레이즈되었는지 확인한다. 평가 메트릭은 원본 프롬프트와 변형 프롬프트에 대한 모델 출력의 정답 포함 여부를 비교해, 스퓨리어스 특징이 모델 성능을 “이득”으로 바꾸는 경우와 “손실”로 만드는 경우를 정량화한다.

실험에서는 1,000개의 NQ‑Open 질의와 100,000개의 위키피디아 문서를 사용해 대규모 합성 데이터셋을 구축하고, 다양한 LLM(Claude‑2, GPT‑4, Llama‑2‑70B 등)과 RAG 파이프라인(Bing, Google, 자체 Dense Retriever)에서 SURE를 적용했다. 결과는 대부분의 모델이 스퓨리어스 특징에 대해 낮은 Robustness Rate를 보이며, 특히 Format과 Metadata 변형이 가장 큰 성능 저하를 일으켰음을 보여준다. 흥미롭게도 일부 스퓨리어스 특징(예: 간단한 스타일 변형)은 특정 모델에서 오히려 정확도를 높이는 “이득” 효과를 나타냈다.

완화 전략으로는 (a) 스퓨리어스 특징이 포함된 합성 데이터를 이용한 추가 파인튜닝, (b) 멀티‑태스크 학습에서 스퓨리어스 특징을 “무시”하도록 학습하는 두 가지 방법을 제안한다. 두 전략 모두 SIG_Wiki 벤치마크에서 평균 Robustness Rate를 12~18%p 상승시켰으며, 특히 Format 변형에 대한 내성이 크게 개선되었다.

본 논문의 주요 공헌은 (1) RAG 시스템에서 스퓨리어스 특징을 최초로 체계화·정량화한 점, (2) 자동화된 데이터 합성·평가 파이프라인인 SURE와 경량 벤치마크 SIG_Wiki를 제공한 점, (3) 합성 데이터를 활용한 실용적인 견고성 강화 방법을 제시한 점이다. 연구 결과는 향후 대규모 검색‑기반 생성 시스템이 실제 인터넷 환경에서 다양한 포맷·스타일·메타데이터에 노출될 때 신뢰성을 확보하는 데 중요한 기준이 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기