불확실성 분리의 맹점: 직교성 측정

초록

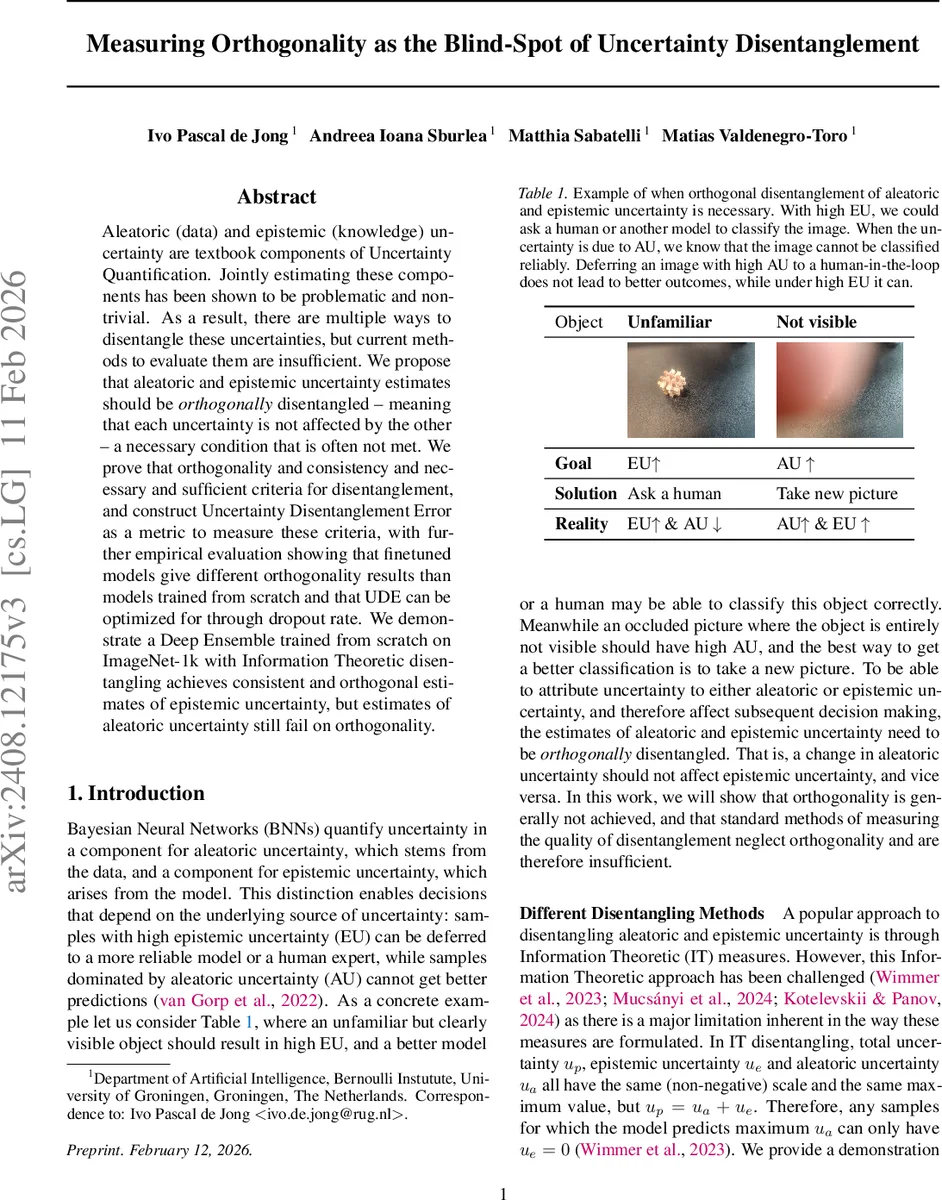

본 논문은 데이터(aleatoric)와 모델(epistemic) 불확실성을 동시에 추정할 때, 두 불확실성이 서로 영향을 주지 않아야 하는 ‘직교성’이 필수 조건임을 제시한다. 직교성과 일관성을 만족하는지 평가하기 위한 Uncertainty Disentanglement Error(UDE) 지표를 정의하고, 다양한 베이지안 신경망 근사법과 데이터셋에 대해 실험한다. 결과는 기존 방법이 일관성은 확보하지만 직교성은 대부분 실패한다는 것을 보여준다.

상세 분석

이 논문은 불확실성 정량화 분야에서 오랫동안 간과되어 온 ‘직교성(orthogonality)’ 개념을 체계화한다. 저자는 aleatoric 불확실성 Uₐ와 epistemic 불확실성 Uₑ가 각각 실제 데이터 노이즈와 모델 파라미터 불확실성을 반영한다는 전제를 바탕으로, 두 추정치 uₐ와 uₑ가 서로 독립적이어야 한다는 조건을 수학적으로 정의한다. 구체적으로 일관성(C1, C2)은 각각 uₐ ∝ Uₐ, uₑ ∝ Uₑ를 의미하고, 직교성(O1, O2)은 uₐ가 Uₑ에 의존하지 않으며, uₑ가 Uₐ에 의존하지 않음을 의미한다. 기존 연구들은 주로 일관성만을 검증했으며, 이는 총 불확실성 uₚ = uₐ + uₑ가 각각 Uₐ와 Uₑ와 상관관계를 가짐으로써 ‘거짓’ 일관성을 만들 수 있음을 저자는 ‘총 불확실성 함정(Total Uncertainty Trap)’이라는 정리로 증명한다.

이를 보완하기 위해 제안된 Uncertainty Disentanglement Error(UDE)는 두 실험을 기반한다. 첫 번째 실험은 학습 데이터 양을 변화시켜 epistemic 불확실성을 조절하고, 두 번째 실험은 라벨 노이즈를 추가해 aleatoric 불확실성을 조절한다. 각 실험에서 기대되는 정확도 변화와 추정된 uₑ, uₐ의 변화를 비교함으로써 직교성 위반 여부를 정량화한다.

실험에서는 MC‑Dropout, MC‑DropConnect, Deep Ensembles, Flipout 등 네 가지 베이지안 근사법을 CIFAR‑10, Fashion‑MNIST, UCI Wine, BCI 시계열 데이터에 적용하였다. 결과는 대부분의 설정에서 uₑ는 데이터 양 증가에 따라 감소하는 일관성을 보였지만, uₐ는 데이터 양이 늘어날수록 오히려 증가하는 비정상적인 패턴을 보여 직교성(O1)이 깨졌음을 확인한다. 특히 Information‑Theoretic(IT) 방식은 epistemic 불확실성은 직교적으로 추정하지만, aleatoric 불확실성은 여전히 epistemic에 영향을 받아 직교성을 만족하지 못한다. 반면 Gaussian Logits 방식은 두 불확실성을 모두 직교적으로 분리하지 못한다.

또한, 모델을 처음부터 학습한 경우와 사전학습된 모델을 fine‑tuning한 경우를 비교했을 때, fine‑tuning 모델이 직교성 점수가 현저히 낮아 데이터 특성에 대한 과적합이 직교성 손실을 초래한다는 점을 발견했다. dropout 비율을 조절하면 UDE를 최소화할 수 있음을 보이며, 최적의 dropout 비율은 모델 종류와 데이터셋에 따라 다르지만, 일반적으로 0.1~0.2 사이가 가장 좋은 직교성‑일관성 균형을 제공한다.

마지막으로 ImageNet‑1k 규모의 대규모 데이터셋에 Deep Ensemble + IT 방식을 적용한 결과, epistemic 불확실성은 직교적이고 일관되게 추정되었지만, aleatoric 불확실성은 여전히 epistemic과 상관관계를 보이며 직교성을 만족하지 못한다. 이는 복잡한 실세계 데이터에서는 aleatoric과 epistemic이 본질적으로 얽혀 있을 가능성을 시사한다.

전체적으로 이 논문은 불확실성 분리 평가에 새로운 기준을 제시하고, 기존 방법들의 한계를 명확히 드러내며, UDE라는 실용적인 메트릭을 통해 향후 연구가 직교성을 고려한 모델 설계로 나아가야 함을 설득력 있게 주장한다.

댓글 및 학술 토론

Loading comments...

의견 남기기