시점 일관성과 정체성 보존을 위한 이미지‑투‑비디오 생성 프레임워크 ConsID‑Gen

초록

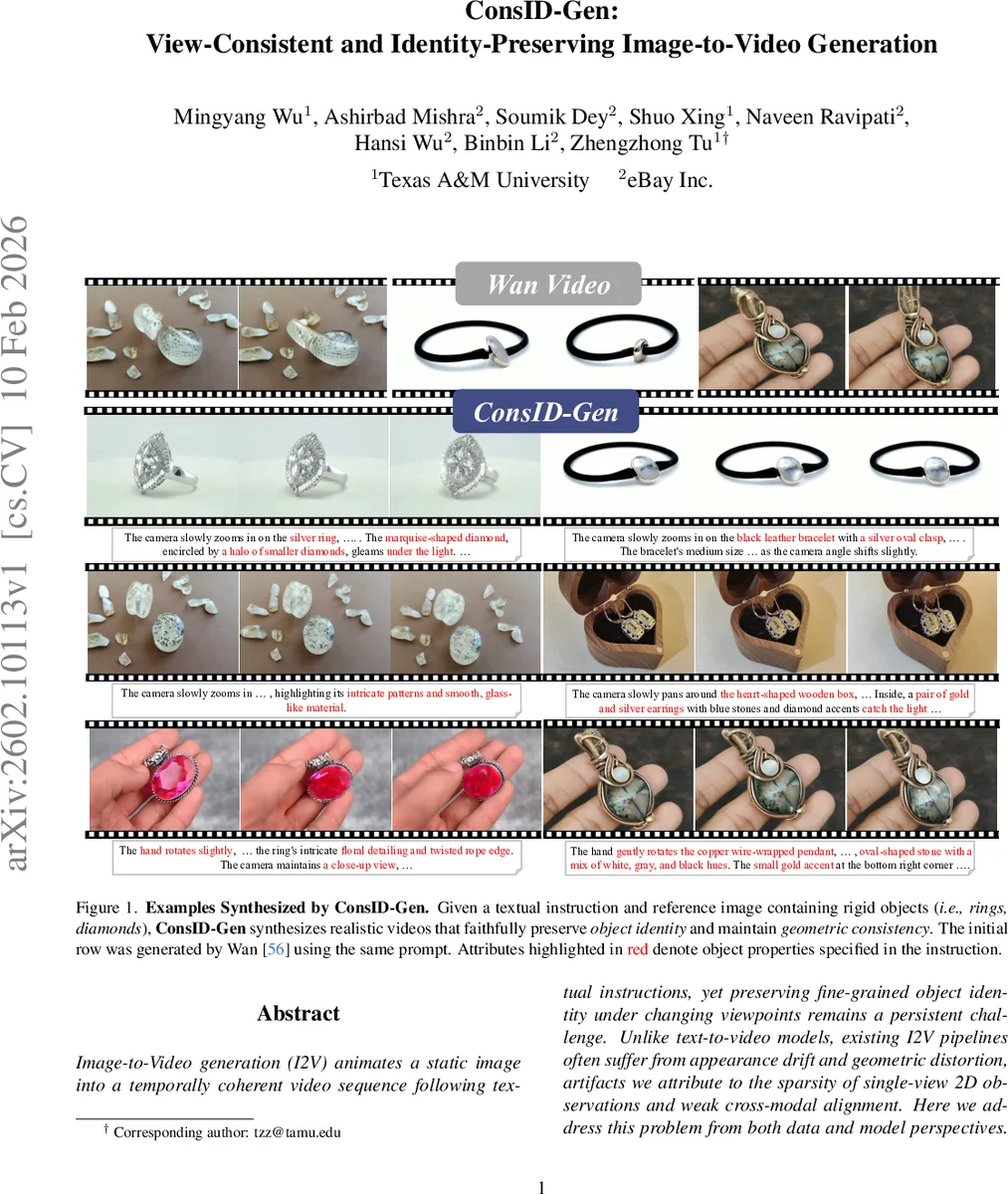

ConsID‑Gen은 단일 이미지와 텍스트 명령만으로 객체 정체성을 유지하면서 다중 시점에서 일관된 영상을 생성한다. 이를 위해 대규모 객체‑중심 데이터셋 ConsIDVid와 정밀한 다중‑시점 평가 지표를 구축하고, 보조 뷰와 기하 정보를 활용하는 듀얼‑스트림 시각‑기하 인코더와 텍스트‑시각 연결 모듈을 도입해 Diffusion Transformer에 통합한다. 실험 결과, 기존 최첨단 모델을 능가하는 정체성 보존 및 시간적 일관성을 달성한다.

상세 분석

본 논문은 이미지‑투‑비디오(I2V) 분야에서 가장 어려운 문제 중 하나인 “시점 변화에 따른 객체 정체성 유지”를 데이터와 모델 양측면에서 동시에 해결한다. 첫 번째 기여는 ConsIDVid 데이터셋이다. 기존 I2V 데이터는 단일 시점 혹은 저해상도 클립에 국한돼 있었지만, 저자들은 Co3D, OmniObject3D, Objectron 등 공개 데이터와 자체 수집한 전자상거래 영상, 합성 영상을 결합해 80시간 이상, 6만 개 이상의 고품질 객체‑중심 비디오를 구축했다. 특히 영상 길이 ≥81프레임, 최소 320p 해상도, 조명·블러·미학 점수 필터링 등 다단계 품질 검증 파이프라인을 적용해 노이즈를 최소화했다. 또한, 계층적 캡셔닝 방식을 도입해 Qwen2.5‑VL 모델로 객체 속성(색상, 재질, 형태 등)과 카메라 움직임을 명시적으로 기술한 텍스트‑비디오 쌍을 자동 생성한다. 이는 이후 모델 학습 시 텍스트‑시각 정렬을 강화한다.

두 번째 기여는 ConsID‑Gen 모델 아키텍처이다. 기존 I2V 모델은 첫 프레임 이미지와 텍스트를 별도로 인코딩한 뒤, 디퓨전 과정 중에 결합하는 방식으로, 시점 간 구조적 정보를 충분히 활용하지 못한다. ConsID‑Gen은 첫 프레임 외에 “unposed auxiliary views”(두 개의 무정렬 보조 이미지)를 추가 입력으로 받아, 이를 시각‑기하 듀얼 스트림 인코더에 투입한다. 시각 스트림은 CLIP‑계열 비주얼 인코더로 색감·텍스처 등 의미적 특징을 추출하고, 기하 스트림은 VGGT(Geometry Encoder)로 각 뷰 간 상대적 포즈와 깊이 정보를 토큰화한다. 이후 멀티모달 텍스트‑시각 연결 모듈이 텍스트 인코더(T5)와 시각·기하 토큰을 정교히 정렬해 “통합 조건 토큰”을 만든다. 이 토큰은 Diffusion Transformer(MMDiT) 백본에 주입되어, 디퓨전 과정 전반에 걸쳐 일관된 객체 정체성을 유지하도록 유도한다. 특히, 텍스트‑시각 사전 정렬(pre‑alignment) 단계가 기존 모델 대비 교차‑어텐션 효율을 크게 높이며, 기하 정보가 명시적으로 포함돼 시점 변화 시 형태 왜곡을 방지한다.

평가 측면에서는 ConsIDVid‑Bench을 제안한다. 기존 FVD·VBench 등은 전반적인 영상 품질만 측정하지만, 본 벤치는 Chamfer Distance, Multi‑Modal MMD, 그리고 객체 레벨의 메트릭(MET3R) 등을 도입해 미세한 기하·외관 변화를 정량화한다. 실험 결과, ConsID‑Gen은 공개 베이스라인인 Wan2.1, HunyuanVideo 등을 넘어 MET3R에서 30.2% 개선, Chamfer Distance에서 7.26% 감소를 기록했다. 인간 평가에서도 “정체성 보존” 항목에서 92.5% 이상의 선호도를 얻었다. 또한, ablation study를 통해 보조 뷰 수, 기하 인코더 유무, 텍스트‑시각 연결 방식이 성능에 미치는 영향을 체계적으로 분석했다. 전체적으로 데이터 규모·다양성, 정교한 멀티모달 정렬, 기하 정보 활용이라는 세 축이 시너지 효과를 발휘해 I2V 분야의 정체성 보존 한계를 크게 낮춘 것으로 평가된다.

댓글 및 학술 토론

Loading comments...

의견 남기기