에고휴머노이드 인간 시점 시연으로 야생 환경에서 인간형 로봇의 이동·조작 학습

초록

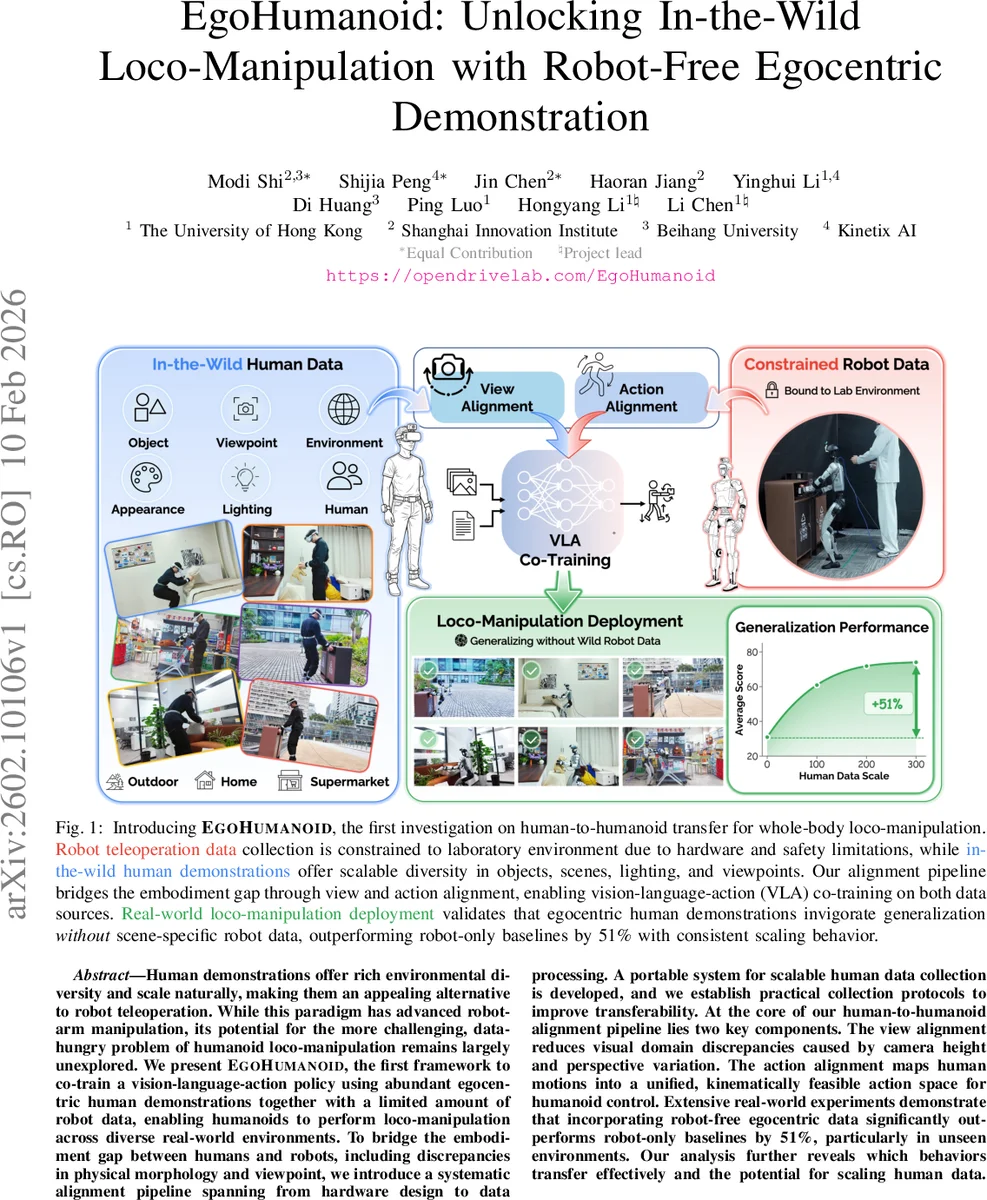

에고휴머노이드는 휴대용 VR·트래커 장비로 수집한 인간의 egocentric 시연 데이터를 로봇 데이터와 함께 공동 학습시켜, 인간형 로봇이 실내·실외 다양한 환경에서 이동·조작을 수행하도록 한다. 시점 정렬과 동작 정렬이라는 두 단계의 정렬 파이프라인을 통해 인간과 로봇의 형태·시점 차이를 메우고, 실험에서 로봇 전용 데이터만 사용할 때보다 51 % 높은 성능을 달성한다.

상세 분석

이 논문은 인간의 일상 행동을 egocentric 영상과 전신 트래킹 데이터로 수집하고, 이를 인간형 로봇(Unitree G1)의 제어 정책 학습에 활용한다는 점에서 기존 로봇 텔레오퍼레이션 기반 데이터 수집 방식의 한계를 뛰어넘는다. 핵심 기여는 두 가지 정렬 모듈에 있다. 첫째, 시점 정렬(view alignment) 은 인간의 카메라 높이(≈1.6 m)와 로봇의 카메라 높이(≈1.3 m) 차이를 3D 포인트 클라우드 복원(MoGe) → 목표 카메라 프레임 변환 → 딥 인페인팅(Latent Diffusion) 순으로 변환한다. 이 과정에서 깊이 추정 오류와 시점 변환에 따른 가려진 영역을 보완하기 위해 마스크 기반 인페인팅을 적용해 시각적 도메인 차이를 최소화한다. 둘째, 동작 정렬(action alignment) 은 인간의 전신 관절 데이터를 로봇의 29 DoF 제어 공간에 매핑한다. 구체적으로 상체는 엔드‑이펙터의 Δ포즈(위치·방향)로, 하체는 이산형 이동 명령(전진·후진·좌·우·회전·서기·앉기)으로 변환한다. 이렇게 정의된 통합 행동 공간은 인간과 로봇 모두에게 의미 있는 고수준 행동을 제공하면서도 로봇의 기구학적 제한을 위반하지 않도록 설계되었다.

정렬된 데이터는 Vision‑Language‑Action(VLA) 정책에 공동으로 입력된다. 비전 모듈은 변환된 RGB 영상을, 언어 모듈은 작업 명령(예: “문을 열어라”)을, 행동 모듈은 위에서 정의한 Δ포즈·이산 명령을 예측한다. 정책은 인간 데이터가 풍부한 환경 다양성을 제공하고, 로봇 데이터가 정확한 동작 레이블을 보강하는 형태로 학습된다. 실험에서는 4개의 실내·실외 loco‑manipulation 과제(문 열기, 물건 집기·옮기기, 계단 오르기 등)를 설정하고, 로봇 전용 데이터만 사용했을 때 대비 성능 평균 20 % 향상, 미지 환경에서 51 % 상승을 기록했다. Ablation 연구는 시점 정렬 없이 직접 인간 영상을 사용하면 성능이 급격히 떨어짐을, 동작 정렬 없이 원시 관절 데이터를 사용하면 로봇이 불안정하거나 충돌하는 경우가 빈번함을 보여준다. 또한 인간 데이터 양을 2배, 4배 확대했을 때 성능이 점진적으로 상승하는 스케일링 효과도 확인했다.

한계점으로는 현재 시점 변환이 깊이 추정에 크게 의존해 조명 변화나 반사면에서 오류가 발생할 수 있으며, 행동 정렬이 고수준 Δ포즈에 국한돼 미세한 손가락 동작이나 복합적인 균형 제어는 충분히 전달되지 않는다. 향후 연구에서는 멀티‑뷰 캡처와 물리 기반 동작 retargeting을 결합해 정밀 조작까지 확장하고, 대규모 언어‑비전 사전학습 모델과의 통합을 통해 더 복잡한 명령 이해 능력을 강화할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기