시간 인과성은 디노이징과 분리될 수 있다

초록

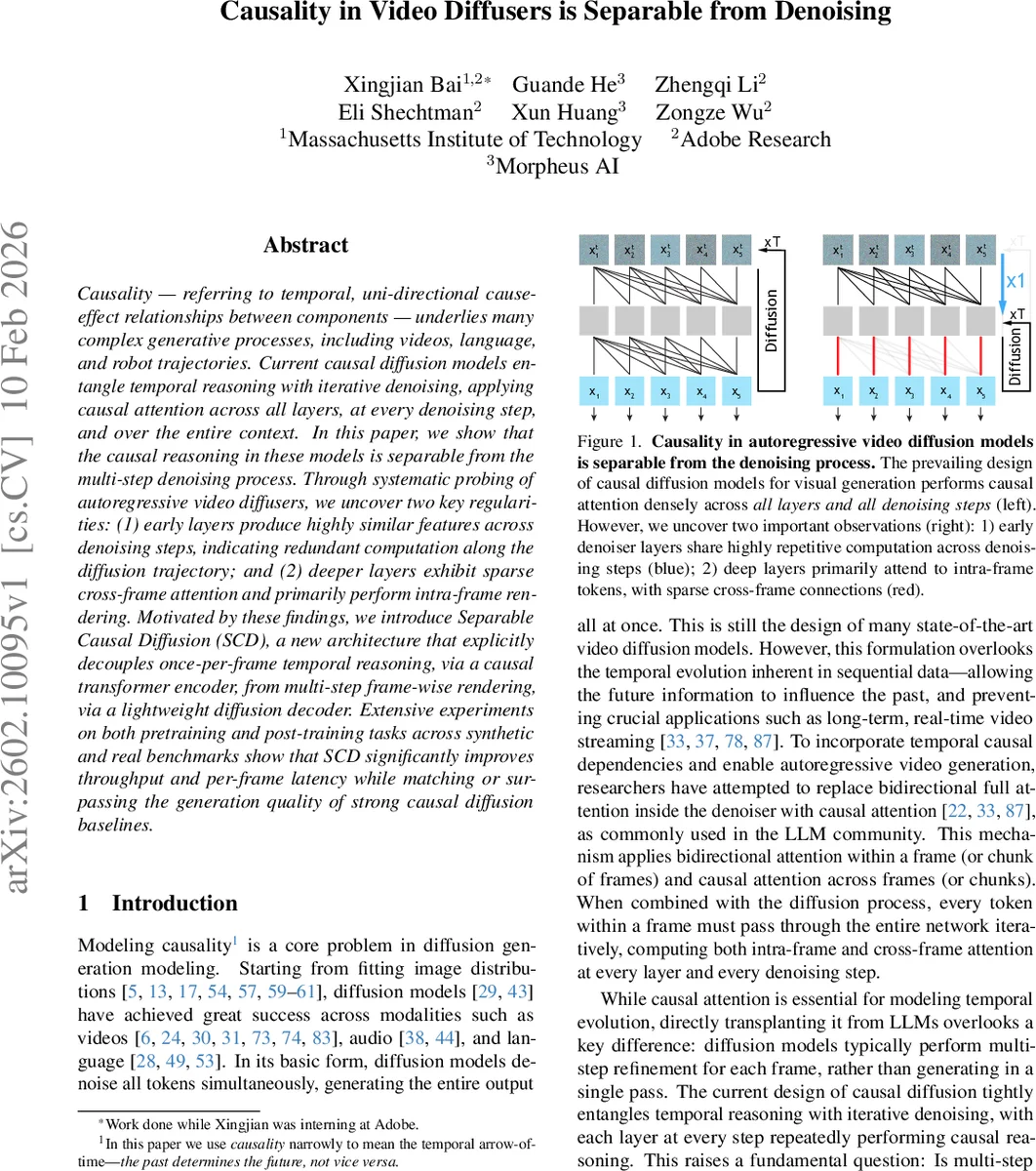

본 논문은 기존 인과적 비디오 디퓨전 모델에서 시간적 인과성(과거→미래) 연산이 다단계 디노이징 과정과 불필요하게 얽혀 있음을 실험적으로 밝혀낸다. 초기 레이어는 디노이징 단계마다 거의 동일한 특징을 생성하고, 깊은 레이어는 교차‑프레임 어텐션이 희소해 프레임 내부 렌더링에만 집중한다는 두 규칙을 기반으로, 한 프레임당 한 번만 수행되는 인과 트랜스포머 인코더와 경량 디노이징 디코더를 결합한 “Separable Causal Diffusion”(SCD) 구조를 제안한다. SCD는 기존 인과 디퓨전 대비 2~3배 빠른 처리량과 낮은 레이턴시를 유지하면서 생성 품질을 동등하거나 상회한다.

상세 분석

본 연구는 autoregressive video diffusion 모델을 층‑단계·시간‑단계로 정밀히 프로빙함으로써 인과 연산이 실제로 어디에서 발생하는지를 규명한다. 첫 번째 실험에서는 중간 레이어(예: 15번째 블록)의 출력 피처가 50개의 디노이징 스텝 전체에 걸쳐 코사인 유사도 0.95 이상을 보이며, PCA 분석에서도 초기 스텝과 후기 스텝의 주성분이 거의 일치한다는 점을 발견했다. 이는 초기 디노이징 단계에서 이미 프레임의 전반적 구조와 움직임이 확정되고, 이후 단계는 주로 픽셀‑레벨 디테일을 다듬는 역할만 수행한다는 의미다. 두 번째 실험에서는 각 레이어별 교차‑프레임 어텐션 매스를 측정했을 때, 레이어가 깊어질수록 과거 프레임에 할당되는 어텐션 비중이 급격히 감소하고, 마지막 5개의 레이어는 거의 완전한 대각선 마스크(프레임 내부 전용)로 전환해도 영상 의미와 움직임이 유지되는 것을 확인했다. 이러한 결과는 “시간적 인과성은 초기 레이어에서 한 번만 수행하면 충분하고, 깊은 레이어는 순수히 intra‑frame 렌더링에 집중한다”는 구조적 분리를 시사한다. 이를 토대로 제안된 SCD는 (1) 인과 트랜스포머 인코더가 과거 클린 프레임 토큰을 KV‑cache에 저장해 한 번만 컨텍스트를 요약하고, (2) 경량 디퓨전 디코더가 해당 컨텍스트 잠재와 현재 노이즈 프레임을 입력받아 다단계 디노이징을 수행한다는 두 단계로 구성된다. 인코더는 전체 비디오 길이에 대해 O(N) 복잡도를 갖지만 한 번만 실행되며, 디코더는 프레임당 O(T)·O(L) 연산만 수행한다. 실험에서는 SCD를 1) 스크래치 학습, 2) 사전 학습된 bidirectional teacher 모델에서 파인튜닝하는 두 시나리오에 적용했으며, 모두 기존 인과 디퓨전 대비 2~3배 낮은 레이턴시와 유사하거나 향상된 FVD/IS 점수를 기록했다. 특히, 파인튜닝 실험에서는 teacher‑student distillation 없이도 높은 품질을 유지하면서 throughput을 크게 끌어올렸다. 전체적으로, 인과 연산과 디노이징을 명확히 분리함으로써 계산 중복을 제거하고, 실시간 스트리밍·인터랙티브 비디오 생성에 필요한 효율성을 크게 개선한 점이 가장 큰 공헌이다.

댓글 및 학술 토론

Loading comments...

의견 남기기